多策略改进哈里斯鹰优化算法

文章目录

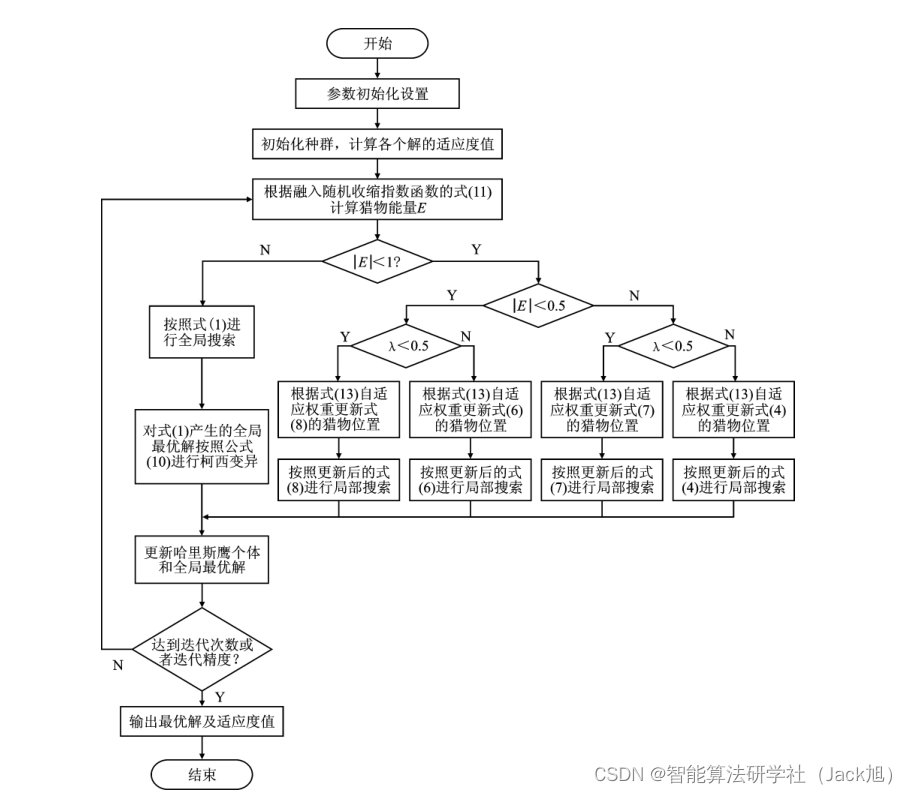

摘要: 为解决基本哈里斯鹰算法(Harris hawks optimization, HHO)易陷入局部最优和收敛精度低的问题,提出多策略优化的哈里斯鹰优化算法(Multi-Strategy Harris hawks optimization, MHHO).在探索阶段,引入柯西分布函数变异全局位置,增加种群多样性;在过渡阶段,利用随机收缩指数函数非线性化能量方程,更好地协调全局探索和局部开采;在开采阶段,引入自适应权重因子更新局部位置,提高局部开采能力.

1.哈里斯鹰优化算法

基础哈里斯鹰优化算法的具体原理参考,我的博客:https://blog.csdn.net/u011835903/article/details/108528147

2.改进哈里斯鹰优化算法

2.1 柯西变异

针对

H

H

O

\mathrm{HHO}

HHO 优化算法易陷入局部最优值的问 题, 利用柯西 (Cauchy) 分布函数增加哈里斯廢种群 多样性, 增加搜索空间, 提高

H

H

O

\mathrm{HHO}

HHO 算法的全局搜索 能力. 论文受文献

[

7

]

[7]

[7] 的启发, 结合了柯西算子, 充分 利用柯西分布函数两端的变异效应优化全局最优对 象, 标准柯西分布函数公式如下:

f

(

x

)

=

1

π

(

1

x

2

+

1

)

(9)

f(x)=\frac{1}{\pi}\left(\frac{1}{x^{2}+1}\right) \tag{9}

f(x)=π1(x2+11)(9)

Cauchy 函数的峰值相对较小, 哈里斯府在柯西 变异后会更多地搜索全局最优值,使用相对较少的 时间开采局部区间; 另外, Cauchy函数从峰值向两 侧下降相对平绪, 在通过柯西变异更新位置后, 哈里 斯䳸受局部极值点的约束力下降, 可以跳出局部极 值. 柯西变异的数学模型为获得当前全局最优解

X

best

X_{\text {best }}

Xbest 后以下列公式更新最优解:

X

best

′

=

X

best

+

X

best

×

Cauchy

(

0

,

1

)

(10)

X_{\text {best }}^{\prime}=X_{\text {best }}+X_{\text {best }} \times \operatorname{Cauchy}(0,1) \tag{10}

Xbest ′=Xbest +Xbest ×Cauchy(0,1)(10)

2.2 随机收缩指数函数

在

H

H

O

\mathrm{HHO}

HHO 算法中, 猎物能量

E

E

E 的大小起着调节 和过渡全局搜索和局部开采的重要作用,

E

E

E 越小,

H

H

O

\mathrm{HHO}

HHO 算法越倾向于执行局部开采;

E

E

E 越大, 算法越 倾向于进行全局探索. 但在传统

H

H

O

\mathrm{HHO}

HHO 算法的能量 方程中,

E

E

E 由最大值到最小值呈线性递减, 并不能有 效描述自然界中哈里斯噟群体围捕猎物的真实过 程. 数学家模拟捕食者一猎物的相互作用

[

8

]

{ }^{[8]}

[8], 得出这 样的结论:随机收缩指数函数更适合于表达猎物逃 跑时的能量变化. 因此, 论文提出修正能量线性递减 调控机制, 将随机收缩指数函数融入猎物能量

E

\mathrm{E}

E 的 递减过程, 其对应的能量方程为:

E

=

2

E

0

(

2

rand

×

exp

(

−

(

π

2

×

t

T

)

)

(11)

E=2 E_{0}\left(2 \operatorname{rand} \times \exp \left(-\left(\frac{\pi}{2} \times \frac{t}{T}\right)\right)\right. \tag{11}

E=2E0(2rand×exp(−(2π×Tt))(11)

2.3 自适应权重

惯性加权因子是非常重要的参数. 当惯性加权因 子辌大时,该算法使用相对辌多的时间进行的全局搜 索;当惯性加权因子较小时,该算法使用相对较多的时 间进行局部搜索, 可以精细地寻找最佳解决方案. 猎物 位置代表

H

H

O

\mathrm{HHO}

HHO 算法当前最优解, 同时反向引导哈里 斯鹰栖息地的位置, 它的迭代更新直接决定了算法的 优化性能. 因此, 为了提高算法的局部开采能力,有必 要对猎物位置的邻域进行再更新, 以找出更优解.

考虑到上述情况, 受文献

[

9

]

[9]

[9] 的启发, 引入了一 种自适应权重方法. 在四种围捕机制中,哈里斯䳸搜 寻猎物时,猎物会使用较小的自适应权重更新位㖵, 提高哈里斯鹰算法局部寻优能力. 自适应权重公式 和猎物位置更澵如式 (12)、(13) 所示:

ω

=

sin

(

π

×

t

2

T

+

π

)

+

1

(12)

\omega=\sin \left(\frac{\pi \times t}{2 T}+\pi\right)+1\tag{12}

ω=sin(2Tπ×t+π)+1(12)

X

rabbit

′

=

ω

×

X

rabbit

(13)

X_{\text {rabbit }}^{\prime}=\omega \times X_{\text {rabbit }} \tag{13}

Xrabbit ′=ω×Xrabbit (13)

式中,

T

T

T 为最大迭代次数,

t

t

t 为当俞迭代次数. 通过融 合自适应权重因子

ω

\omega

ω,使

M

H

H

O

\mathrm{MHHO}

MHHO 算法具有更好的局 部开采能力.

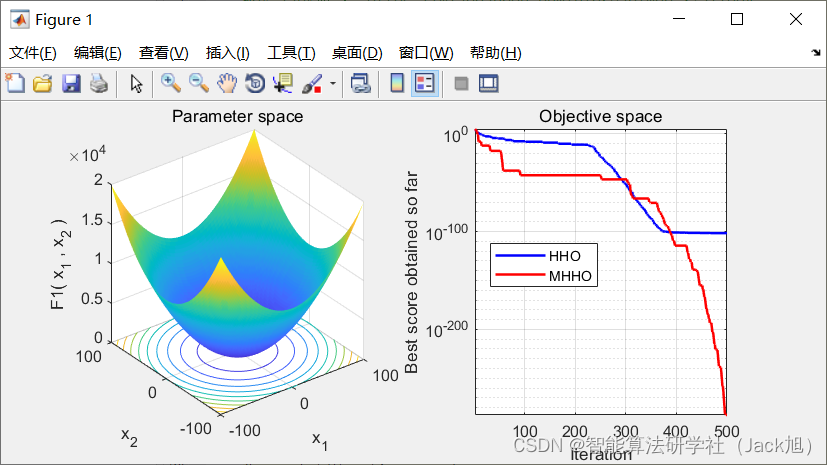

3.实验结果

4.参考文献

[1]郭雨鑫,刘升,高文欣,张磊.多策略改进哈里斯鹰优化算法[J].微电子学与计算机,2021,38(07):18-24.

2140

2140

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?