【机器学习】LDA线性判别分析

1. LDA的基本思想

2. LDA求解方法

3. 将LDA推广到多分类

4. LDA算法流程

5. LDA和PCA对比

【附录1】瑞利商与广义瑞利商

线性判别分析 (Linear Discriminant Analysis,LDA)是一种经典的线性学习方法,在二分类问题上因为最早由[Fisher,1936]提出,亦称"Fisher判别分析"。(严格说来LDA与Fisher判别分析稍有不同,LDA假设了各类样本的协方差矩阵相同且满秩。)

1. LDA的基本思想

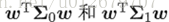

LDA的基本思想是: 给定训练样例集,设法将样例投影到一条直线上,使得同类样例的投影点尽可能接近、异类样例的投影点尽可能远离,在对新样本进行分类时,将其投影到同样的这条直线上,再根据投影点的位置来确定新样本的类别。图3.3给出了一个二维示意图。

2. LDA求解方法

问:LDA最终要求什么?

求投影空间W。 假设要投影到d维空间,W为这最大的d个特征值对应的特征向量张成的矩阵。所以问题转化为求解特征向量w

求解过程如下:

给定数据集,

若将数据投影到直线w上,则两类样本的中心在直线上的投影分别为

由于直线是一维空间,因此

本着同类样例的投影点尽可能接近、异类样例的投影点尽可能远离的原则,欲使同类样例的投影点尽可能接近,可以让同类样例投影点的协方差尽可能小,即

定义"类内散度矩阵"

以及"类间散度矩阵"

则式 (3.32)可重写为

这就是LDA欲最大化的目标,即Sw与Sb的"广义瑞利商" (Rayleigh)。根据广义瑞利商的性质,我们知道我们的J(w)最大值为矩阵

如何求解w呢?(w向量决定投影方向)

如何确定ω呢? 注意到式(3.35)的分子和分母都是关于ω的二次项,因此式(3.35)的解与ω的长度无关,只与其方向有关。(why? 二次项的性质,若w是一个解,则对于任意常数α,αw也是式(3.35)的解.)

不失一般性,令

由拉格朗日乘子法,上式等价于

其中λ是拉格朗日乘子。注意到

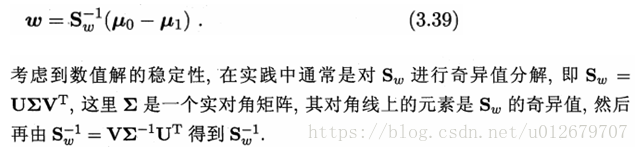

代入式 (3.37) 即得

3. 将LDA推广到多分类

如何将LDA推广到多分类任务中?

假定存在N个类,且第i类示例数为

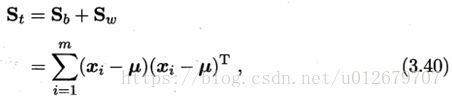

其中μ是所有示例的均值向量。将类内散度矩阵

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1216

1216

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?