优化(optimization)是人类历史上的重大突破, 他解决了很多实际生活中的问题.

比如说牛顿法 (Newton’s method), 最小二乘法(Least Squares method), 梯度下降法 (Gradient Descent) 等等. 而我们的神经网络就是属于梯度下降法这个分支中的一个.

初学神经网络的时候, 我们通常会遇到这样一个方程, 叫做误差方程 (Cost Function). 用来计算预测出来的和我们实际中的值有多大差别. 在预测数值的问题中, 我们常用平方差 (Mean Squared Error) 来代替

(x,y)是真实的数据,W代表参数矩阵。

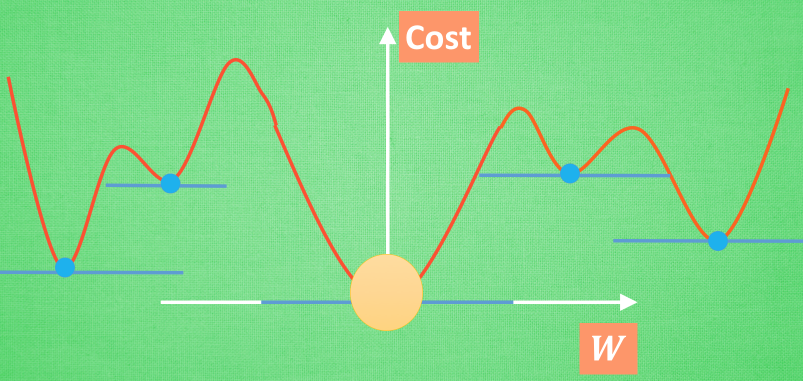

梯度下降,就是对Cost函数求梯度,朝着梯度下降的方向移动,就可以更新参数,找到最优的参数。

在这幅图中,就有全局最优和局部最优之分了,通常我们只要找到一个最优解,神经网络就可以被训练的足够好了,所以也不用太担心这个问题。

1029

1029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?