Introduction

通常,LLM的用户请求和相应的响应都在文本中,然而,纯文本人机交互对于许多应用场景来说是不够的,因为现实世界的信息通常是多模态的。为了进一步探索llm的潜力,许多研究人员试图赋予llm理解多模态内容的能力。

现有的工作大多基于将单一模态的输入与文本进行对齐。赋予LLM理解视频需要对包括视觉输入、听觉输入和文本输出在内的不同模式的全面处理,这比纯图像理解和纯音频理解任务更具挑战性。

为了将文本输出与视频对齐,我们设计了多分支跨模态预训练来学习视觉语言对应和音频语言对应。

对于视觉-语言对应,我们首先在大规模视频字幕数据集上预训练视觉相关组件,并执行视频片段到文本的生成任务。为了增强对静态视觉概念的理解,我们还在这个预训练阶段添加了图片说明数据。然后,我们在基于视频的对话数据集上进一步微调这些组件,以执行视觉指令调整。

对于音频编码器和语言解码器之间的对齐,我们使用音频到文本生成任务进一步预训练音频字幕数据集上的音频相关组件。对于音频语言对应,我们利用 Imagebind (Girdhar et al., 2023) 作为编码器,它在将不同模态对齐到公共嵌入空间方面表现得非常好。

Method

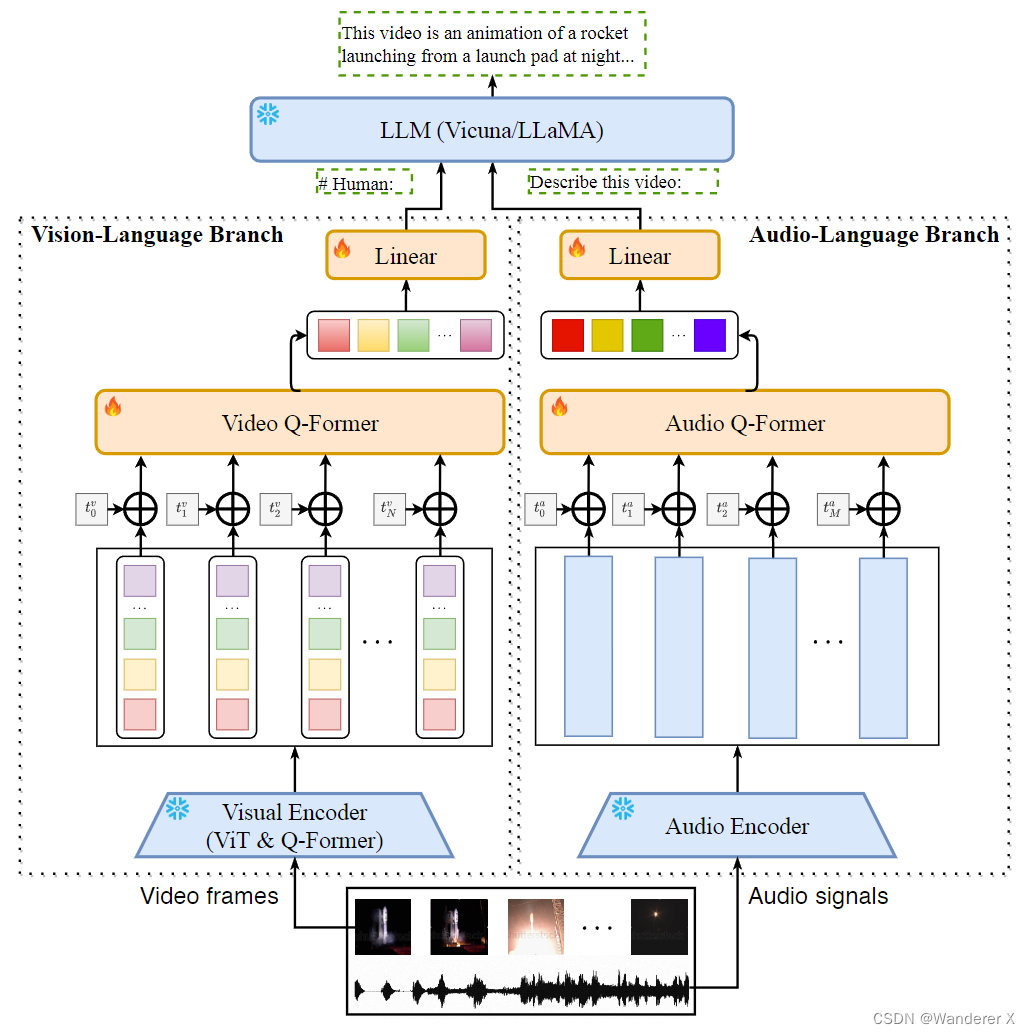

Video-LLaMA 旨在使冻结的 LLM 具有理解视频中的视觉和听觉内容的能力。如图 1 所示,我们设计了两个分支,即视觉语言分支和音频语言分支,将视频帧和音频信号分别转换为与 LLM 文本输入兼容的查询表示。

Vision-Language Branch

包括:一个冻结的预训练图像编码器,用于从视频帧中提取特征,一个位置嵌入层将时间信息注入到视频帧中,一个视频Q-former来聚合帧级表示和一个线性层,将输出视频表示投影到与llm的文本嵌入相同的维度。

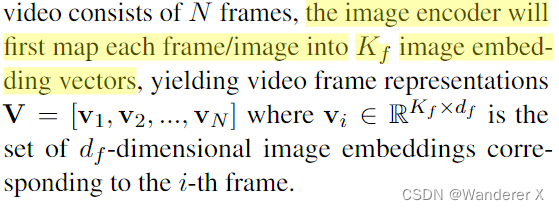

图像编码器首先将图像映射成embedding

K

f

K_f

Kf,对于N帧的视频,则会形成N这个这样的embedding。

我们将位置编码的帧表示提供给视频Q-former,将位置编码的帧表示作为输入,以获得 kV 个维度为 dv 的视频嵌入向量,作为视频的表示 ˆv ∈ RkV ×dv。

为了使视频表示适应llm的输入,我们添加了一个线性层,将视频嵌入向量转换为视频查询向量(soft prompt)。

Audio-Language Branch

组成:一个预训练的音频编码器组成,用于计算给定短片段原始音频的特征,一个位置嵌入层将时间信息注入音频片段,一个音频 Q-former 来融合不同音频片段的特征,以及一个线性层,将音频表示映射到 LLM 的嵌入空间中。

我们首先从视频中统一采样 2 秒短音频剪辑的 M 个片段,然后使用 128 个梅尔谱图箱将每个 2 秒的音频剪辑转换为频谱图。在获得输入音频的频谱图列表后,音频编码器将将每个频谱图映射到密集向量中。

Training

Vision-Language

video-to-text generation

Webvid-2M,这是一个大规模的短视频数据集,文本描述来自股票市场网站

CC595k,LLaVA从CC3M的图像标题数据集过滤得到的。

在预训练阶段之后,该模型可以生成视频中信息的内容,但其遵循指令的能力降低。

vision-text alignment and instruction-following

MiniGPT4 (Zhu et al., 2023) 的图像细节描述数据集、LLAVA (Liu et al., 2023) 的图像指令数据集和 Video-Chat 的视频指令数据集 (Li et al., 2023c)

使用高质量的指令数据微调模型。

Audio-Language

在视频/图像指令数据上进行训练,将ImageBind的输出连接到语言解码器

Q-former、Video Q-former 和 Audio Q-Former 都是用于处理多模态数据的模型组件,但它们各自有不同的作用:

Q-former:Q-former 用于处理图像模态的数据。它将图像特征映射到文本嵌入空间,使得大型语言模型(LLM)可以理解图像内容。

Video Q-former:Video Q-former 用于处理视频模态的数据。它通过计算帧级表示的交互来生成视频的查询表示,从而使 LLM 能够理解视频内容。

Audio Q-former:Audio Q-former 用于处理音频模态的数据。它将音频特征映射到文本嵌入空间,使得 LLM 能够理解音频内容。

综上所述,这三种 Q-former 模型分别负责处理图像、视频和音频模态的数据,以便在大型语言模型中实现多模态理解。

1133

1133

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?