问题描述:

在加入中断训练代码之后,从中断处训练,出现了保存的模型和优化器权重不在同一设备下的错误。在网上搜索之后,找到了许多解决方法,但都不适合我,在这里做一下总结:

网上解决办法1

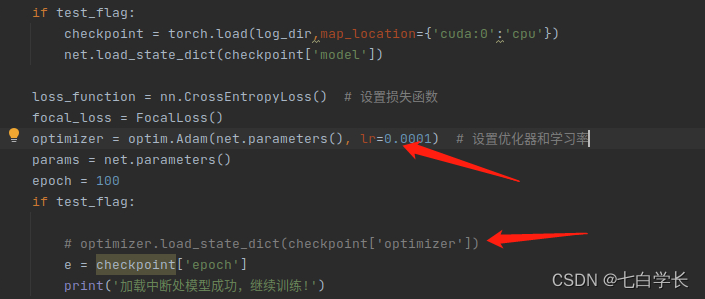

在模型载入时,用map_location指定使用设备

checkpoint = torch.load(log_dir,map_location={'cuda:0':'cpu'})

model.load_state_dict(checkpoint['model'])

网上解决办法2

使用torch.device去指定GPU设备

device = torch.device("cuda:{}".format(rank))

我的方案:

经过几轮修改,发现以上解决方法都不适合我的问题,依旧还是会报错。最后经过检查发现,是我在加载了保存模型的优化器参数之后又重新加载了一次,导致出现了问题。把第二次的注释掉之后就好了。

9982

9982

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?