前言

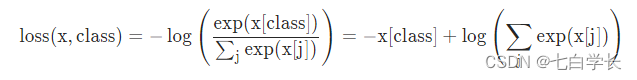

这里主要介绍CEloss的权重设置,因为大家无论是分类还是分割都可以用到CEloss,而且很多模型一开始自带的损失函数就是CEloss。如下图所示,计算一个样本的CE损失是先对输入做了softmax再做log

一、直接对CEloss赋予权重

一定要把loss的权重放到GPU上,要不然会报错。其中[0.1, 0.15, 0.15, 0.6]就是对于我要区分的四类赋予的权重。

weights = torch.tensor([0.1, 0.15, 0.15, 0.6]).to(device)#device表示GPU显卡

loss_function = nn.CrossEntropyLoss(weight=weights) # 设置损失函数

二、将CEloss拆解成单步操作

因为有些网络的最后一层就是softmax层,在有softmax层的情况下再使用torch.nn.CrossEntropyLoss就对softmax层前的logits进行了两次softmax再进行log计算损失,所以在网络的最后一层为softmax层的时候,不能用torch.nn.CrossEntropyLoss。

代码如下(示例):

loss_weight=torch.nn.NLLLoss(weight=torch.tensor([0.1, 0.15, 0.15, 0.6]))

input_softmax=torch.nn.Softmax(dim=1)(input)

input_logsoftmax=torch.log(input_softmax)

loss = loss_weight(input_logsoftmax,target))

总结

参考于博客

5451

5451

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?