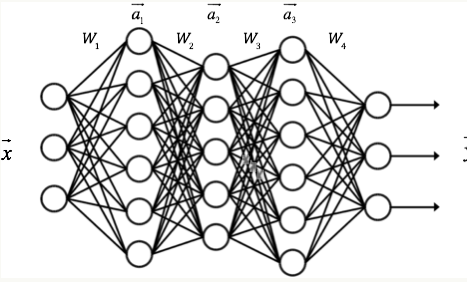

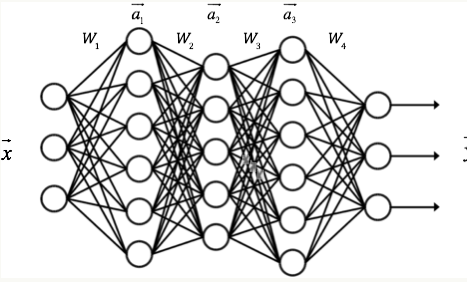

构造:输入神经元个数等于输入向量维度,输出神经元个数等于输出向量维度。(x1=(1,2,3),则需要三个输入神经元

一 前向后传播

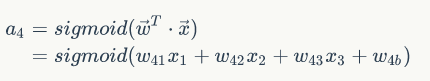

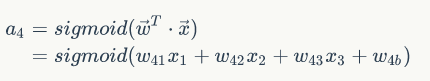

隐层:

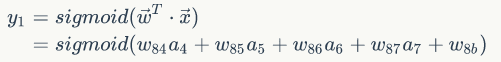

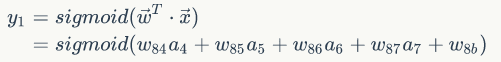

输出层:

一般化

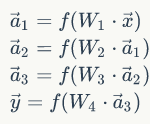

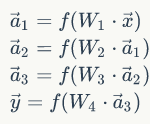

,向量表示

,向量表示

,向量表示

,向量表示

二 反向传播

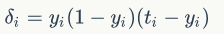

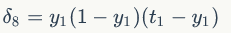

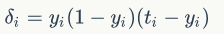

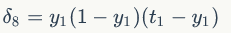

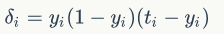

1计算梯度delta:均方误差,利用了sigmoid函数导数的有趣性。

输出层梯度:

--> eg.

--> eg.

--> eg.

--> eg.

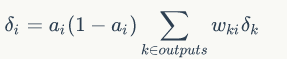

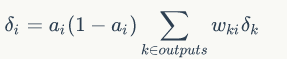

隐层梯度:

--> eg.

--> eg.

--> eg.

--> eg.

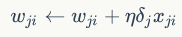

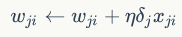

2

更新权重:

eg输出层:

eg隐层:

备注 反向传播的公式推导

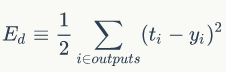

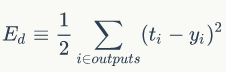

0目标函数:

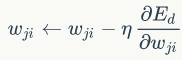

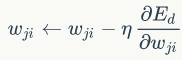

1梯度下降法优化目标函数

, 怎么计算出误差对于每个权重的偏导数呢?

, 怎么计算出误差对于每个权重的偏导数呢?

, 怎么计算出误差对于每个权重的偏导数呢?

, 怎么计算出误差对于每个权重的偏导数呢?

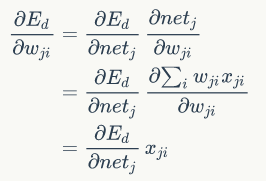

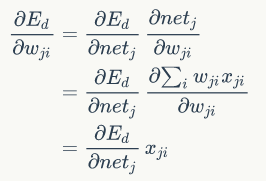

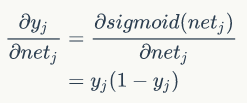

2netj是第j个神经元的加权输入作为传导,链式求导法则 : ,。

区分

输出层和

隐藏层两种情况:

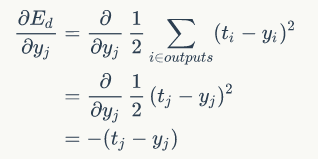

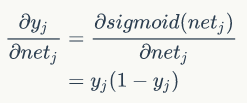

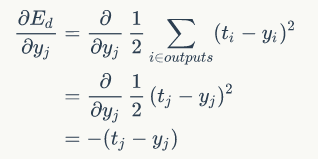

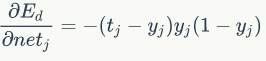

3.1 输出层: 借用yj作为传导,netj和Ed都是与yj有关的函数,链式求导法则:

第一项:

第二项:

第二项:

第二项:

第二项:

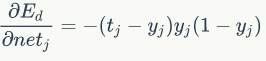

带入

,所以

输出层梯度:

,所以

输出层梯度:

,所以

输出层梯度:

,所以

输出层梯度:

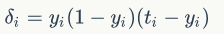

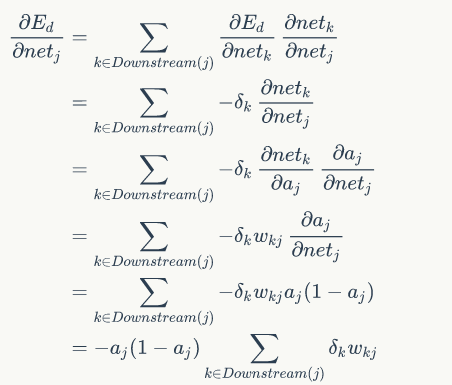

3.2隐层:借用节点的所有直接下游节点的集合Downstream(j),链式法则:aj

带入求得梯度

备注:

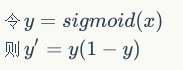

激活函数: sigmoid函数是一个非线性函数,导数有趣,可用自身表示。

参考:网络博客

3179

3179

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?