-

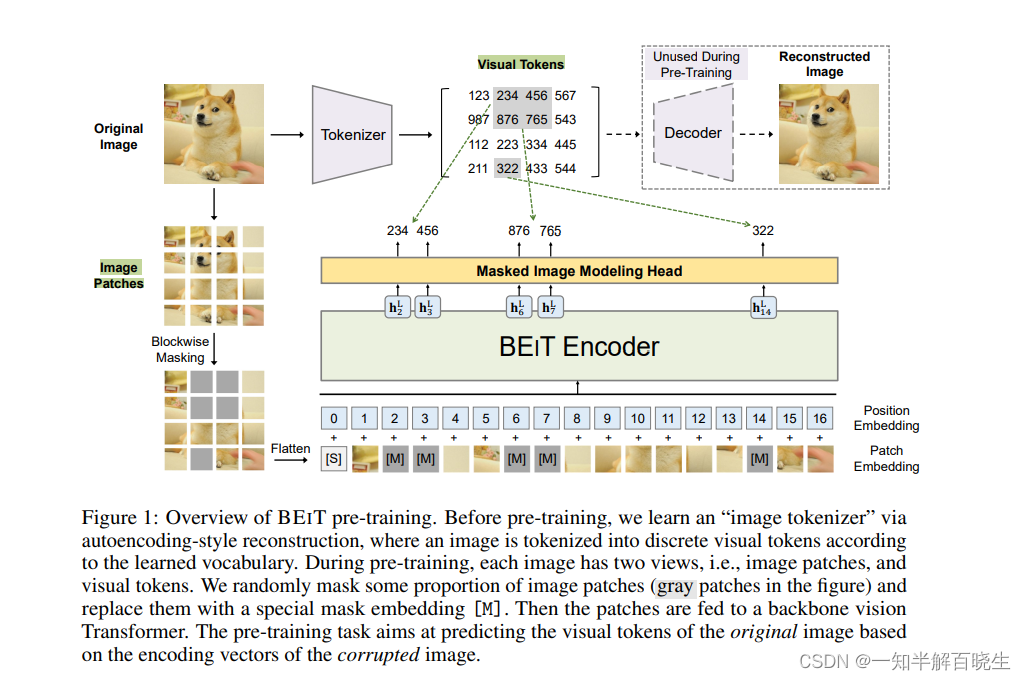

BEIT: BERT Pre-Training of Image Transformers

-

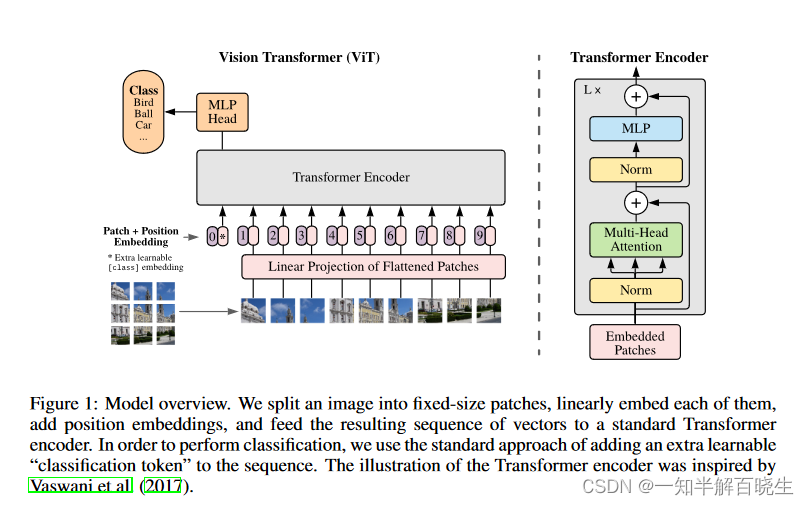

An Image Is Worth 16x16 Words: Transformers For Image Recognition At Scale

VIT中多头注意力机制部分是不同patch互相交互信息的地方,VIT中还专门设置了class token,最终只有class token 被用于最终的分类。

-

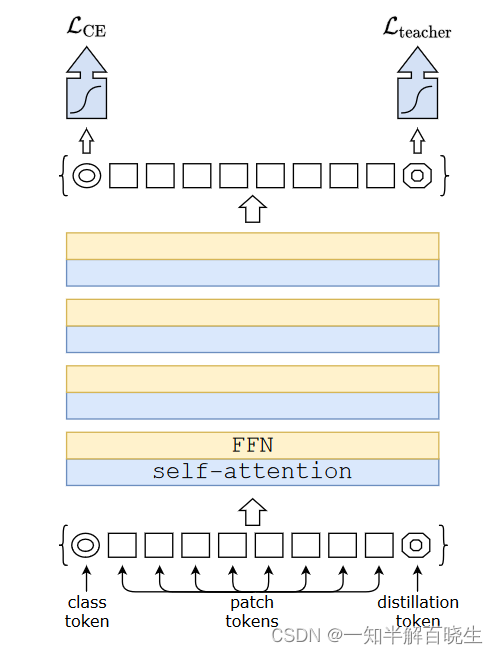

Training data-efficient image transformers & distillation through attention

与VIT 不同之处在于,多了个distillation token与class token整好对称。蒸馏策略有硬蒸馏和软蒸馏。

transformer学习历程

于 2022-05-18 15:31:02 首次发布

2029

2029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?