笔记整理和思考补充,参考链接: https://www.zhihu.com/question/58883125/answer/206813653

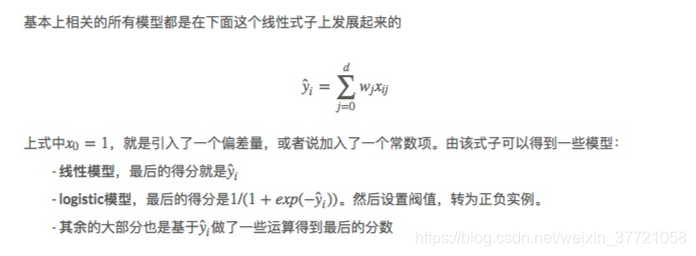

模型:

上面其实讲的非常好,特别是logistics 模型,熟悉的都知道logisitcs模型中的sigmoid就是将输出的数值映射到两端,进而进一步的进行分类。所以比如一个手写识别的深度学习模型,一般前面是卷积层然后接上全连接层,全连接层将特征们映射起来,打破了空间位置信息。一般来说比如一共有10,那么猫狗识别的最后的全连接层就是10类。然后接上softmax,这里提下softmax是logistics回归的升级版本,而sigmoid是logistics回归的激活函数。

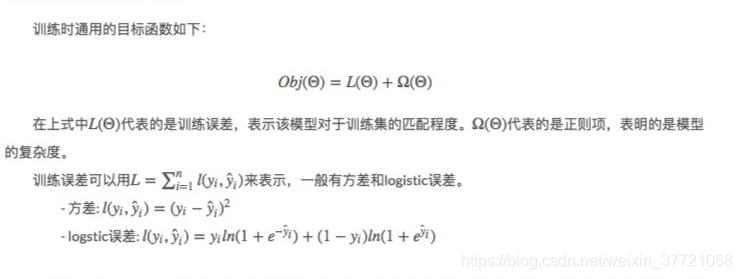

训练时的目标函数:

上面有两个概念,一个是损失函数一个目标函数,可以看出来目标函数是损失函数加上正则项。正则项的话是避免过拟合了。损失函数有很多,交叉商,平方差,等。正则项,一般就是L1和L2的,后者可以求导数。

其实无论是机器学习和深度学习,这个概念是始终贯穿的。深度学习的梯度下降告诉我们,如果使用了sigmoid 作为激活函数,那么在损失函数部分就有了这个成分,然后反向传播和梯度下降的时候,很容易出现梯度消失

本文介绍了XGBoost的模型、训练目标函数、回归树及其优化方法,阐述了正则项在防止过拟合中的作用,并探讨了XGBoost与深度学习之间的联系,如梯度下降、损失函数和权重迭代。XGBoost通过构建最佳树结构,利用贪心算法和目标函数优化,实现了高效预测。

本文介绍了XGBoost的模型、训练目标函数、回归树及其优化方法,阐述了正则项在防止过拟合中的作用,并探讨了XGBoost与深度学习之间的联系,如梯度下降、损失函数和权重迭代。XGBoost通过构建最佳树结构,利用贪心算法和目标函数优化,实现了高效预测。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

930

930

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?