Chuanjun Zheng Daming Shi Wentian Shi

Shenzhen University

Unfolding TV 展开总变分:即对TV(总变分)展开(分成多个小项)求解。

文章综述:作者利用增广拉格朗日乘子法,交替方向乘子法等对总变分(TV)进行优化拆解,得到多个小项,进行全局的噪声模型估计,优化噪声模型;经过多次迭代计算模型,得到最优噪声模型后,对图像进行提亮,去噪,Loss计算得到增强后的image。

文章分为两部分:一:learning noise level map through total variation regularizaiton ,即得到噪声优化模型;二:Image restoration ,图像重建。

上图是Fig 1 成果展示,(a)极弱光图像;(b)LIME增强(为什么要和16年得算法比较呢,因为您也是传统算法吗,Retinex呢);(c)LIME增强后利用NBNet去噪网络,进行去噪(增强后细节肯定会消失,再去噪,可想而知)(d)先NBNet去噪再+LIME增强;(e、f、g)好像都不是专门针对弱光的;(h)本文效果;(i)ground truth(gt)

[2] Shen Cheng, Nbnet: Noise basis learning for image denoising with subspace projection. In CVPR, pages 4896–4906, June 2021 《NBNet》

接下来进入文章主题:

||x-y||为保真项(保证和原图近似,主要内容不要丢失),λΦ(x)为平滑项(降低噪声空间,λ控制噪声比例)

x^ 即常用的噪声模型,作者说大多注意力都在σ上,而忽略了λΦ(x) ,那么接下来奥,我要对这个 λΦ(x)建模,并应用在极弱光环境下。

首先来看TV(总变分)!

由上可知TV越小,yn+1与y的噪声空间越小。

那么对二维的信号来说呢,可以延申到图像上

需要对二维信号y的dx,dy2个方向上做计算,同理,希望yn+1与yn的x,y方向上的信息总变分最小。

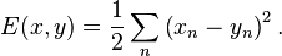

如果给定一个带随机噪声的二维图像xn,想让xn和ground truth yn 接近,可以用下面的等式衡量:

但又希望xn和yn的TV很小(即噪声空间很小)

作者就是要对E(x,y) + λV(y)进行建模,λ控制噪声。

作者利用M代替λ,因为图像有很多复杂情况,用矩阵M表示多变的噪声,为后续卷积操作做铺垫,用Dx代替V(y),其实Dx这就相当于一个卷积核,对图像x、y方向的特征进行提取。所以看到的M,D都是x、y2个方向的。

接下来为了求解Minimize式:引入了增广拉格朗日乘子法。

z是拉格朗日乘子,ρ是正则参数。展开得到L(x,u,z),具体操作,搜索增广拉格朗日乘子法。即课得到上式

接下来作者利用ADMM,交替方向乘子法对L(x,u,z)进一步求解,这一步用了对偶上升法:

得到有关x、u、 z 的模型 。这还不够

又利用FFT和收缩方程,得到x、u、 z 的解方程

得到了N、S、G 3个有关x,u,z的方程,至此,切题Unfolding TV ----把TV展开成了N、S、G三个求解函数。

接下来正文网络结构:

1:Unfolding TV Module: 分2条线,往上走的一条线:进行x,u,z方程的迭代计算,依据上面推到得到的解方程,但是会发现M需要额外获取:往右走的一条线:推到M,利用NLI-BLOCK模块,得到M = [M1,M2,...,M8] 8个特征图,即表示8个噪声估计图。经过8次迭代计算推到得到最有x,即x8 去噪后的平滑图。

2:Image Restoration Module: y-ys = yd ,yd和M = [M1,M2,...,M8] 用于Noise Suppression 模块,切合最开始提出的minimize等式模型中的M●Dx。ys则用于单纯Luminance Corr 模块,提亮,最后两个相加,得到了y,即增强后的图像。

加下来看一下NLI-Block:

A()就相当于Relu函数,谁大选谁,也就是文章的题目,自适应的,噪声截断。

ε 是一个全局噪声估计,由下面[1]提出,N是由2个拉普拉斯算子相减得到,都是固定的。

ε 是一个全局噪声估计,由下面[1]提出,N是由2个拉普拉斯算子相减得到,都是固定的。

[1]John Immerkær. Fast noise variance estimation. Computer Vision and Image Understanding, 64(2):300–302, 1996. 4

推导如上,便于理解

M = [M1,M2,...,M8]

接下来是实验结果:略

2863

2863

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?