逻辑回归

适用类型:解决二分类问题

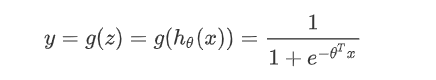

逻辑回归的出现:线性回归可以预测连续值,但是不能解决分类问题,我们需要根据预测的结果判定其属于正类还是负类。所以逻辑回归就是将线性回归的结果,通过Sigmoid函数映射到(0,1)之间

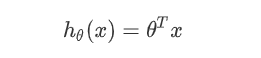

线性回归的决策函数:数据与θ的乘法,数据的矩阵格式(样本数×列数),θ的矩阵格式(列数×1)

将其通过Sigmoid函数,获得逻辑回归的决策函数

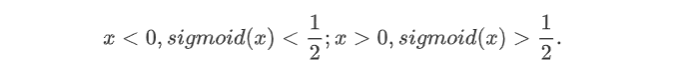

使用Sigmoid函数的原因:

可以对(-∞, +∞)的结果,映射到(0, 1)之间作为概率

可以将1/2作为决策边界

数学特性好,求导容易

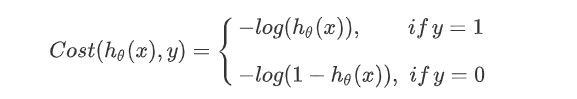

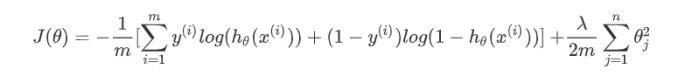

逻辑回归的损失函数

线性回归的损失函数维平方损失函数,如果将其用于逻辑回归的损失函数,则其数学特性不好,有很多局部极小值,难以用梯度下降法求解最优

这里使用对数损失函数

解释:如果一个样本为正样本,那么我们希望将其预测为正样本的概率p越大越好,也就是决策函数的值越大越好,则logp越大越好,逻辑回归的决策函数值就是样本为正的概率;如果一个样本为负样本,那么我们希望将其预测为负样本的概率越大越好,也就是(1-p)越大越好,即log(1-p)越大越好

为什么使用对数函数:样本集中有很多样本,要求其概率连乘,概率为0-1之间的数,连乘越来越小,利用log变换将其变为连加,不会溢出,不会超出计算精度

损失函数:: y(1->m)表示Sigmoid值(样本数×1),hθx(1->m)表示决策函数值(样本数×1),所以中括号的值(1×1)

二分类逻辑回归直线编码实现

import numpy as np

from matplotlib import pyplot as plt

from scipy.optimize import minimize

from sklearn.preprocessing import PolynomialFeatures

class MyLogisticRegression:

def __init__(self)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2407

2407

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?