前言:本文讲解了机器学习需要用到的信息论中关于信息熵的知识,并用代码演示如何计算信息熵和互信息。

信息熵 Information Entropy

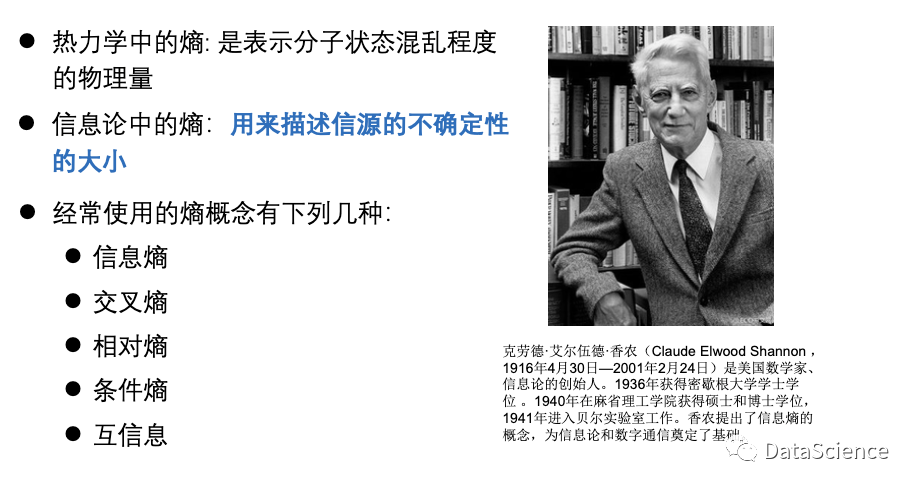

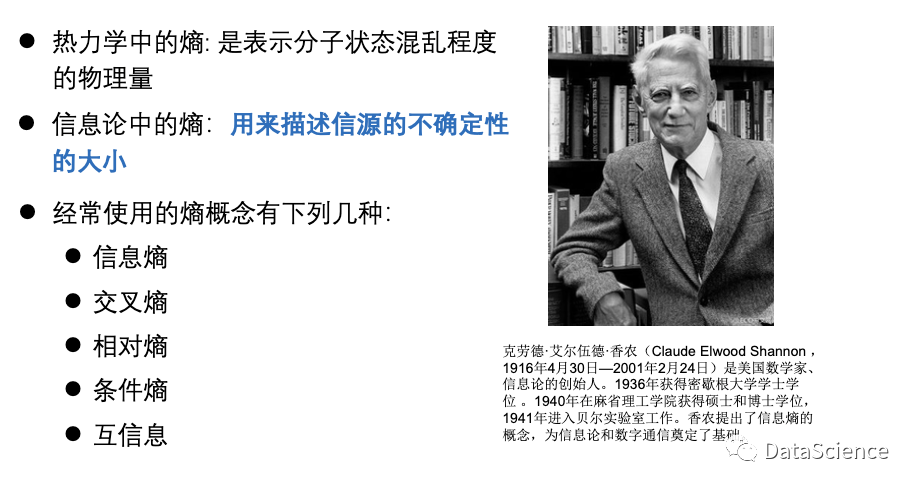

信息论中的熵(entropy)

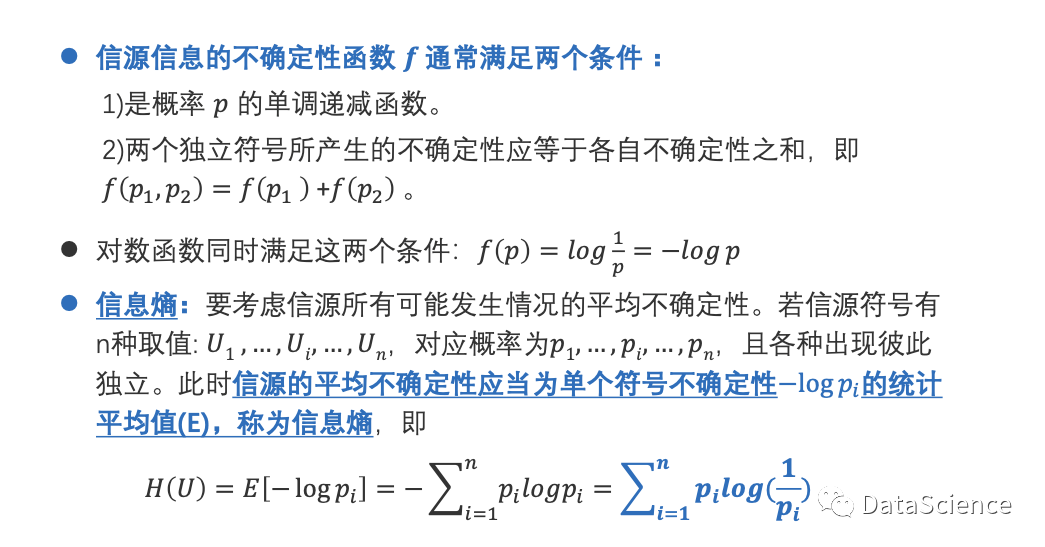

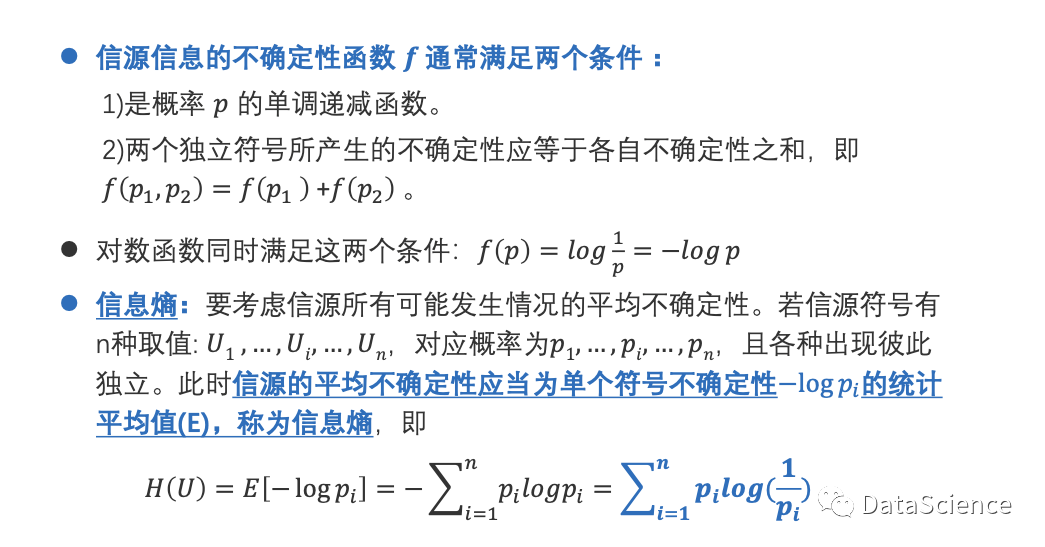

信息熵

log(1/p)的图像如下,是单调递减函数,不确定性越大,事件发生的概率越小。需要指出的是,H(U)式子中的对数是以2为底数,信息熵的单位是比特;在sklearn中,以自然对数e为底。

前言:本文讲解了机器学习需要用到的信息论中关于信息熵的知识,并用代码演示如何计算信息熵和互信息。

信息熵 Information Entropy

信息论中的熵(entropy)

信息熵

log(1/p)的图像如下,是单调递减函数,不确定性越大,事件发生的概率越小。需要指出的是,H(U)式子中的对数是以2为底数,信息熵的单位是比特;在sklearn中,以自然对数e为底。

225

225

510

510

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?