文章目录

摘要

域自适应(DA)方法在广泛的机器学习和计算机视觉任务(即分类、检测和分割)中取得了显著的改进。然而,很少有方法可以直接在3D点云数据上实现域自适应。点云数据的独特挑战在于其丰富的空间几何信息,而整个对象的语义是通过包含区域几何结构来实现的。具体而言,大多数通用DA方法难以实现全局特征对齐并且忽略了局部几何信息,因此不适用于3D域对齐。在本文中,我们提出了一种新的点云数据三维域自适应网络(PointDAN)。PointDAN以多层次方式联合对齐全局和局部功能。对于局部对齐,我们提出了具有动态感受野的自适应(SA)节点模块来建模用于对齐域的可区分局部结构。为了表示分层缩放的特征,进一步引入节点注意模块来加权对象和域之间的SA节点关系。对于全局对齐,采用对抗训练策略来学习和对齐跨域的全局特征。由于3D点云DA场景没有通用的评估基准,我们从三个流行的3D对象/场景数据集(即ModelNet、ShapeNet和ScanNet)中提取一个通用基准(即PointDA-10),用于跨域3D对象分类。在PointDA-10上的大量实验表明,我们的模型优于最先进的通用DA方法。

1.介绍

3D视觉在广泛的现实世界应用(如自动驾驶汽车、机器人和监控系统)中取得了有希望的成果。如今,深度相机或激光雷达传感器捕获了大量的三维点云数据。需要复杂的3D视觉和机器学习算法来分析其内容,以便进一步开发。最近,深度神经网络(DNN)的出现极大地提高了3D视觉理解的性能,包括分类、检测和分割任务。尽管DNN取得了令人印象深刻的成功,但它需要大量的标记数据用于培训,这既耗时又昂贵。这个问题极大地限制了它在现实世界中的推广。

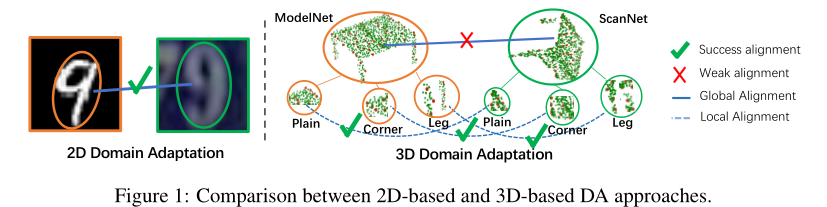

域适配(DA)通过利用具有丰富标签的数据集(源域)的知识建立模型来解决这一问题,它在标签稀缺的数据集(目标域)上具有很好的泛化性。然而,由于分布在不同域/数据集之间的变化,在一个域上训练的模型通常在其他域上表现不佳。大多数DA方法通过将原始特征映射到共享子空间或最小化实例级距离(如MMD、CORALetc)来解决此问题,混合跨域特征。目前,受生成性对抗网络(GAN)的启发,对抗性训练DA方法,如DANN、ADDA、MCDA等,在DA方面取得了令人满意的性能,并引起了越来越多的关注。他们在鉴别器和生成器之间展开零和博弈,以学习域不变表示。然而,大多数现有的DA方法主要针对2D视觉任务,该任务全局地调整不同领域之间的分布变化。而对于三维点云数据,可以对三维空间中的几何结构进行详细描述,不同的局部结构也有明确的语义含义,如椅子的腿,这反过来又结合起来形成整个对象的全局语义。如图1所示,两个3D对象可能很难在全局中对齐,但具有相似的3D局部结构,更容易对齐。因此,迫切需要一个领域适应框架来关注3D DA场景中的局部几何结构。

为此,本文介绍了一种新的基于点的无监督域自适应网络(PointDAN),用于实现三维点云数据的无监督域自适应(UDA)。我们方法的关键是联合调整多尺度,即,以端到端的方式提供点云数据的全局和局部特征。特别地,提出了与动态感受野相关联的自适应(SA)节点来动态地收集和对齐跨域的局部特征。此外,还设计了一个节点注意模块,用于探索和解释节点之间的关系及其在对齐中的贡献。同时,部署了对抗性训练策略,以在全球范围内调整全球功能。由于以前很少有针对3D数据(即点云)的DA基准测试,我们为3D vision DA构建了一个新的基准测试,名为PointDA-10 dataset。它是通过在三个流行的数据集(即ModelNet、ShapeNet和ScanNet)中选择10个重叠类别的样本生成的。

贡献:

- 介绍了一种新的基于3D点的无监督域自适应方法,通过局部和全局对齐3D对象在不同域中的分布。

- 对于局部特征对齐,我们提出了具有节点注意的自适应(SA)节点,以利用局部几何信息并动态收集区域结构,以对齐不同域的局部分布。

- 收集了一个新的3D点云DA基准,命名为PointDA-10数据集,用于公平评估3D DA方法。在PointDA-10上的大量实验表明,我们的模型优于最先进的通用DA方法。

2.相关工作

2.1 3D Vision Understanding

3D vision具有多种数据表示方式:多视图、体素网格、3D网格和点云数据。在上述模式中,由一组具有三维坐标{x,y,z}的点表示的点云是保存三维空间信息的最直接表示。点云可以通过激光雷达传感器直接获取,这带来了从场景分割到自动驾驶等许多三维环境理解应用。PointNet是第一个直接处理点云的深度神经网络,它提出了一个对称函数和一个空间变换网络来获得对点置换的不变性。然而,局部几何信息对于描述三维空间中的物体至关重要,而PointNet却忽略了这一点。因此,最近的工作主要集中在如何有效利用局部特征上。例如,在PointNet++中,一系列的PointNet结构应用于具有不同大小的局部点集,并且以分层方式收集局部特征。PointCNN提出了x-Conv来聚合局部pitch中的特征,并采用了自底向上的网络结构,类似于典型的CNN。

尽管广泛使用,点云数据在标记效率方面存在明显的缺点。在贴标签的过程中,人们需要旋转几次,从不同的角度观察来识别一个物体。在从激光雷达扫描点云数据的真实环境中,某些部分也会丢失或被遮挡(例如桌子失去腿),这使得有效的标记更加困难。在这种情况下,非常需要一种特定的基于3D点的无监督域自适应方法来缓解源标记数据和目标未标记数据的域间隙。

2.2 Unsupervised Domain Adaptation (UDA)

UDA的主要挑战是目标域和源域之间存在分布转移(即域差距)。它违背了传统机器学习算法的基本假设,即训练样本和测试样本具有相同的分布。为了弥补领域差距,UDA方法通过特征对齐匹配域之间的边际分布或条件分布。它通过学习映射函数来解决这个问题,映射函数将原始图像特征投影到跨域的共享特征空间中。大多数算法都试图使类间差异最大化,同时最小化子空间中的类内距离。

除上述方法外,许多基于DNN的领域自适应方法因其在表征学习方面的强大能力而被提出。这些方法的关键是通过端到端的训练场景应用DNN学习域不变特征。另一种方法利用对抗训练策略获得域不变表示。它包括鉴别器和生成器,其中生成器旨在欺骗鉴别器,直到鉴别器无法区分两个域之间生成的特征。这些方法包括对抗区分域自适应(ADDA),域对抗神经网络(DANN),最大分类器差异(MCD)等。

大多数UDA方法都是为2D视觉任务而设计的,主要关注不同域的全局图像特征对齐。而在三维数据分析任务中,区域和局部几何信息对于实现良好的学习性能至关重要。我们提出了一个通用的基于3D点的UDA框架。它很好地保留了局部结构,并探索了所有局部特征的全局相关性。进一步采用对抗训练策略,在局部和全局范围内调整源域和目标域的分布转移。

3.Model

3.1 Problem Definition and Notation

在基于3D点的UDA中,我们可以访问有标签的源域 S = { x i s , y i s } i = 1 n s \mathcal{S}=\{x_i^s,y_i^s\}_{i=1}^{n_s} S={

xis,yis}i=1ns,目标域 T = { x j t } j = 1 n t \mathcal{T}=\{x_j^t\}_{j=1}^{n_t} T={

xjt}j=1nt,其中 n t n_t nt是无标签数据点。输入是通常由三维坐标(x,y,z)表示的点云数据,源域和目标域具有相同的标签空间。进一步假设两个域分别从 P s ( x i s , y i s ) P_s(x_i^s,y_i^s) Ps(xis,yis)和 P t ( x i t , y i t ) P_t(x_i^t,y_i^t) Pt(xit,yit)中采样,而分布位移 P s ≠ P t P_s \neq P_t Ps=Pt违背了i.i.d假设。

UDA的关键在于为跨域样本学习一个映射方程 Φ : X → R d \Phi:\mathcal{X}→\R^d Φ:X→Rd

本文提出了一种新的点云数据三维域自适应网络PointDAN,用于无监督域自适应。PointDAN通过局部和全局特征对齐,特别是在局部使用自适应节点模块来捕获和对齐局部几何信息。实验表明,PointDAN在3D点云数据的域适应中优于现有方法。

本文提出了一种新的点云数据三维域自适应网络PointDAN,用于无监督域自适应。PointDAN通过局部和全局特征对齐,特别是在局部使用自适应节点模块来捕获和对齐局部几何信息。实验表明,PointDAN在3D点云数据的域适应中优于现有方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1542

1542

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?