官方预训练模型转换

- 下载yolov5-v6.0分支源码解压到本地,并配置基础运行环境。

- 下载官方预训练模型

- 进入yolov5-6.0目录下,新建文件夹weights,并将步骤2中下载的权重文件放进去。

- 修改models/yolo.py文件

def forward(self, x):

z = [] # inference output

for i in range(self.nl):

x[i] = self.m[i](x[i]) # conv

bs, _, ny, nx = x[i].shape # x(bs,255,20,20) to x(bs,3,20,20,85)

x[i] = x[i].view(bs, self.na, self.no, ny, nx).permute(0, 1, 3, 4, 2).contiguous()

return x[0], x[1], x[2]

- 命令行执行

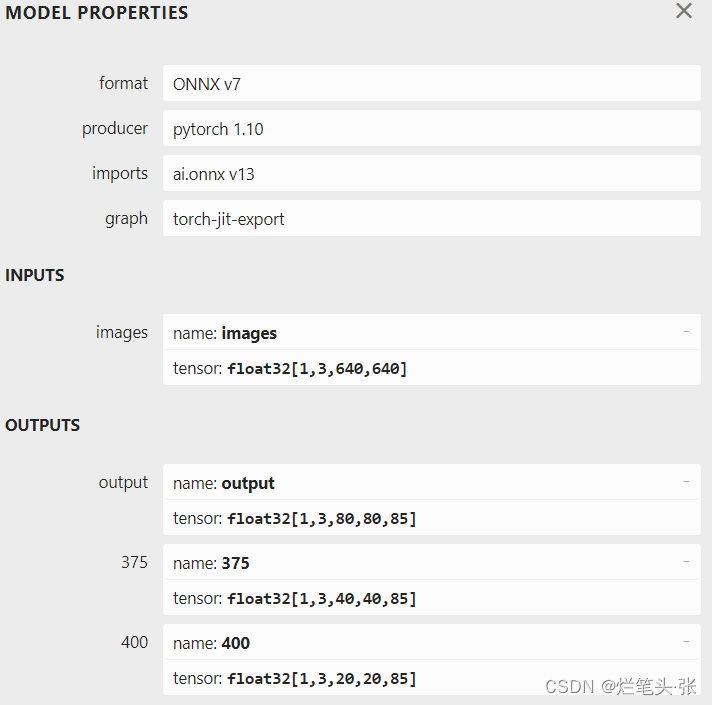

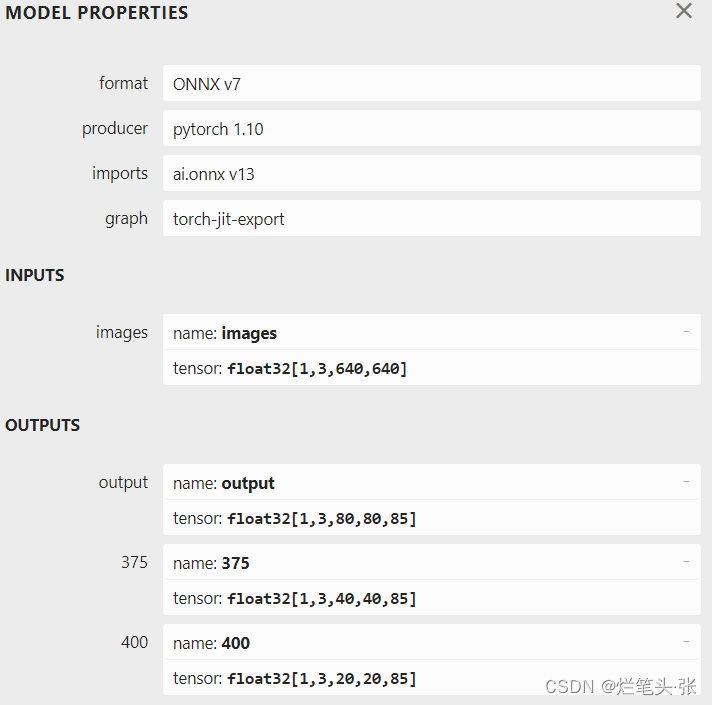

python3 export.py --weights weights/yolov5n.pt --include onnx --simplify (默认为yolov5n.pt,转换成功会输出一下信息, 转换后的模型存于权重同级目录yolov5n.onnx后缀模型)

ONNX: simplifying with onnx-simplifier 0.4.33...

ONNX: export success, saved as weights/yolov5n.onnx (7.5 MB)

ONNX: run --dynamic ONNX model inference with: 'python detect.py --weights weights/yolov5n.onnx'

Export complete (1.24s)

- onnx转ncnn

- 编译ncnn源码

- 利用ncnn库的./onnx2ncnn 工具进行转换

onnx2ncnn *.onnx *.param *.bin - 优化graph

./ncnnoptimize *.param *.bin new.param new_bin 1 0(fp32)/1(fp16) - 修改Permute节点维度全部设为0=-1

腾讯NCNN加载推理篇

- 使用NCNN SDK接口加载推理模型, 后续会放出代码,支持fp16/int8精度。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?