之前一直用的chatGLM2,将FastGPT本地化跑通后,现在试试将chatGLM2升级为chatGLM3。升级就比较顺利了,过程如下,该过程参考了哔哩哔哩网站的一个视频。连接如下:

23 本地化部署ChatGLM3-6B模型_哔哩哔哩_bilibili

21 OpenAI风格API调用_哔哩哔哩_bilibili

1、用conda建立虚拟环境

conda create --name chatglm3_multi python-3.11

切换到虚拟环境:

conda activate chatglm3_multi

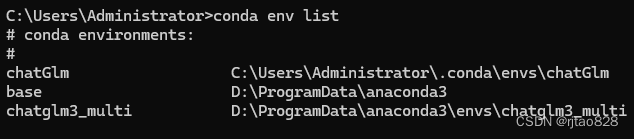

可以使用conda env list查看已经创建的虚拟环境:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5364

5364

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?