2020.08.16

迁移的目标就是利用源域和目标域的相似性,使得在源域上训练好的网络在目标域上有好的效果。

本文为减小目标域样本和源域样本的差异,有两个步骤:1、Maximize domain confusion,减小两个域之间的距离;2、Transfer task correlation,从源域学习到样本中类之间的关系,使得目标域中类间关系和源域的相似。

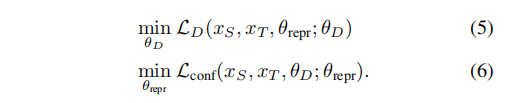

lay1-7 是五层cnn+两层全连接层,网络参数是θrepr;fcD 参数是θD;fc8参数是θC。

通过上面的损失函数,训练得到lay1-8的参数,即θrepr、θC。

首先看分类损失,对于有标签的目标域数据进行训练,错误分类的越多,损失函数越大。

式(5)是domain classifier loss

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1228

1228

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?