简介

先看官方文档,TFLite是为了将深度学习模型部署在移动端和嵌入式设备的工具包,可以把训练好的TF模型通过转化、部署和优化三个步骤,达到提升运算速度,减少内存、显存占用的效果。

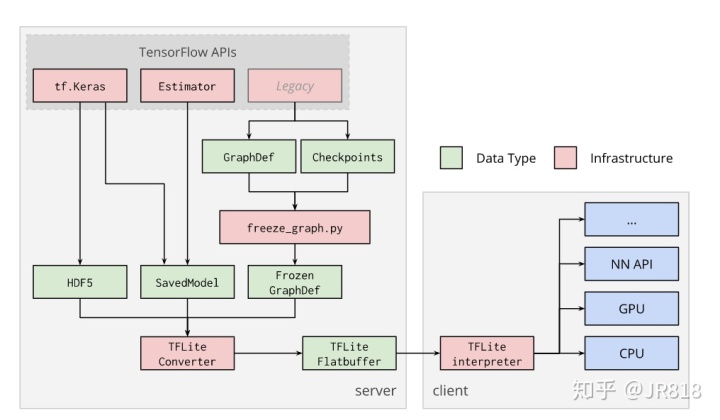

如下图,TFlite主要由Converter(左)和Interpreter(右)组成。Converter负责把TensorFlow训练好的模型转化,并输出为.tflite文件(FlatBuffer格式)。转化的同时,还完成了对网络的优化,如量化。Interpreter则负责把.tflite部署到移动端,嵌入式(embedded linux device)和microcontroller,并高效地执行推理过程,同时提供API接口给Python,Objective-C,Swift,Java等多种语言。简单来说,Converter负责打包优化模型,Interpreter负责高效易用地执行推理。

转化

TFLite支持的转化方式有,对于1.x版本,SavedModel, HDF5, PB, Session,把其转化为FlatBuffer文件供Interpreter执行。值得注意的是,转化需要明确输入和输出的节点。我猜测TFlite会根据这些节点自动优化网络结构。

- Session(推荐),直接把网络和参数恢复到session里,再直接通过session导入到converter中就好了

import tensorflow as tf

img = tf.placeholder(name="img", dtype=tf.float32, shape=(1, 64, 64, 3))

var = tf.get_variable("weights", dtype=tf.float32, shape=(1, 64, 64, 3))

val = img + var

out = tf.identity(val, name="out")

with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

converter = tf.lite.TFLiteConverter.from_session(sess, [img], [out])

tflite_model = converter.convert()

open("converted_model.tflite", "wb").write(tflite_model)- PB:需要

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2405

2405

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?