大家好,我是微学AI,今天给大家带来深度学习技巧应用3-神经网络中的超参数搜索。

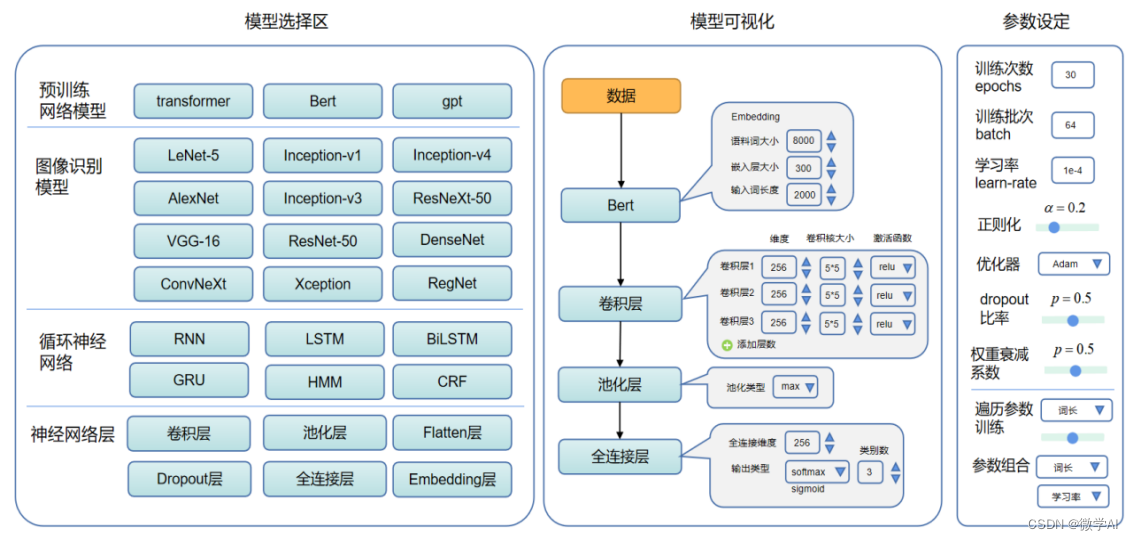

在深度学习任务中,一个算法模型的性能往往受到很多超参数的影响。超参数是指在模型训练之前需要我们手动设定的参数,例如:学习率、正则化强度、网络层级结构、训练批次、训练次数等。为了得到最佳的超参数设置,可以采用超参数搜索的方式,搜索最佳的超参数组合。

超参数搜索是一种通过自动化方法寻找最佳超参数设置的技术。目标是通过系统地搜索超参数空间来最小化模型的误差或最大化模型的表现。超参数搜索是一个非常耗时和繁重的任务,因为可能需要在很广的超参数空间内搜索,而每个超参数组合都需要训练模型并进行评估。

一、常见的超参数搜索方法:

网格搜索:网格搜索是一种通过遍历超参数空间中所有可能的组合来搜索最佳超参数的方法。具体地,将每个超参数的可能取值组成一个网格,然后对所有可能的组合进行训练和评估,从而找到最佳的超参数组合。

随机搜索:随机搜索是一种通过在超参数空间中随机采样来搜索最佳超参数的方法。具体地,随机选择一组超参数进行训练和评估,然后根据评估结果调整下一组超参数的选择。

贝叶斯优化:贝叶斯优化是一种通过构建高斯过程模型来搜索最佳超参数的方法。具体地,通过不断地调整高斯过程模型的参数,来寻找最佳的超参数组合。

订阅专栏 解锁全文

订阅专栏 解锁全文

229

229

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?