强化学习

小白记录强化学习相关的心路历程

TheWindOfJune

这个作者很懒,什么都没留下…

展开

-

gym中env的unwrapped

import gymenv_name = 'CartPole-v0'env = gym.make(env_name)print(env)<TimeLimit<CartPoleEnv<CartPole-v0>>>print(env.unwrapped)<CartPoleEnv<CartPole-v0>>区别如上所示,不加unwrapped的话,这个env是被套了一层壳的,每个episode是有步数的限制的。...原创 2021-03-10 16:39:06 · 576 阅读 · 0 评论 -

怎样理解Actor-Critic与Policy Gradient之间的关系

其实不应该把Actor-Critic看做是DQN和PG之间的结合PG是通过MC方法来获得总的回报G的,而这个方式其实有点慢,需要完整的采样。而TD就是针对这个问题改进的措施,DQN本质是哪个就是用网络来逼近TD这个算法,Actor-Critic 可以看做是用TD的方法来改进PG...原创 2021-02-03 10:29:18 · 488 阅读 · 0 评论 -

序贯决策与强化学习

https://www.jiqizhixin.com/graph/technologies/2efcaf86-4dd0-4984-901f-241802b1316f原创 2021-01-25 10:57:21 · 1070 阅读 · 0 评论 -

强化学习实验中的技巧

https://github.com/transedward/pytorch-dqn/blob/master/utils/seed.py原创 2021-01-23 19:37:30 · 363 阅读 · 0 评论 -

深度强化学习调参方法

https://zhuanlan.zhihu.com/p/99901400原创 2021-01-08 00:00:39 · 601 阅读 · 0 评论 -

贝尔曼方程中的深刻数学原理

https://www.sohu.com/a/380315869_701814原创 2020-07-20 17:50:49 · 330 阅读 · 0 评论 -

强化学习的两大基本问题

预测即给定强化学习的6个要素:状态集S, 动作集A, 模型状态转化概率矩阵P, 即时奖励R,衰减因子γ, 给定策略π, 求解该策略的状态价值函数v(π)控制也就是求解最优的价值函数和策略。给定强化学习的5个要素:状态集S, 动作集A, 模型状态转化概率矩阵P, 即时奖励R,衰减因子γ, 求解最优的状态价值函数v∗和最优策略π∗ ...原创 2020-07-10 22:13:12 · 390 阅读 · 0 评论 -

借鉴别人的强化学习专栏

https://blog.csdn.net/philthinker/category_6891557.html原创 2020-06-13 23:16:45 · 220 阅读 · 0 评论 -

gym入门博客

https://blog.csdn.net/u013745804/category_7251172.htmlhttps://zhuanlan.zhihu.com/p/26985029https://zhuanlan.zhihu.com/p/26250938原创 2020-06-06 09:48:10 · 222 阅读 · 0 评论 -

FrozenLake中的值迭代和策略迭代举例【代码】

值迭代import numpy as npimport gym# render()是图像引擎,无参数# step()是物理引擎,输入参数为动作# 迭代运行 episodedef run_episode(env, policy, gamma = 1.0, render = False): """ Evaluates policy by using it to run an episode and finding its total reward. args:自变量原创 2020-06-06 16:46:37 · 1086 阅读 · 0 评论 -

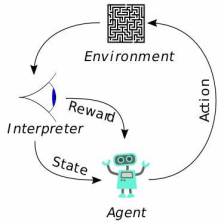

1. 强化学习之——课前概论

强化学习的一些最基础又最重要的概念总结原创 2020-05-24 19:06:08 · 719 阅读 · 0 评论 -

2. 强化学习之——马尔科夫决策过程

目录马尔科夫链马尔科夫奖励过程马尔科夫决策过程马尔科夫决策过程中的策略估计马尔科夫决策过程中的控制策略迭代值迭代马尔科夫链马尔科夫性:未来的转移跟过去是独立的,它只取决于现在状态转移矩阵:(每一个元素都是一个概率分布)马尔科夫链的举例:当从状态 S3 开始时,可以对链进行采样,得到很多串轨迹(下面3串只是作为举例)马尔科夫奖励过程(MRP)马尔科夫奖励过程 = 马尔科夫链+ 奖励奖励其实是一个期望(当你到某一个状态时可以获得多大的奖励.原创 2020-06-03 01:02:59 · 3333 阅读 · 4 评论 -

3. 强化学习之——无模型的价值函数估计和控制

本次课程主要内容:model-free prediction:估计一个未知 MDP 模型的 value functionmodel-free control:优化一个未知 MDP 模型的 value function回顾上次课讲的马尔科夫决策过程:什么叫MDP已知:Agent 已知奖励函数 R 和状态转移矩阵 P,这也是我们进行策略迭代policy iteration和值迭代value iteration寻找最佳策略的基本要求策略迭代包含:policy evaluation + poli原创 2020-06-09 11:38:10 · 1892 阅读 · 0 评论 -

4. 强化学习之——值函数近似

课程纲要值函数近似简介值函数近似用于prediction【给定策略函数给定它的价值】值函数近似用于controlDQN简介为什么要有值函数近似之前的课程提到的 RL 问题:像 Cliff Walk 等,都只有几千或者几百种状态,可以用 V值的向量或者Q-Table 的方式表达出来而其它大规模的 MDP 问题:像 Go【10**170】 等状态空间十分十分巨大,宇宙中的原子数量也只有 10**80 那么多,那么我们就没有那么大的存储空间,而且状态太多了学习起来很慢很慢在这种大.原创 2020-06-11 16:39:22 · 2409 阅读 · 0 评论 -

5. 强化学习之——策略优化

课程大纲基于策略的强化学习:前面讲的都是基于价值的强化学习,这次讲基于策略函数去优化的强化学习蒙特卡罗策略梯度如何降低策略梯度的方差Actor-Critic:同时学习策略函数和价值函数基于策略的强化学习基础知识Value-based RL 与 Policy-based RL:Policy-based RL 的优势与劣势:策略的分类:(1)确定性策略(2)概率分布性策略对策略进行优化的过程中,优化目标是什么?给定一个带参数的策略逼近函数(类似于值函数逼.原创 2020-06-15 00:19:14 · 5426 阅读 · 0 评论 -

6. 强化学习之——策略优化进阶

课程大纲Policy Gradient 算法的不同的变种近五年的最新策略优化过程【6种方法,2条主线】主线一:Policy Gradient ->Natural Policy Gradient -> TRPO -> ACKTR -> PPO主线二:Q-Learning -> DDPG ->TD3 -> SACPolicy Gradient 算法的不同形式总结一下:Policy Gradient 有许多不同的形式是因为 reward f原创 2020-06-16 13:00:03 · 877 阅读 · 2 评论 -

7. 强化学习之——基于模型的强化学习

课程大纲model-based RL 概要model-based value optimizationmodel-based policy optimizationcase study基于模型的强化学习概要之前学 model-free RL 的时候(1)从经验中利用 policy gradient 直接学习 policy(2)利用 MC 或者 TD 学习 value function本次课将会讲到 model-based RL【在讲 MDP 时有提到,有model 时就.原创 2020-06-16 23:19:41 · 7292 阅读 · 0 评论 -

8. 强化学习之——模仿学习

课程大纲注:本文所有内容源自于B站周博磊老师更新完的强化学习纲要课程,听完之后获益很多,本文也是分享我的听课笔记。周老师Bilibili视频个人主页:https://space.bilibili.com/511221970?spm_id_from=333.788.b_765f7570696e666f.2感谢周老师 :)...原创 2020-06-27 00:48:59 · 4304 阅读 · 2 评论

分享

分享