论文阅读笔记( 一 ):Graph-Evolving Meta-Learning for Low-Resource Medical Dialogue Generation

“知识是基础,汗水是实践,灵感是思想火花,思想火花人人有,不要放弃它。Chance favors the prepared mind.”——袁隆平寄语青年人

文章目录

关于论文

文章收录于AAAI(美国人工智能协会)2021

作者:Shuai L1, Pan Zhou2, Xiaodan Liang1,3,Jianheng Tang1, Ruihui Zhao4, Ziliang Chen1, and Liang Lin1,3

1Sun Yat-sen University,2Salesforce Research,3DarkMatter AI Inc.,4Tencent Jarvis Lab

1 摘要

具有丰富医学经验的医生能够仅仅通过简单的和病人交谈症状来确诊病人所患的的疾病。相比之下,现有的以知识为基础的对话系统通常需要大量的对话和实例来学习,因为无法捕捉不同疾病之间的相关性和忽略它们之间共享的诊断经验。

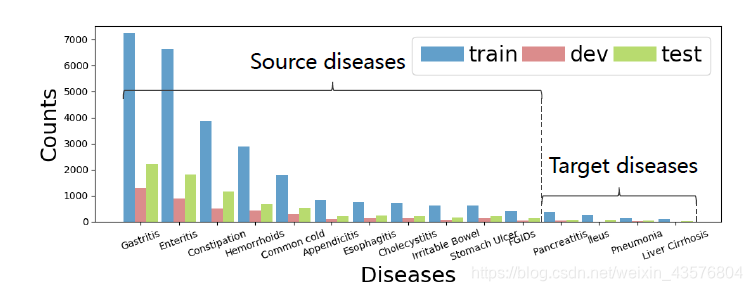

图1:新收集的春雨数据集中15种疾病统计,反映出不同疾病中显著的数据不平衡现象。

为了解决上述问题,论文提出一个更为自然更为使用的范例,即低资源医疗对话生成器,能够将诊断经验从疾病到具有少数数据的疾病,利用的一个常识图来反映疾病-症状的相关性。除此之外,论文提出了一个图进化元学习(GEML)框架,该框架学习进化出常识图来推理新疾病的症状相关性,有效地缓解了大量对话的需求。

2 端对端的对话系统

论文首先提出了一个低资源医疗对话生成的端到端对话系统。该模型无缝地集成了三个组件,一个层次上下文编码器、一个元知识图推理(MGR)网络和一个图引导响应生成器。具体地说,上下文编码器首先将会话历史编码为层次上下文表示。然后,MGR将所获得的表示纳入知识图推理过程中,以理解疾病-症状的相关性。最后,图引导解码器通过在图实体节点上设计良好的复制机制来生成信息响应。

图2:框架概述。上:提出的低资源医学对话生成的GEML-MGR概述。GEML-MGR首先通过元训练阶段,学习和进化一个元知识图,然后适应新的目标疾病。下一层:端到端医学对话模型的架构,它无缝地集成了三个组件:层次上下文编码器、元知识图推理和图引导响应生成器。

2.1 层次上下文编码器

论文利用一个分层的上下文编码器对对话历史进行编码,得到上下文的分层隐藏表示。

给定一个对话集,层次上下文编码器首先利用长-短期记忆(LSTM)网络来将每个话语编码为一个隐藏的表示A。然后,将这些隐含的话语表征输入到另一个LSTM中,得到整个对话历史的表征B。首先用A初始化知识图的话语节点特征,然后采用B作为译码器LSTM的初始状态,首先用隐藏的表示A初始化知识图的话语节点特征,然后采用整个对话历史的表征B作为译码器LSTM的初始状态

2.2元知识图推理(MGR)

基于获得的话语表征,我们需要了解疾病-症状的相关性,并进一步询问患者是否存在相关症状来验证。论文的MGR旨在:

(1)通过与患者的对话来解释疾病和症状的相关性

(2)预测下一次调查/对患者的可能症状

(3)将这个常识性的疾病症状图演变为具有进化元学习(GEML)的元知识图框架。

为了促进实体节点之间的信息传播,论文构建了一个元知识图,其中每个实体节点表示一种疾病或症状。具体来说,我们将最终的节点表示形式输入到一个前馈层中,并通过对所有图实体节点的二进制分类来预测下一个响应中可能的实体。通过这种方式,我们的MGR网络可以挖掘和推理疾病症状的相关性,从而预测下一个反应中的潜在实体,以便更准确地诊断。

2.3 图引导响应生成器

为了将知识图整合到生成器中,我们设计了一个图引导响应生成器。主要的改进是我们将复制机制应用于图节点分布,而不是输入源。更具体地说,在实体节点表示的指导下,解码器通过从词汇表中采样或直接从图形实体节点集复制来在时间步生成每个单词。

利用图导的复制机制,响应生成器可以实现更准确的症状请求和疾病诊断结果。受图注意网络的启发,论文设计了由两个图推理层组成的元知识图推理(MGR)网络。受图注意网络的启发,我们设计了由两个图推理层组成的元知识图推理(MGR)网络。

3 图进化的元学习

由于现实世界中的许多疾病如前所述是罕见的和昂贵的,因此这种设置更加实际和具有挑战性。为了应对这一挑战,论文提出图进化的元学习(GEML)使用元知识转移和元知识图进化来转移不同疾病的诊断经验。

3.1 元知识转移

利用参数训练一个就有参数化的医学对话模型,使其具备快速适应能力。

3.2 元知识图进化

由于常识图是稀疏的,并且没有覆盖足够的症状实体,所以在这个先验图和真实的对话示例之间存在差距。为了应对这一挑战,论文运用对话实例演化常识图,并在元训练和适应阶段学习诱导元知识图,从而解决常识图的稀疏性,使其尽可能覆盖足够多的症状实体。上述的图结构演化方法可以在忽略疾病症状相关性强度的情况下推断疾病症状相关性的存在。

4 结论

在这项工作中,我们提出了一个端到端的低资源医学对话生成模型,该模型从源疾病元学习模型初始化,具有快速适应新疾病的能力。此外,我们提出一个图演化元学习(GEML)框架,学习快速演化元知识图,以适应新的疾病和推理疾病-症状的相关性。因此,我们的对话生成模型具有快速学习能力,能够很好地处理低资源的医学对话任务。

写在最后:

本人研究方向和兴趣点大致为自然语言处理、大数据医疗、数据分析和跨境电商,刚开始学习研究,本专题翻译一些顶会期刊,希望能坚持做下去,欢迎有兴趣或者研究方向差不多的朋友一起交流讨论,需要论文原文可私信。

366

366

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?