论文名称:《NON-DEEP NETWORKS》

论文地址:https://arxiv.org/pdf/2110.07641.pdf

代码地址:https://github.com/imankgoyal/NonDeepNetworks

文章目录

1 原理

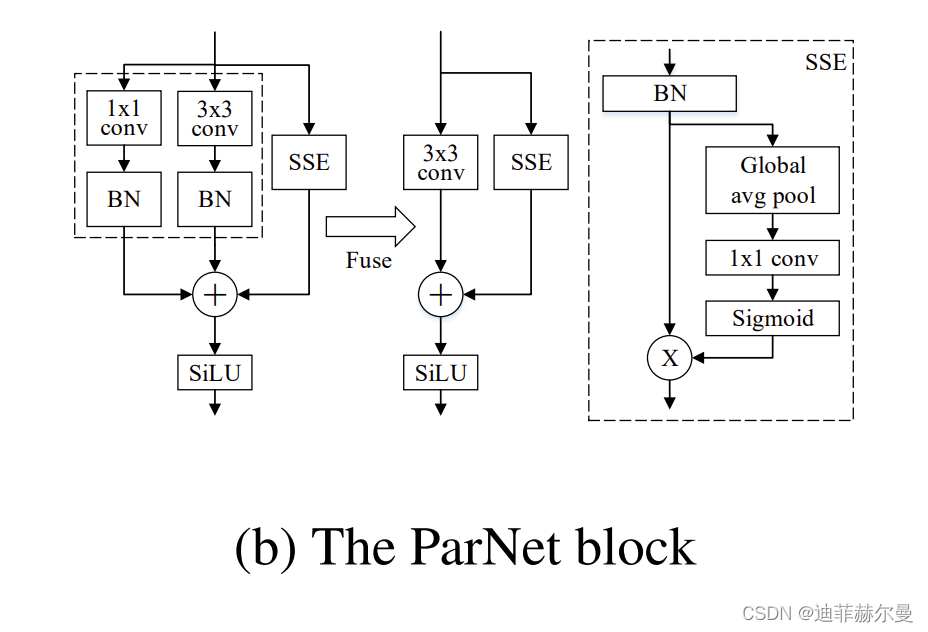

深度是深度神经网络的标志。但更深的网络意味着更多的顺序计算和更高的延迟。这引出了一个问题:是否可能构建表现优秀的“非深度”神经网络?我们证明了这是可能的。为了实现这一点,我们使用并行子网络而不是一个接一个地堆叠层。这有助于在保持高性能的同时有效地减少深度。通过利用并行子结构,我们首次展示了一个深度仅为12的网络可以在ImageNet上实现超过80%的Top-1准确率,在CIFAR10上达到96%,在CIFAR100上达到81%。我们还展示了一个具有低深度(12)主干的网络在MS-COCO上可以实现

订阅专栏 解锁全文

订阅专栏 解锁全文

316

316

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?