PyTorch学习笔记(9)–神经网络:线性层

本博文是PyTorch的学习笔记,第9次内容记录,主要介绍神经网络线性层的基本使用。

1.什么是线性层

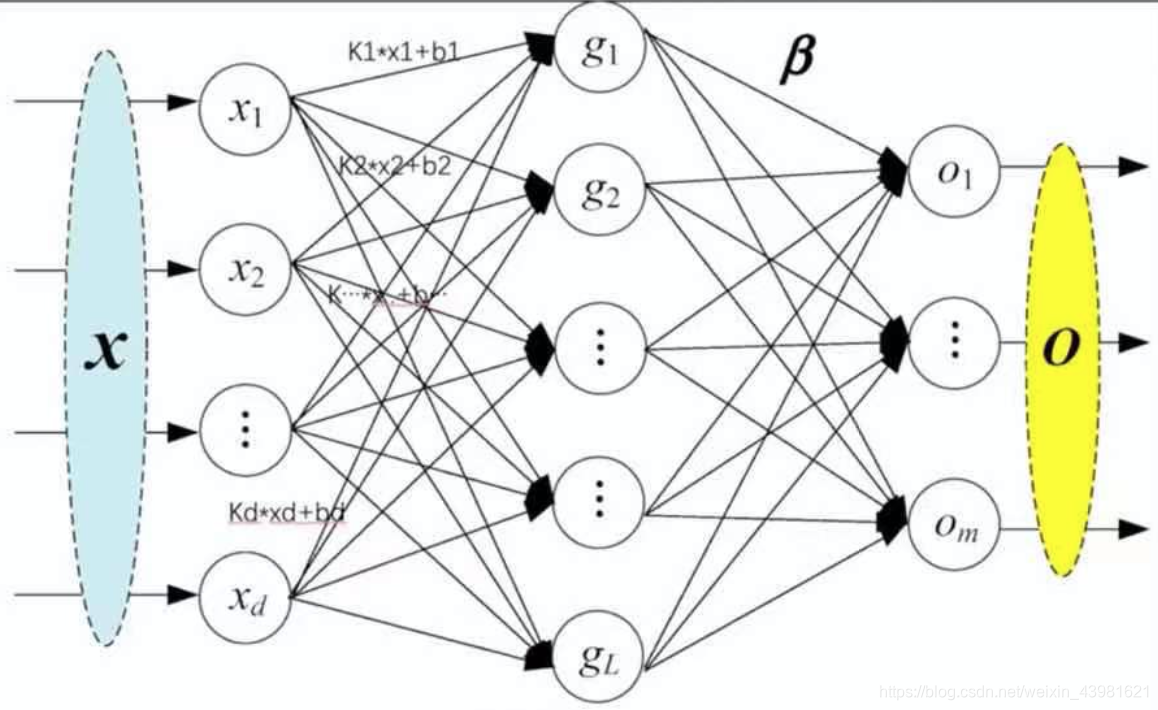

线性层又叫全连接层,其中每个神经元与上一层所有神经元相连,一个简单的线性层如下图所示:

2.线性层

2.1线性激活函数相关参数

在PyTorch官网中,详细介绍了线性层的详细情况,线性函数为:torch.nn.Linear(in_features, out_features, bias=True, device=None, dtype=None),其中重要的3个参数in_features、out_features、bias说明如下:

- in_features:每个输入(x)样本的特征的大小

- out_features:每个输出(y)样本的特征的大小

- bias:如果设置为False,则图层不会学习附加偏差。默认值是True,表示增加学习偏置。

在上图中,in_features=d,out_features=L。

2.2线性层应用举例1

现以CIFAR10图片数据集为数据集,线性层实现代码如下:

# coding :UTF-8

# 文件功能: 代码实现神经网络--线性层功能

# 开发人员: dpp

# 开发时间: 2021/8/17 10:28 下午

# 文件名称: nn_linear.py

# 开发工具: PyCharm

import torch

import torchvision

from torch import nn

from torch.nn import Linear

from torch.utils.data import DataLoader

dataset = torchvision.datasets.CIFAR10("CIFAR10", train=False,

transform=torchvision.transforms.ToTensor(),

download=True)

dataloader = DataLoader(dataset, batch_size=64)

class Test(nn.Module):

def __init__(self):

super(Test,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2025

2025

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?