2月2日晚,CCF-Talk 举办了主题为“夜话DeepSeek:技术原理与未来方向“的线上研讨会。清华大学长聘副教授、面壁智能首席科学家刘知远老师作为主讲嘉宾之一,为大家带来了关于“大模型强化学习技术原理与大模型技术发展研判”的精彩演讲。

在圆桌环节,还围绕业界热点话题做了探讨:如何复现o1大推理模型?DeepSeek R1技术路线和训练流程有哪些亮点?为什么DeepSeek能做到轰动全球?DeepSeek 通过哪些优化策略有效降低成本?DeepSeek 的写作能力为何飞跃?MoE 架构会是最优解吗?PTX 是否真正做到了绕开 CUDA 的垄断?

刘知远表示,OpenAI o1 相当于引爆了一颗原子弹,但没有告诉大家秘方。DeepSeek 则可能是全球首个能够通过纯粹的强化学习技术复现 OpenAI o1 能力的团队,他们通过开源并发布相对详细的介绍,为行业发展做出了重要贡献。由于开源,DeepSeek R1 让全世界意识到深度思考的能力,相当于让整个人工智能领域迎来了类似于 2023 年初的 ChatGPT 时刻。大家感受到大模型的能力又往前迈进了一大步。我们应该学习的是他们的技术理想、坚持与方法论。

首先,我们来看 DeepSeek 最近发布的 R1 模型,它具有非常重要的价值。这种价值主要体现在 DeepSeek R1 能够完美复现 OpenAI o1 的深度推理能力。

因为 OpenAI o1 本身并没有提供关于其实现细节的任何信息,OpenAI o1 相当于引爆了一个原子弹,但没有告诉大家秘方。而我们需要从头开始,自己去寻找如何复现这种能力的方法。DeepSeek 可能是全球首个能够通过纯粹的强化学习技术复现 OpenAI o1 能力的团队,并且他们通过开源并发布相对详细的介绍,为行业做出了重要贡献。

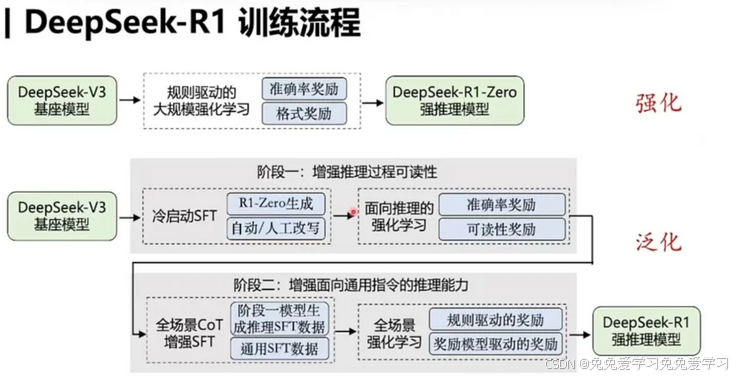

我们大致总结了 DeepSeek R1 的整个训练流程,它有两个非常重要的亮点或价值。首先,DeepSeek R1 创造性地基于 DeepSeek V3 基座模型,通过大规模强化学习技术,得到了一个纯粹通过强化学习增强的强推理模型,即 DeepSeek-R1-Zero。这具有非常重要的价值,因为在历史上几乎没有团队能够成功地将强化学习技术很好地应用于大规模模型上,并实现大规模训练。DeepSeek 能够实现大规模强化学习的一个重要技术特点是其采用了基于规则(rule-based)的方法,确保强化学习可以规模化,并实现面向强化学习的扩展(Scaling),这是它的第一个贡献。

DeepSeek R1 的第二个重要贡献在于其强化学习技术不仅局限于数学、算法代码等容易提供奖励信号的领域,还能创造性地将强化学习带来的强推理能力泛化到其他领域。这也是用户在实际使用 DeepSeek R1 进行写作等任务时,能够感受到其强大的深度思考能力的原因。

这种泛化能力的实现分为两个阶段。首先,基于 DeepSeek V3 基座模型,通过增强推理过程的可读性,生成了带有深度推理能力的 SFT(Supervised Fine-Tuning,监督微调)数据。这种数据结合了深度推理能力和传统通用 SFT 数据,用于微调大模型。随后,进一步通过强化学习训练,得到了具有强大泛化能力的强推理模型,即 DeepSeek R1。

因此,DeepSeek R1 的重要贡献体现在两个方面:一是通过规则驱动的方法实现了大规模强化学习;二是通过深度推理 SFT 数据与通用 SFT 数据的混合微调,实现了推理能力的跨任务泛化。这使得 DeepSeek R1 能够成功复现 OpenAI o1 的推理水平。

所以,我们其实应该非常重视 DeepSeek R1。它由于开源,让全球的人能够意识到深度思考的能力,这相当于让整个人工智能领域再次迎来了类似于 2023 年初 ChatGPT 的时刻,让每个人感受到大模型的能力又往前迈进了一大步。但同时,我们也需要合理地评估 DeepSeek 本身的重要意义。

如果说 2023年 初 OpenAI 发布的 ChatGPT 让全球看到了大模型非常重要的价值,那么这一次的强推理能力其实也是 OpenAI 在 2024年 9月 发布的 o1 率先实现的。而 DeepSeek R1,我们认为它在历史上更像是 2023 年 Meta 的 LLaMA。它能够通过开源复现,并且把这些事情全部公开给全球,让大家能够快速地建立起相关能力,这是我们对 DeepSeek R1 及其重要意义的一个准确认识。

当然,为什么说 DeepSeek R1 能够取得如此全球性的成功呢?我们认为这与 OpenAI 采用的一些策略有非常大的关系。OpenAI 在发布 o1 之后,首先选择不开源,其次将 o1 深度思考的过程隐藏起来,第三是 o1 本身采用了非常高的收费。这使得 o1 无法在全球范围内让尽可能多的人普惠地感受到深度思考所带来的震撼。而 DeepSeek R1 则像 2023 年初 OpenAI 的 ChatGPT 一样,让所有人真正感受到了这种震撼,这是 DeepSeek R1 出圈的非常重要的原因。

如果我们进一步将 DeepSeek 发布的 R1 和之前的 V3 结合起来考虑,那么它的意义在于:在非常有限的算力资源支持下,通过强大的算法创新,突破了算力“卡脖子”的限制,让我们看到即使在有限的算力下,也能做出具有全球意义的领先成果。

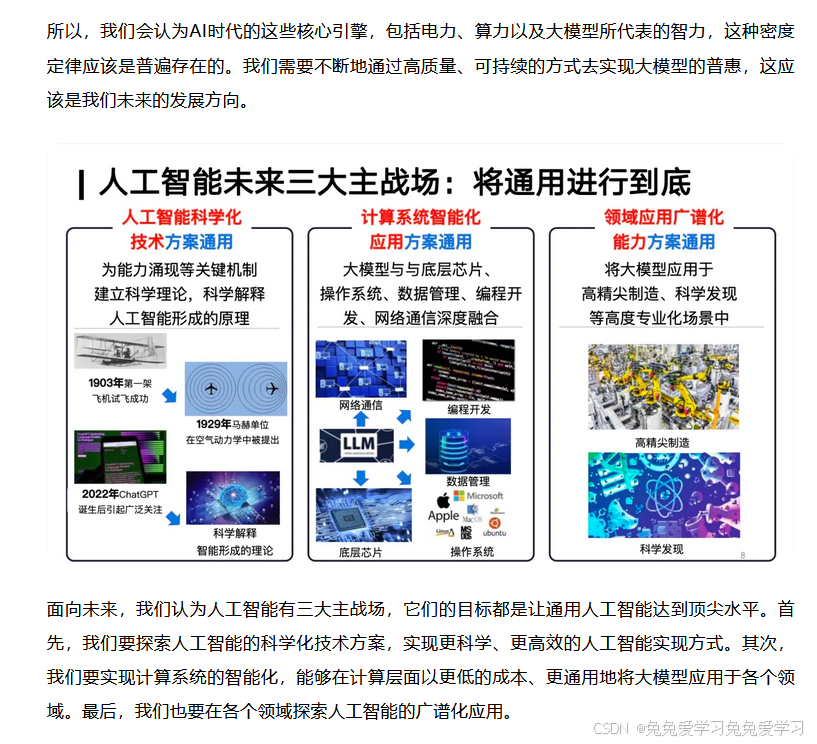

这件事对中国 AI 的发展具有非常重要的意义。当然,我们也应该看到,AI 如果想要真正赋能全人类,让每个人都能够用得上、用得起大模型和通用人工智能,那么高效性显然是一个非常重要的命题。

而在这个方面,我们其实有非常多的话题可以去讨论。除了刚才我和邱锡鹏老师提到的强化学习本身需要在未来探索更加高效的方案之外,我们还需要研究出更加高效的模型架构。例如,V3 所采用的 MoE 架构,未来应该也会有许多其他相关的高效架构方案。进一步地,戴国浩和翟季冬老师稍后也会介绍高效的算力应用等话题。

这其实也是 DeepSeek V3 和 R1 带给我们的另一个非常重要的启示。我们也会认为,整个人工智能的发展在未来追求高效性是我们内在的一个使命和需求。

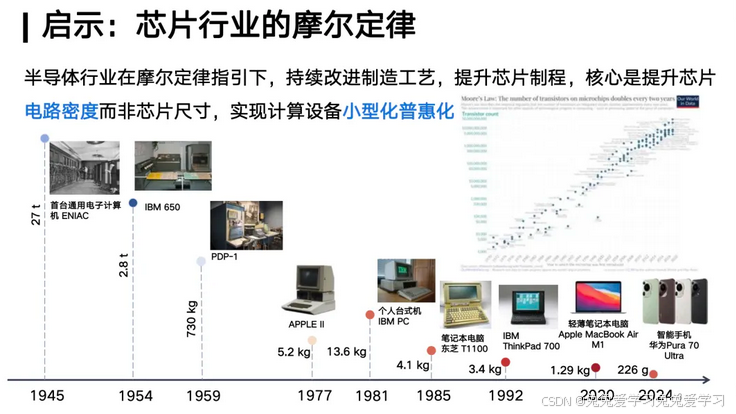

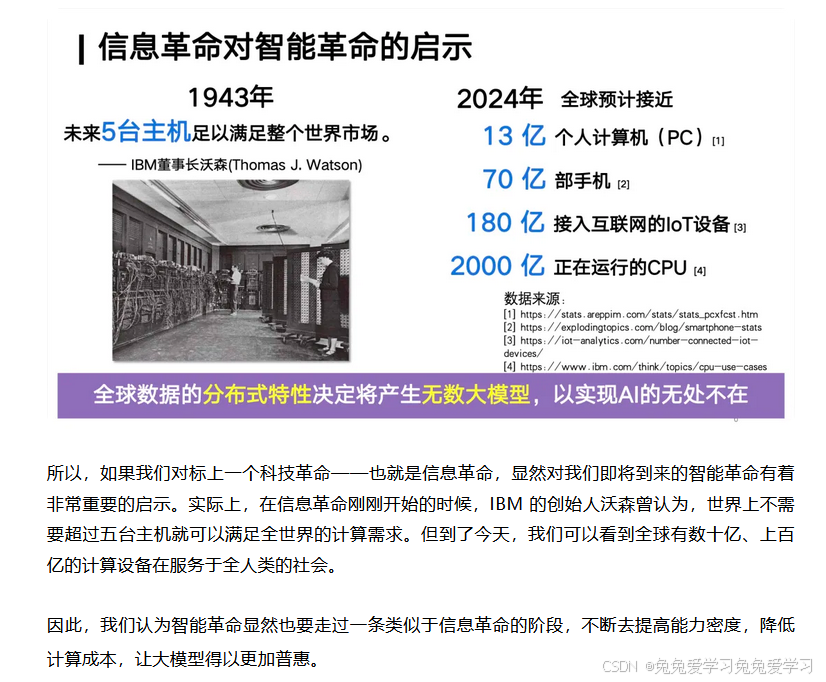

从这个方面,我想适当展开一点来介绍。我们会看到上一次所谓的科技革命,也就是信息革命,其非常重要的内核实际上是计算芯片的发展。在过去 80 年时间里,计算机从最初需要一个屋子才能装得下的规模,发展到如今每个人手边都有的手机、PC,以及各种各样的计算设备,都可以在非常小的设备上完成非常强大的计算能力。

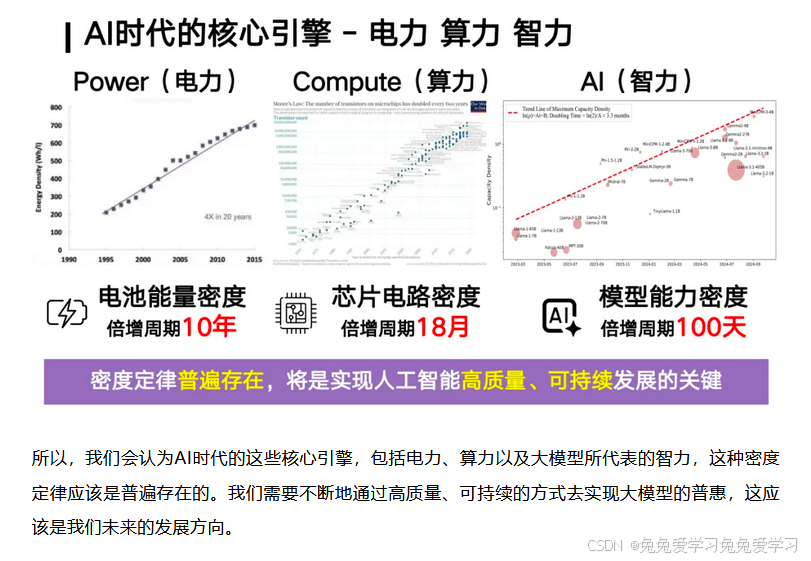

所有这一切,其实都源于芯片行业在摩尔定律的指引下,不断推进芯片制程,提升芯片电路密度,从而实现计算设备的小型化和普惠化,推动算力的普及。这显然是我们未来追求高效性的一个非常重要的内在需求。

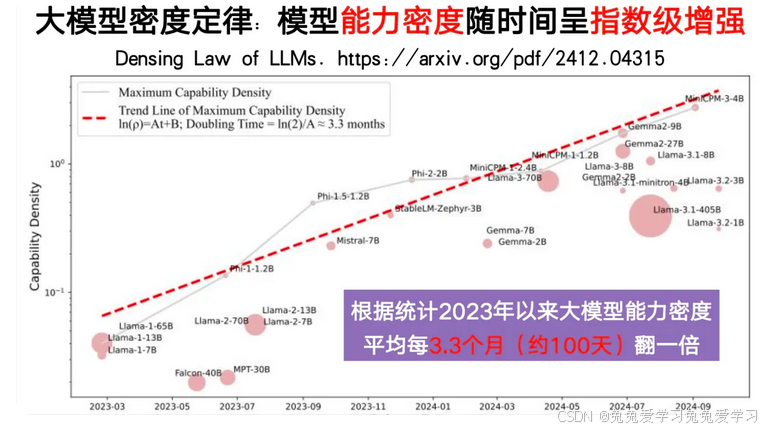

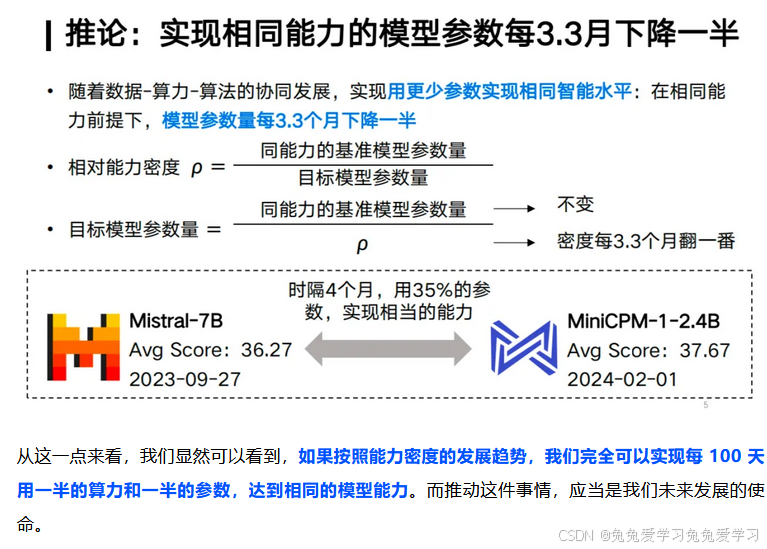

这也是为什么我们在去年特别强调要发展大模型的能力密度。实际上,过去几年我们也能看到类似摩尔定律的现象:大模型的能力密度正以时间的指数级增强。从2023 年以来,大模型的能力密度大约每 100 天翻一倍,也就是说,每过 100 天,我们只需要一半的算力和一半的参数就能实现相同的能力。

因此,我们相信,面向未来,我们应该不断追求更高的能力密度,努力以更低的成本——包括训练成本和计算成本——来实现大模型的高效发展。

Q1: DeepSeek 的成功因素里,最有亮点的一个技术是什么?

刘知远:我觉得主要有两条启示:

DeepSeek V3 给我们的重要启示在于,它展示了如何用 1/10 甚至更少的成本完成达到 GPT-4 和 GPT-4o 水平的能力。正如刚才季东老师和戴老师提到的,DeepSeek V3 在底层算力加速方面做了大量工作。但更重要的是,翟老师特别强调了 DeepSeek V3 实现了算法和底层软硬件的协同优化。这种一体化优化机制让大家看到,即使成本已经很低,但仍然可以通过优化进一步降低成本。虽然 V3 的成本仍然是几百万美元甚至几千万美元,但相比国际上公认的水平,已经低得多。这也是英伟达股价下降的一个重要原因。

DeepSeek R1 的启示在于,OpenAI犯了“傲慢之罪”——它不开源,不公开技术细节,且定价过高,导致其无法出圈。而 DeepSeek 的 R1 则开源且免费,让全球用户都能使用,并且公开了所有技术细节。这使得 DeepSeek 在历史上占据了原本应该属于 OpenAI 的位置,就像当年的 ChatGP T一样。DeepSeek 通过极致优化有限资源,成功追赶上了国际最先进的模型,我觉得干的非常漂亮,并且通过开源让全球都认识到中国团队的创新能力。

Q2:为什么 DeepSeek 的 R1 模型在这个时间点出现?之前有没有基于基础模型直接做强化学习的尝试?之前也有模型在思维链上做过类似工作,为什么 DeepSeek 的 R1 模型会如此出圈?

刘知远: 我觉得这件事情还是具有一定的必然性。大概在 2024 年的时候,很多投资人,甚至一些不从事人工智能领域的人,会来问我:中国的AI和美国的AI相比,到底是差距变大了还是变小了?我当时明确表示,我们认为中国正在非常快速地追赶,与美国最先进的技术之间的差距正在逐渐缩小。尽管我们面临一些限制,但这种追赶是显而易见的。

一个重要的现象可以验证这一点:2023 年初 ChatGPT 和后面 GPT-4 发布后,国内团队复现这两个版本的模型大概都花了一年时间。2023 年底,国内团队复现了 ChatGPT 水平的模型能力;2024 年四五月份,一线团队复现了 GPT-4 水平的能力。但随后你会发现,像 Sora、GPT-4o 这样的模型,基本上都是国内团队在大约半年内完成复现的。这意味着,像 o1 这样的模型能力,国内团队在半年左右复现是可预期的。

DeepSeek 本身非常出色,其价值不仅在于能够复现,还在于它以极低的成本做到了这一点。这是它的独到之处,也是它脱颖而出的原因。但无论如何,国内一线团队能够在半年左右复现 o1 水平的模型能力,我认为这是可以预期的。DeepSeek 能够更快、更低成本、更高效地完成这项工作,这是它的巨大贡献。从这个角度看,我认为有一定的必然性。

当然,DeepSeek 能够达到这样的出圈效果,也离不开它自身团队的长期积累,这正如刚才锡鹏老师提到的那样。

Q3: (评论区问题)刚刚知远老师 PPT 里提到的能力密度是如何定义的?它的内在原因是什么?

参考文章: Densing Law:寻找Scaling Law之后,大模型成长新曲线!

论文链接: https://arxiv.org/pdf/2412.04315v2

刘知远:这个“能力密度”的概念是我们最近半年提出的。关于如何有效地、准确地衡量能力密度,大家可以参考我们发表在 arxiv 上的论文,论文题目是《Densing law of LLMs》。

所谓的能力密度,可以理解为模型在各种评测集上展现出来的能力,除以其参数规模,或者说是激活的参数规模。我们观察过去一年半发布的代表性模型,发现其能力密度大约每 100 天增加一倍。这意味着每过 100 天,我们可以用一半的参数实现相同的能力。这一现象背后有多个因素影响:

- 数据质量:更高的数据质量取决于数据治理。高质量的数据能够提升模型的训练效果。

- 模型架构:采用更稀疏激活的模型架构,可以用更少的激活参数承载更多的能力。

- 学习方法:包括 OpenAI 在内的所有一线团队都在开展所谓的“scaling prediction”。在真正训练模型之前,我们会进行大量的风洞实验,积累各种预测数据,以确定模型需要什么样的数据配比和超参配置,从而达到最佳效果。

综合这些因素,模型可以用更少的参数承载更多的能力。我们将这一现象类比为芯片行业的摩尔定律。摩尔定律告诉我们,每 18 个月,芯片上的电路密度会增加一倍。这一过程是通过不断的技术发展实现的。

进一步结合刚才翟老师和国浩老师提到的底层算力优化,我们可以将这种优化映射到模型训练阶段,从而极大地降低成本。当然,我们并不是说 DeepSeek 的算力可以用 1/10 的成本实现与国外模型相同的能力,但这与 Densing law(能力密度定律)有一定的重叠。

Densing Law 更多地强调模型密度的不断提高,这不仅体现在训练阶段成本的降低,也体现在推理阶段。模型可以用更低的推理成本和更快的推理速度完成相同的能力。我们认为,未来AI的发展一定会沿着这条路线前进。过去几年的发展也在不断验证这一点。一个直观的体验是,像 OpenAI 这样的公司,其API模型的价格(例如 ChatGPT 水平的模型和 GPT-4水平的模型)在过去几年中快速下降。这不仅仅是因为价格战,而是因为它们可以用更少的资源实现相同的能力,从而以更低的成本提供服务。

我们认为,高效性是未来AI发展的一个重要方向,也是我们迎来智能革命的一个重要前提。

Q4: MoE 架构会是通向 AGI 道路上的最优解吗?

刘知远:我的个人感觉是,其实没有人永远是对的。

在2023年初,OpenAI 发布 ChatGPT 时,它做对了;它发布 GPT-4时,也做对了。但当它发布 o1 时,它做错了——它没有开源,定价策略也出现了失误。这反而成就了 DeepSeek。我也不认为 DeepSeek 选择了 MoE 架构,MoE 就永远是正确的。没有任何证据证明 MoE 是最优的模型架构。

从学术角度和AI未来发展的角度来看,我认为这是一个开放性的问题。未来如何实现高效性?我认为一定是模块化和稀疏激活的,但具体如何稀疏激活、如何模块化?我觉得这件事情本身应该是百花齐放的。我们应该保持开放性,鼓励学生和从业者像 DeepSeek 一样努力去探索创新。

所以,我本身不太认为 MoE 有任何绝对的壁垒,或者它一定是最优的方法。

Q5:DeepSeek 技术的爆发,对于中国大模型未来发展道路有哪些启示?

刘知远:首先,我觉得特别值得敬佩的是DeepSeek团队的技术理想主义。因为无论是看他们的访谈还是其他资料,你会发现,那些访谈其实是在 DeepSeek 大火之前很久接受的,内容非常真实,能够反映他们内在的底层逻辑。从这一点上,我们可以感受到 DeepSeek 是一个非常具有技术理想主义的团队,以实现 AGI 作为梦想来组建这个团队。我觉得这一点是非常值得敬佩的。

我觉得同时也会看到,DeepSeek 的梁文峰之前做量化投资,本身投入自己的资金来开展项目,没有资金上的困扰。那么相对应地,我觉得中国应该为这样的技术理想主义团队提供支持,哪怕他们没有足够的资金,也能让他们没有后顾之忧地去进行探索。我觉得中国已经到了这样的阶段,需要有更多像 DeepSeek 这样的团队,但又不像 DeepSeek 这样有资金。能否让他们踏踏实实地去做一些原始创新,做一些出色的工作,这是我觉得非常值得我们思考的第一点。

第二点,我觉得是他们的执行力。DeepSeek 今年这两个月一炮而红,大家会觉得很厉害,但实际上,这是经过了多年持续积累的结果。我们看到的是他们不断积累的进步,量变最终产生了质变。我可以告诉大家,几年前,幻方就拿着免费算力去吸引我们的学生,与他们建立联系。当然,也有学生毕业后加入了 DeepSeek。所以,这是他们多年努力的结果。我认为这也是技术理想主义推动下的长期主义成果。我觉得国内应该有更多的团队,能够坐得住冷板凳,更加聚焦,在一些重要问题上持续发力,做出有意义的工作。

DeepSeek 发展到今天,我认为他们所做的工作可能也是在“摸着 OpenAI 过河”,以 OpenAI 为榜样,去探索 AGI 的实现路径,并努力去做他们认为正确的事情。这个过程非常困难,尤其是随着 OpenAI 变得越来越封闭,o1 复现的难度比当年的 ChatGPT 更大。但我们会看到,只要有理想和执行力,他们就能做到。所以在我看来,国内应该有更多的团队去学习。具体的技术当然是我们应该学习的一部分,但我觉得应该避免认为因为 DeepSeek 成功了,所以他们所做的一切都是对的。我觉得不一定他们所用的所有技术都是最先进的。我觉得没有必要因为 DeepSeek 这次成功用了这样那样的技术,就认为它们全都是对的。我觉得这反而会限制我们的创新。我觉得我们应该学习的是他们的理想,学习的是他们的坚持,学习的是他们的方法论。

1154

1154

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?