人工智能咨询培训老师叶梓 转载标明出处

在临床诊断和预后中,对疾病进展的建模至关重要,但由于缺乏对个体患者的纵向医学图像监测,这一过程常常受阻。为了解决这一挑战,来自伊利诺伊大学香槟分校、德克萨斯大学奥斯汀分校、SambaNova系统公司、Objective公司、微软、弗吉尼亚大学、深圳南山人民医院和深圳儿童医院的研究人员联合提出了首个医疗视频生成(MVG)框架。该框架能够控制疾病相关的图像和视频特征,实现精确、逼真和个性化的疾病进展模拟。

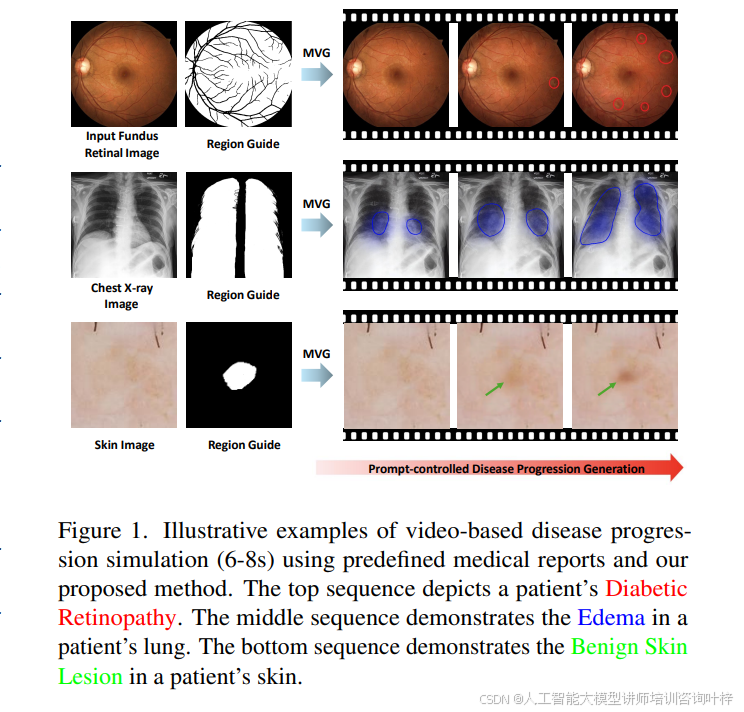

Figure1为MVG框架模拟疾病进展的示例,图1顶部的糖尿病视网膜病变序列,通过图像展示了病变从早期到后期的恶化过程,与医疗报告的文字描述相匹配,为医生提供了疾病进展的直观视觉。中间序列描绘了肺部水肿的发展,从轻微到严重,显示了疾病的变化。底部序列显示了良性皮肤病变随时间的自然演变,尽管它们通常非恶性,但外观会变化。这些连续图像组成的序列,通过MVG框架控制文本提示,精确模拟疾病进展。

想要掌握如何将大模型的力量发挥到极致吗?叶老师带您深入了解 Llama Factory —— 一款革命性的大模型微调工具(限时免费)。

1小时实战课程,您将学习到如何轻松上手并有效利用 Llama Factory 来微调您的模型,以发挥其最大潜力。

CSDN教学平台录播地址:https://edu.csdn.net/course/detail/39987

方法

在图像到视频的生成模型中,通常需要大量的文本到视频或图像到视频的数据进行训练。但是,获取大规模纵向医学影像数据非常困难,因为患者可能不会在同一家医院进行后续治疗,且医院往往缺乏疾病早期阶段的医学影像和临床报告。研究者提出的新的方法,通过给定输入医学图像和临床报告,利用医生的临床经验预测疾病的进展状态,并生成一系列展示疾病进展的视频剪辑。

MVG框架包含两个主要部分:渐进性疾病图像编辑(PIE)和转换生成过程。PIE是一个长序列医学图像编辑框架,允许基于临床报告的提示进行精确调整以模拟疾病发展,同时保持真实感。转换生成用于连接不同的叙事时刻,通过PIE生成的帧级序列,提供每对相邻帧并使用转换提示和疾病区域掩码来控制风格和内容,创建展示医学视频序列中过渡或进展的中间帧。

PIE的输入是一个离散的医学图像,描绘了疾病的任何开始或中间阶段,以及由医生推断并由GPT-4重新描述的相应终端阶段临床报告。这个过程生成的输出是展示疾病进展的一系列图像。

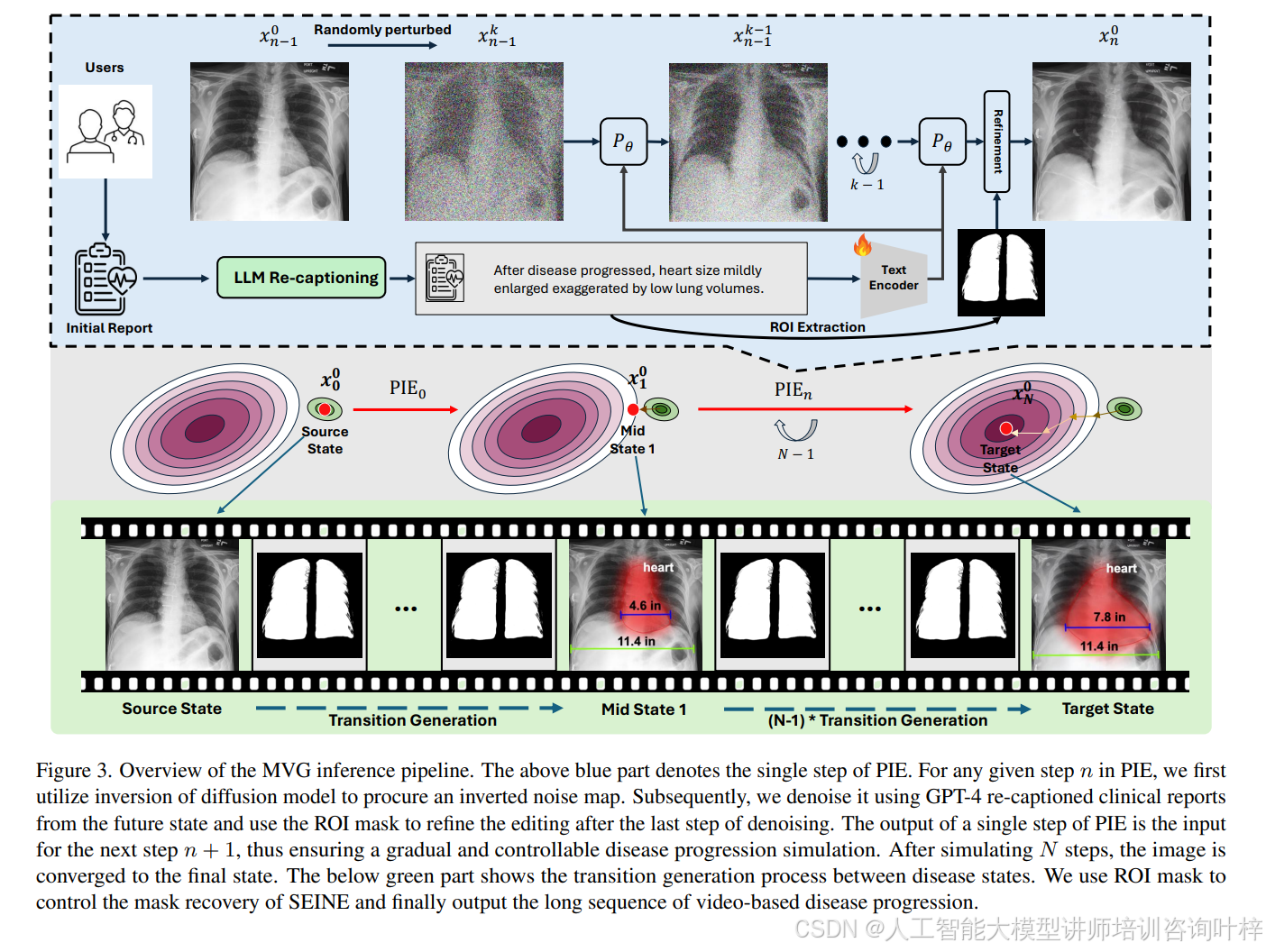

Figure3 展示了MVG推理流程的概览。在PIE的任何给定步骤中,首先利用扩散模型的反转来获取反转的噪声图,然后使用GPT-4重新描述的临床报告对噪声进行去噪,并在去噪的最后步骤后使用ROI掩码来细化编辑。PIE的单步输出是下一步的输入,确保了渐进和可控的疾病进展模拟。在模拟N步后,图像会收敛到最终状态。

场景转换生成的概念最初由SEINE提出,它是一个短到长视频扩散模型。在MVG中,我们使用MROI来控制SEINE连接由PIE生成的每一步之间的疾病进展,xˆn′ = Concat(x0n−1, ϵ, ..., ϵ | {z } 随机噪声, x0n) (9) xˆn = x0n−1 + x0n/2· (1 − MROI) + g( ˆx_n′) · MROI (10),其中xˆn是一个视频剪辑,其第一帧和最后一帧分别是PIE进展阶段n的输入x0n−1和输出x0n。在x0n−1和x0n之间,所有帧都是带有随机噪声的掩码。通过预测和建模噪声,转换生成过程g(·)旨在扩展真实、视觉连贯的过渡帧,这些帧将可见帧与未掩码的帧无缝集成。

实验

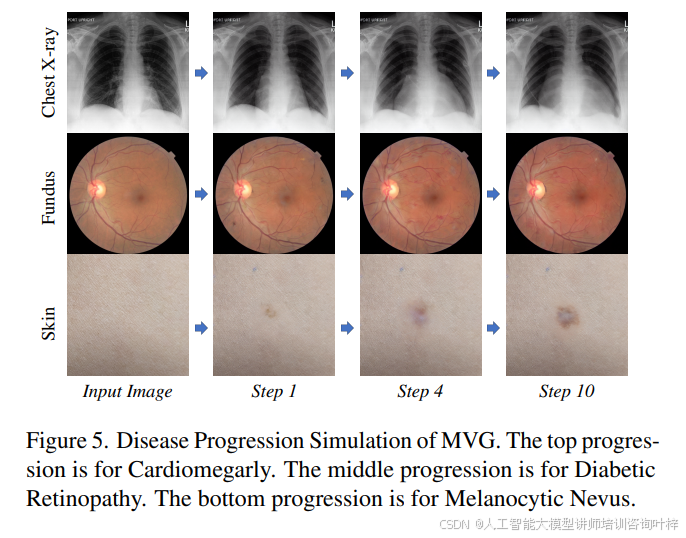

在进行各种疾病进展任务的实验中,MVG展现了其模拟受不同医学条件影响的疾病变化轨迹的能力。实验结果表明,MVG能够在逐步编辑疾病表现的同时,保留原始医学影像报告中不相关的视觉特征。Figure 5 展示了MVG在三种不同类型的医学影像中的疾病进展模拟示例。这些结果不仅证明了MVG的有效性,还显示了其在保留患者身份特征方面的潜力。

实验中,PIE和基线方法使用了公开可用的Stable Diffusion检查点(CompVis/stable-diffusion-v1-4),并在每个目标数据集的训练集上进行了微调。对于用户研究,采用了Stable Diffusion 3中型作为模型权重,并在三个医学领域进行了微调。转换生成模型的权重来自SEINE。所有实验都在4个NVIDIA H100 GPU上进行。

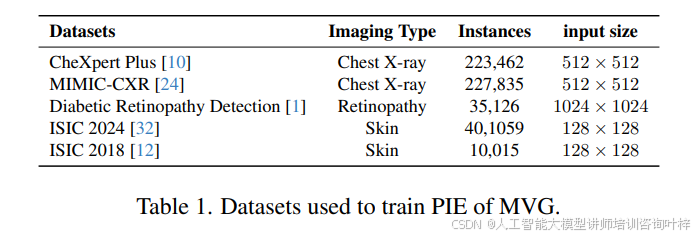

评估预训练的领域特定稳定扩散模型在三种不同类型的疾病数据集上的表现:CheXpert Plus和MIMIC-CXR用于胸部X光分类和报告生成,ISIC 2024和ISIC 2018用于皮肤癌预测,以及Kaggle糖尿病视网膜病变检测挑战。这些数据集都具有大规模数据,适合测试MVG的鲁棒性和多功能性。表1 列出了用于训练PIE的MVG数据集。

评估生成的疾病进展图像的两个关键方面是:与预期疾病特征的对齐和患者身份的保留。为此,采用了两个主要指标:CLIP-I分数和分类置信度分数。CLIP-I分数代表生成的医学图像序列与初始真实医学图像之间的平均成对余弦相似度。高CLIP-I分数表示患者身份一致性强,但也意味着编辑序列与原始输入之间的变化最小。因此,理想的疾病进展序列应在编辑程度与身份保留之间取得平衡。

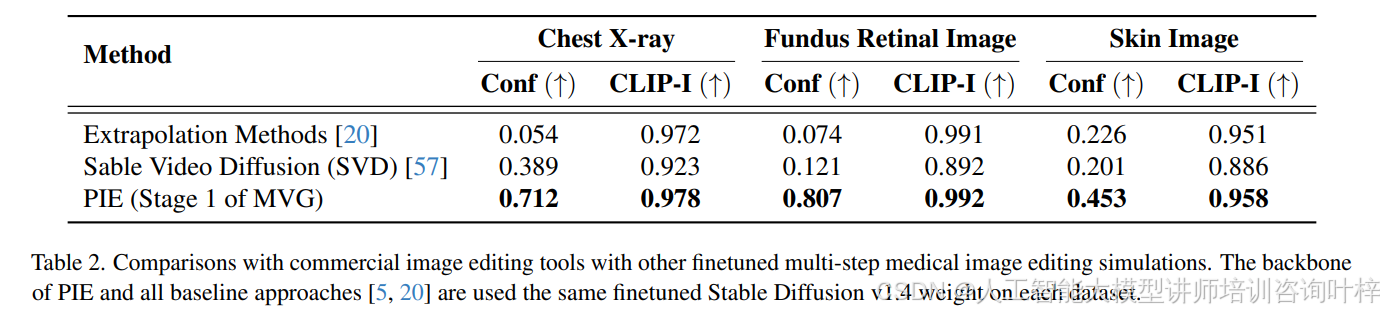

在与商业图像编辑工具和其他微调的多步医学图像编辑模拟的比较中,MVG在疾病置信度分数上一致超越了SVD和外推法,同时保持了高的CLIP-I分数。例如,在CheXpert数据集上,MVG的最终置信度分数为0.712,是5个类别的平均分数。对于糖尿病视网膜病变和ISIC 2018数据集,由于这些数据集高度不平衡,MVG与SVD和外推法进行了比较,结果显示MVG能够产生更真实和忠实的渐进式编辑。

为了展示MVG在疾病进展模拟中的优越性能,研究者在前述的三个数据集上进行了实验。对于这些数据集中的每种疾病,研究者使用了50个健康样本作为模拟起点,并运行了MVG、SVD和外推法,每个方法使用5个随机种子。结果显示,MVG在疾病置信度分数上一致超越了SVD和外推法,同时保持了高的CLIP-I分数。Table2 显示MVG在疾病置信度分数方面一致性地超越了SVD和Extrapolation,同时保持了高的CLIP-I分数。

Table3 显示了MVG和三个图像到视频生成基线的比较结果。与PixVerse、CogVideoX和Pika相比,我们的方法在临床医生偏好方面表现出显著更高的偏好,分别在胸部X光、糖尿病视网膜病变和良性皮肤病变疾病进展模拟中达到了79%、70%和66%的平均胜率。相比之下,对于其他视频生成方法的A/B测试,临床医生通常无法区分它们,两种方法的胜率平均约为50%,表明没有明显的偏好。临床医生偏好研究的结果表明,MVG能够生成与临床背景一致的高保真度疾病进展序列。

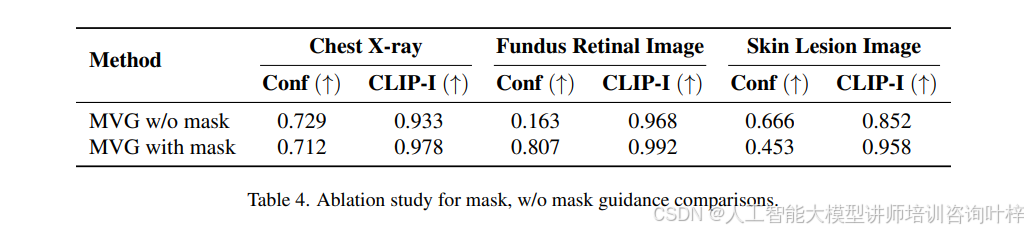

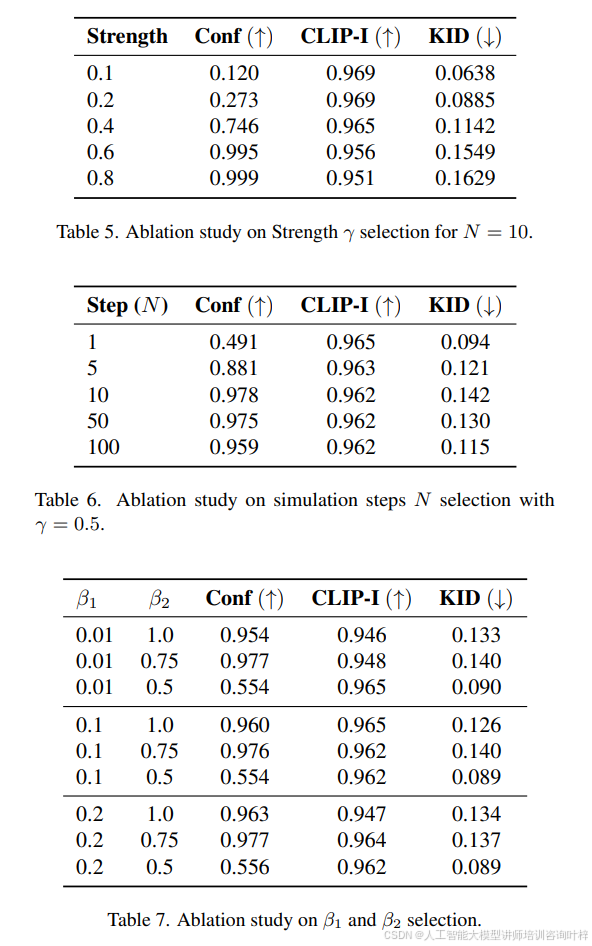

在MVG模拟中,区域引导掩码作为先前信息发挥了重要作用。与其它随机修复任务不同,医学影像的ROI掩码可以从临床报告中提取,使用特定领域的Segment Anything模型。这有助于在使用MVG或基线模型进行逐步变化时保持不相关区域的一致性。为了生成顺序疾病影像数据,MVG使用噪声强度γ来控制患者临床报告和预期治疗方案的影响。N用于控制疾病发生或治疗方案的持续时间。MVG允许用户对迭代过程进行此类控制,并且多次运行PIE可以提高疾病成像跟踪的准确性,减少遗漏或误解变化的可能性。通过Table 4、Table 5、Table 6和Table 7中的消融研究,确定了最佳的超参数(N = 10, γ = 0.6, β1 = 0.01, β2 = 0.75)。

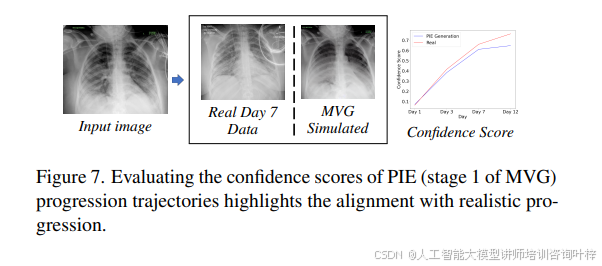

由于COVID的传播,部分最新发布的数据集包含有限的纵向数据。为了验证MVG能否匹配真实疾病轨迹的疾病序列建模,研究者在BrixIA COVID-19数据集中对显示水肿的10名患者的水肿疾病进展进行了消融研究。输入图像是第1天的图像,使用MVG根据真实的临床报告生成未来的疾病进展。实验结果显示,在MVG的疾病状态序列模拟之后,MVG的模拟图像与同一患者的真正疾病进展图像之间的平均绝对误差大约为0.0658。Figure 7 显示了一个比较示例。

为了进一步评估生成的疾病状态序列的质量,研究者进行了另一项全面的用户研究,邀请了平均拥有14.4年经验的35名医生和放射科医生回答有关胸部X光的问卷。问卷包括对生成的和真实的X光图像的疾病分类以及对生成的心脏肥大、水肿和胸膜积液疾病进展视频的现实性评估。

参与的医生以76.2%的信心同意MVG模拟的疾病状态进展符合他们的预期。一个可能的解释是,由于MVG的性质,渐进式图像编辑的结果使病理特征更加明显。用户研究的综合结果证明了MVG框架模拟疾病进展以满足现实世界标准的能力。

2241

2241

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?