来自openmmlab的讲座视频

大模型部署背景

- 部署:指的是将开发完毕的软件投入使用的过程

- 人工智能模型部署:是将训练好的深度学习模型在特定环境中运行的过程

- 大模型部署面临的挑战

- LLM参数量巨大,前向推理inference需要大量计算

- GPT3有175B,20B的算小模型了

- 内存开销巨大

- FP16,20B模型加载参数需要显存40G+,175B模型需要350G+

- 20B模型kv缓存需要显存10G,合计需要50G显存

- RTX 4060X消费级独显,显存8G

- 访存瓶颈。数据交换速度不够,显存带宽比起访存量偏小,无法发挥GPU的计算能力。

- 动态请求。请求量不确定,GPU计算能力发挥不足。

- LLM参数量巨大,前向推理inference需要大量计算

大模型部署方法

- 三种:模型剪枝

- 模型剪枝 pruning

- 减少模型中的冗余参数

- 知识蒸馏

- 用大模型作为teacher,用teacher去训练一个student的小模型

- 早期用于计算机视觉任务

- 量化 Quantization

- 把浮点数转换为整数或其他离散形式,减轻存储和计算负担

- 可以提升计算速度。因为可以降低访存量,显著降低数据传输时间,提升计算效率。

LMDeploy简介

- 是涵盖LLM任务的全套轻量化、部署和服务的解决方案

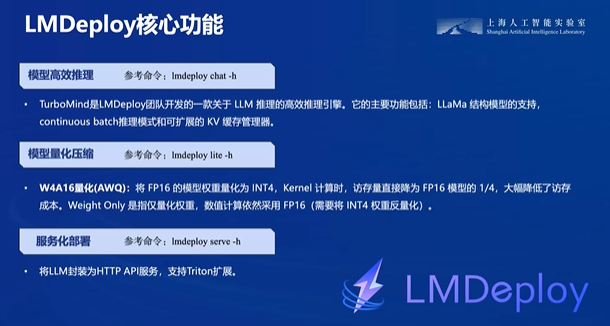

- 三大核心功能

- 模型高效推理。

- 模型量化压缩

- 服务化部署

- 性能表现优异,有突出优势

- 支持语言模型,也支持多模态大模型,视觉任务,可以使用pipeline便捷运行

动手实践环节

- 安装、部署、量化

- 参考文档说明

- 一共6个章节

- 注意点

- cuda12.2环境

- terminal操作

- internstudio内安装比较方便

本文探讨了大模型部署中面临的挑战,如大模型参数量导致的内存问题,以及解决策略如模型剪枝、知识蒸馏和量化。LMDeploy提供了一套完整的轻量化部署方案,强调模型高效推理和多模态支持。实践部分介绍了如何在cuda12.2环境下安装和部署LMDeploy。

本文探讨了大模型部署中面临的挑战,如大模型参数量导致的内存问题,以及解决策略如模型剪枝、知识蒸馏和量化。LMDeploy提供了一套完整的轻量化部署方案,强调模型高效推理和多模态支持。实践部分介绍了如何在cuda12.2环境下安装和部署LMDeploy。

1791

1791

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?