损失函数概览

- 均方误差

- 自定义

- 交叉熵

均方误差和交叉熵适用范围区别

- 均方误差衡量数值距离:回归问题

- 交叉熵衡量数据表达信息的差异程度:分类问题

Python中快速实现计算激活函数处理数据后的数据交叉熵

例:

import tensorflow as tf

loss_ce1 = tf.losses.categorical_crossentropy([1, 0], [0.6, 0.4])

loss_ce2 = tf.losses.categorical_crossentropy([1, 0], [0.8, 0.2])

print("loss_ce1:", loss_ce1)

print("loss_ce2:", loss_ce2)

# 交叉熵损失函数

正则化参数(加在损失函数中)

- 欠拟合:过于平滑,没法准确描述当前数据规律性 措施:减少正则化参数

- 过拟合:过度描述当前数据的变化规律,难以描述未来数据,做出较为准确的预测,增加正则化参数

正则化参数如下图:

优化器(用于计算更新的下降梯度)

常用优化器:

-

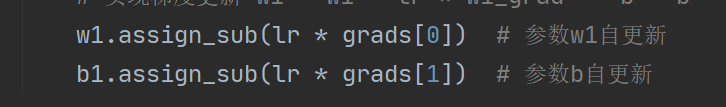

sgf(直接梯度下降)

-

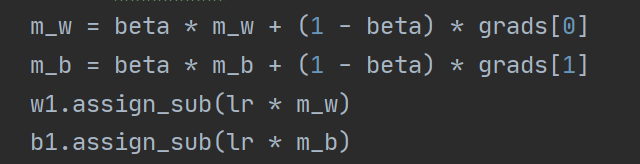

sgdm(引入一阶动量m)

-

adagrad (引入二阶动量v)

-

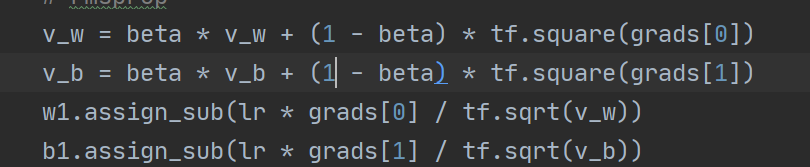

rmsprop(引入二阶动量v,公式和adagrad不同)

-

adam(引入一阶动量m,和二阶动量v,公式和rmsprop相似)

415

415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?