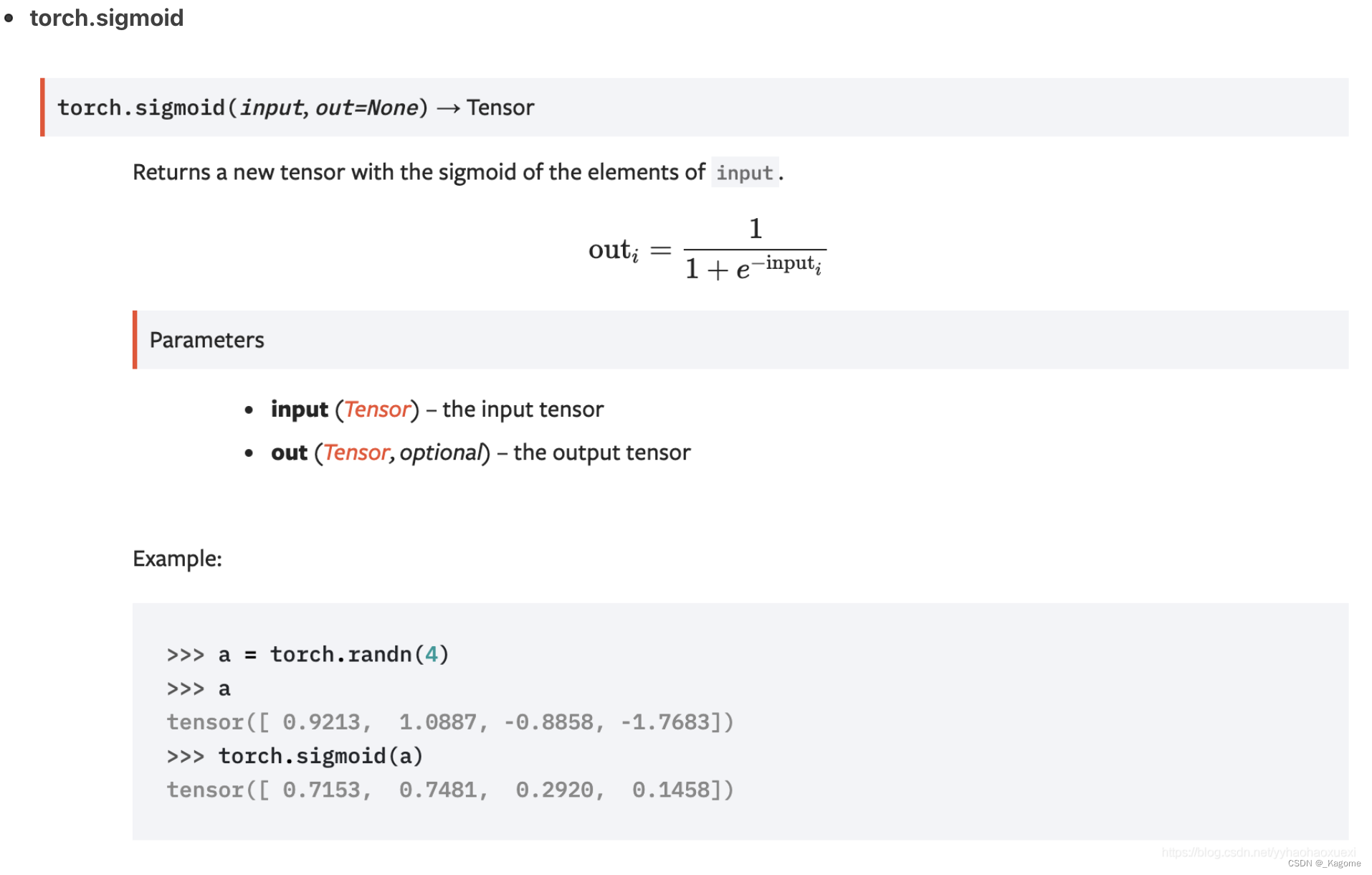

torch.sigmoid( )

这是一个方法,拥有Parameters以及Returns。

参考官网的解释,就可以从输出很明显的看到输出就是属于概率[0,1]之间了

所以sigmoid函数就是将输出值映射到[0,1]

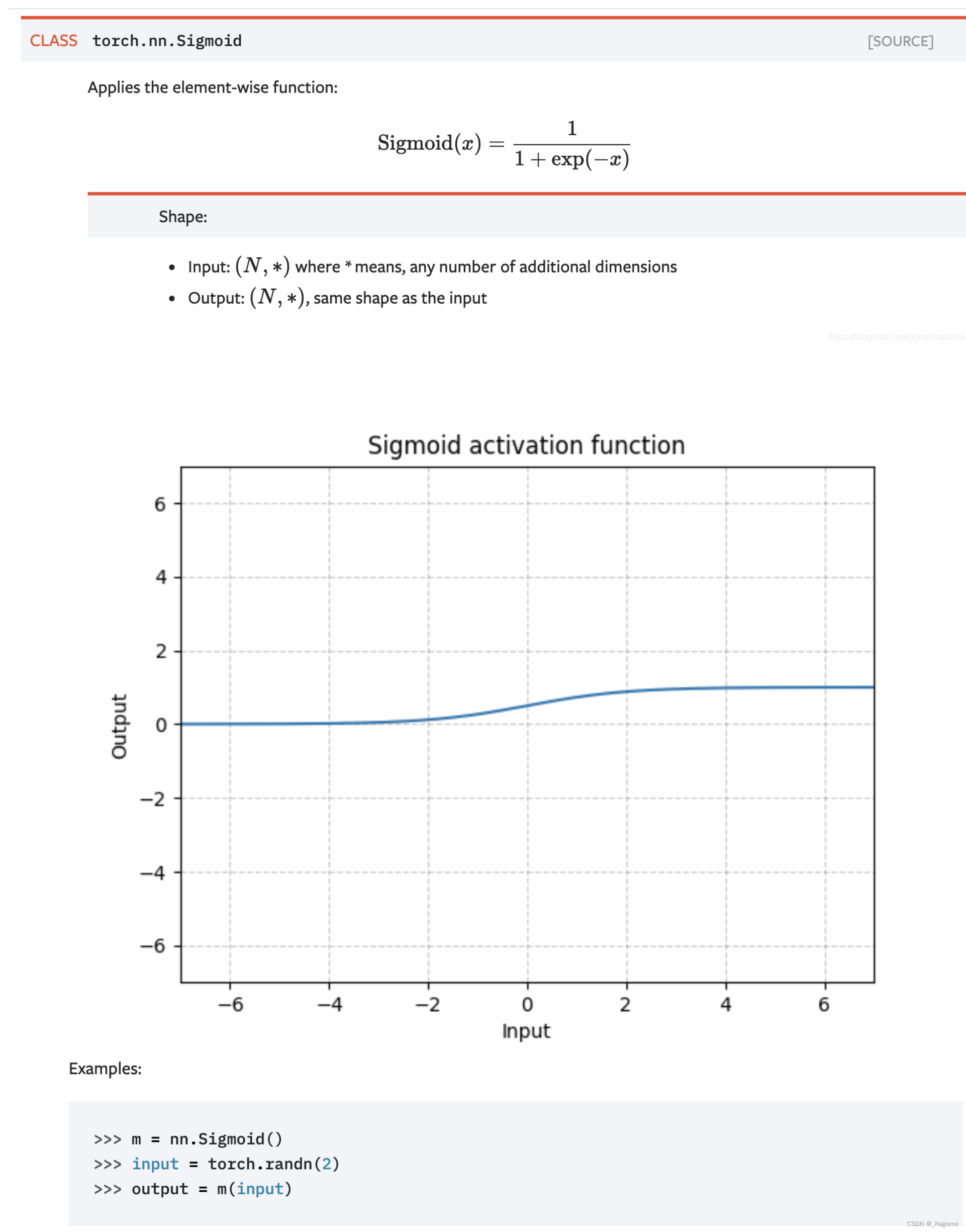

torch.nn.sigmoid( )

有一个很明显的class,所以这说明了

torch.nn.Sigmoid在我们的神经网络中使用时,我们应该将其看作是网络的一层,而不是简单的函数使用。会构建计算图。

torch.nn.funtional.sigmoid( )

事实上,torch.nn.functional从这个包名就能看出来,这个包里的都是函数。同样的,按照官网的文档的内容,我们也可以判断出torch.nn.funtional.sigmoid是一个方法,可以直接在我们的神经网络的forward中使用,并不需要在init的时候初始化。也就是说torch.nn.functional.sigmoid和torch.sigmoid没有什么区别,同理,本文对于其他的激活函数一样适用。

总结

具体情况具体分析,一般使用torch.sigmoid( )。

2531

2531

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?