好久没看论文了,感觉好生疏

关于这篇文章的大致脉络,这篇文章已经介绍过了。我主要谈谈我对其中图的特征矩阵初始化的理解

文章认为,现在的GNN都不能很好的保持图结构,主要原因就是初始化维度(initial dimensionality reduction bases)完全是基于特征而来,而不包括任何图结构的特征。

为了解决这个问题,使用一个合适的子空间来保存图结构信息,受到谱聚类(spectral clustering)采用拉普拉斯矩阵的顶最小特征向量进行节点聚类,网络嵌入采用邻接矩阵的多项式函数的顶最大特征向量进行无监督节点表示学习的启发,本文的想法是扩展初始维度,将图结构的特征空间和gnn结合起来。具体地说,将图结构的特征空间与GNNs结合起来,将GNNs视为一种降维,并扩展初始降维基。在不需要增加深度的情况下,由于初始基同时包含节点特征和图结构,因此EigenGNN在在节点分类、链接预测方面具有更大的灵活性。

首先是一点图论的知识:

即,

对于GCN: X0 = X ; Xi+1 =f ( Xi ,A ) , A为邻接矩阵

对于HGNN: X0 = X ; Xi+1 =f ( Xi ,G ) , G为由关联矩阵H生成的正定矩阵

对于Eigen-GNN:原 X0 = X ; 现扩展 X0 = [ X ,f (Q) ]

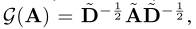

其中Q(N*d)是对应于图结构的指定矩阵G(A)的最大绝对特征值的前d个特征向量,其中G(A)

所以应用到我所使用的超图,可以理解为Q是我超图中G生成的特征值矩阵取前d个向量

258

258

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?