准备工作:

1、需要安装配置好hive,如果不会安装可以跳转到Linux下编写脚本自动安装hive

2、需要安装配置好spark,如果不会安装可以跳转到Spark安装与配置(单机版)

3、需要安装配置好Hadoop,如果不会安装可以跳转到Linux安装配置Hadoop2.6

操作步骤:

1、将hive的conf目录下的hive-site.xml拷贝到spark的conf目录下(也可以建立软连接)cp /opt/soft/hive110/conf/hive-site.xml /opt/soft/spark245/conf/

2、将hive的lib目录下的mysql jar包拷贝到 spark的jars目录下cp /opt/soft/hive110/lib/mysql-connector-java-5.1.25.jar /opt/soft/spark245/jars/

3、启动hive元数据服务hive --service metastore

4、启动hive 直接使用命令hive 进入

5、启动spark spark-shell

6、在hive窗口创建一张表create table test(id int,name string);

然后插入一条数据 insert into test values(1,"zs");

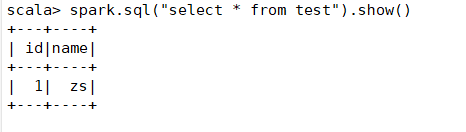

7、在spark-shell窗口输入命令 spark.sql("select * from test").show()

至此,spark和hive整合完成~

605

605

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?