添加NAMAttention注意力机制

1. NAMAttention注意力机制论文

论文题目:NAM: Normalization-based Attention Module

论文链接:NAM: Normalization-based Attention Module

2. NAMAttention注意力机制原理

3. NAMAttention注意力机制的配置

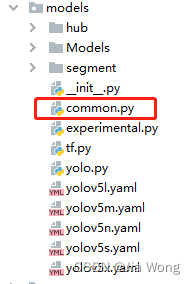

3.1common.py配置

./models/common.py文件增加以下模块

在最后添加如下代码块:

class Channel_Att(nn.Module)

订阅专栏 解锁全文

订阅专栏 解锁全文

754

754

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?