coze这次更新涵盖不少内容,包括对话流,工作流,连带大模型,全都有重大变化。还有刚发布的视觉模型也用上了,下面我们就一起来说说。

对话流

先来看看这个对话流到底是什么?顾名思义就是用来对话的工作流,整体功能和之前的工作流差不多,最大区别就是多了一个对话历史的参数。

首先,在创建资源那里多了一个新的选择:对话流

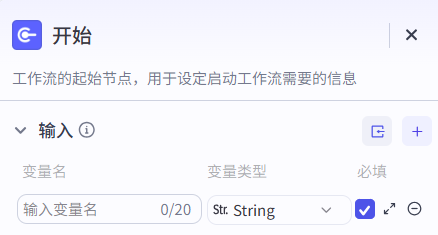

创建对话流以后会发现,在开始节点那里引入了一个 CONVERSATION NAME 作为输入参数。

这是用来记录历史对话消息的参数。也就是说你可以传入对话记录,并基于历史对话消息来处理本次的用户输入。

这个CONVERSATION_NAME是置灰的,只能用默认值。输入方式是通过关联某个智能体,来获取这个智能体的历史会话消息。

因此在试运行对话流的时候,会强制你选择关联一个智能体,因为要用这个智能体的历史会话记录:

大模型变强了

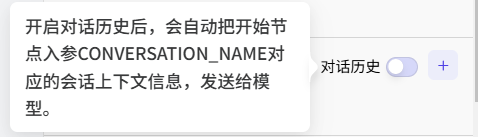

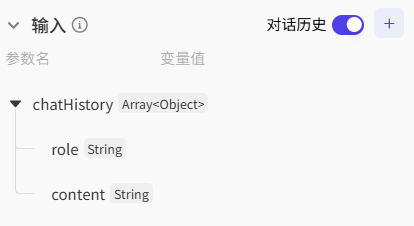

随着会话参数的引入,大模型节点也有了变化,加入了对话历史选项,这个是跟着对话流的CONVERSATION_NAME 的

开启对话历史后,会自动把开始节点的入参CONVERSATION NAME 对应的会话上下文信息,发送给模型。这样大模型就可以根据之前的会话消息进行回复。

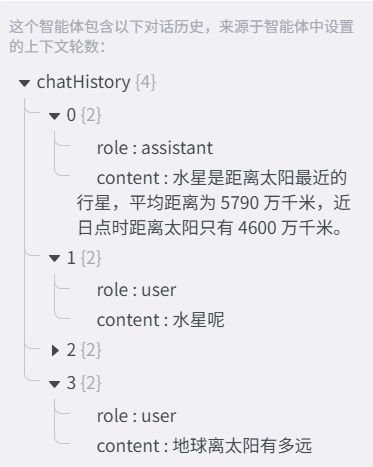

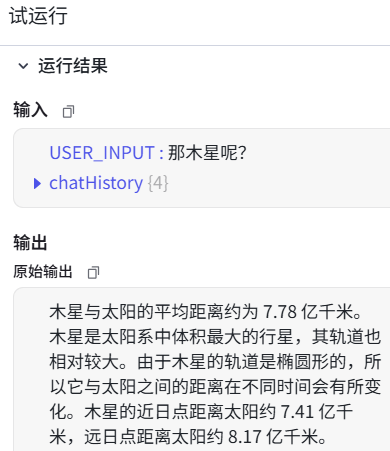

举个例子,我选择的关联智能体里已经有如下历史对话消息,是关于询问行星距离太阳距离的问题

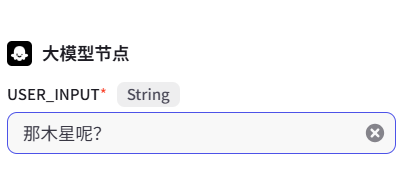

那我就可以直接问大模型:那木星呢?大模型会根据上下文信息,正确理解并做出回答

注意:要使用对话流的历史会话的功能,那就必须打开大模型的对话历史开关,否则即使开始节点有CONVERSATION NAME这个参数也没用

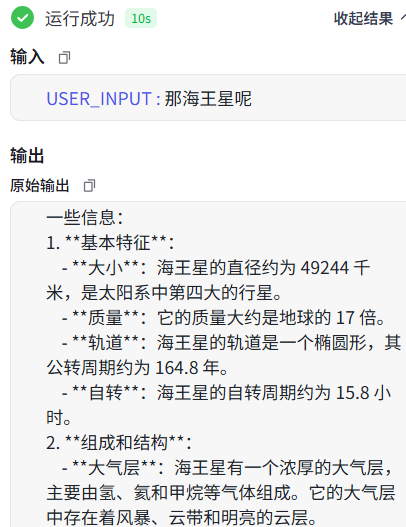

如果我关掉大模型的对话历史开关以后,再询问海王星,它就只给我回答关于海王星的基本数据了,而不是距离。

关于对话流的对话历史功能大概就是这样。

这次大模型节点的另外一个变化就是,大模型支持自带技能了。节点里多了一个技能配置,可以在这里给大模型添加各种技能

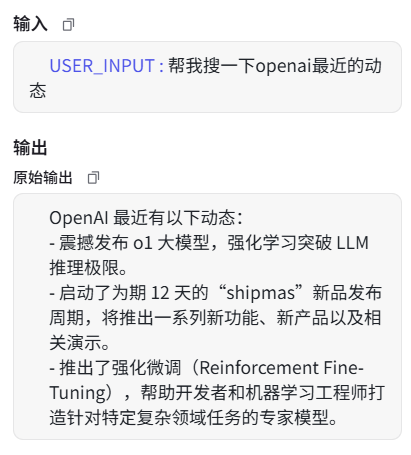

例如,我给大模型添加了搜索插件,这样它就可以联网搜索内容了,比如我可以让它帮我搜openai的动态,这个以前在大模型节点是做不到的。

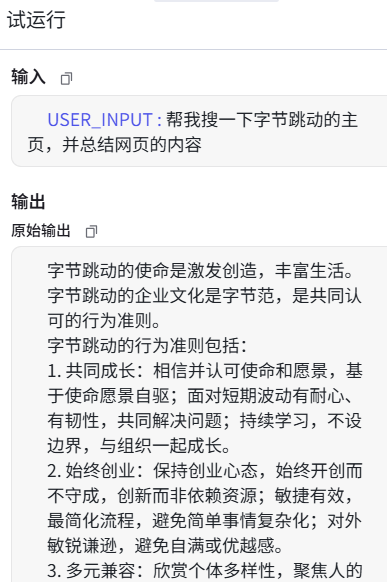

再升级一下,我给大模型同时加了搜索和链接读取的技能,那么我就可以让他来做网页内容总结了,很好的帮我总结了字节跳动主页的内容

这里要注意,如果添加了技能这大模型一定要选择Function Call类型的,否则会报错,因为插件相当于要调用外部函数

新的工作流

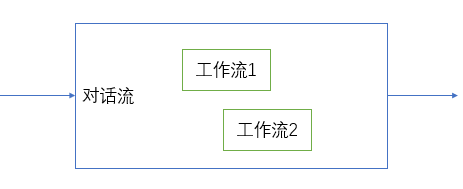

有别于对话流,现在的新工作流则“退化”了,区别也是在开始节点,没有了用户输入参数USER_INPUT了,也就是说它不直接处理用户输入的内容了,如下

那这种工作流有什么用呢?程哥觉得,它适合那种独立的处理逻辑,嵌入在一个大的对话流里,不需要直接获取用户输入的场景

最强视觉理解模型

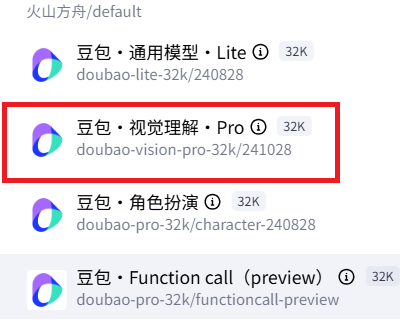

字节还正式发布了他们的最强视觉大模型豆包视觉理解Pro,图片理解能力非常强悍,根据实际测评结果,能把4o摁在地上摩擦,有兴趣可以看卡兹克的这篇文章:

这个模型在扣子平台上已经同步支持了,大模型的选项里直接可以选“豆包 视觉理解 Pro”,图片理解直接起飞🛫

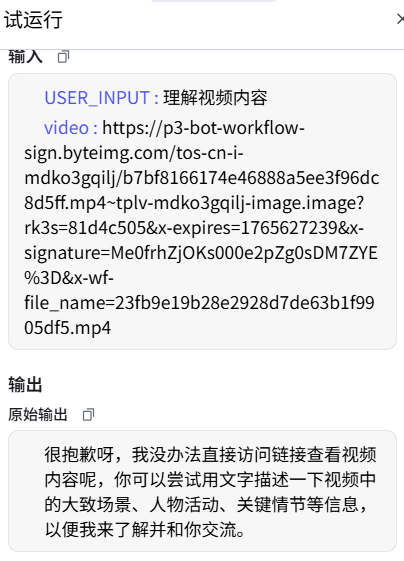

不过比较可惜的是,我试了下目前好像还不支持视频理解:

进击的扣子

扣子这段时间更新频频,先是更新了网页界面,后又统一了工作流和图像流,再后来又推出扣子应用,现在又新增对话流和视觉大模型。

更新功能是好事,比如视觉模型,大模型技能配置,所以coze一直领跑国内智能体平台,必须给coze点赞!

但是有些更新直接影响到基础框架的使用,比如我们社群里现在还有人会问图像流去哪了这样的问题。说明基础框架的变动影响较大,需要一些时间去适应和普及,因此这类变更我个人认为要尽量减少。

大家对coze更新的看法如何?欢迎评论区留言,咱们一起去给字节提提意见去

更多精彩内容推荐:

-> AI智能体学习&实战

-> 私域AI机器人

-> 自媒体AIP打造

-> AI应用

7343

7343

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?