发布在ICLR2023,是一篇小论文

可以先看看他的review,

Meta Review

- 清晰:文章清晰:很好地介绍了问题,并详细解释了方法。文献讨论在评论不同的先前作品时可能会稍微尖锐一些,但考虑到论文空间,这是可以接受的。

- 正确性:论文似乎是正确的,实验也相当广泛地支持了这些观点;对参数组合的进一步讨论和分析是有益的。

- 可重复性:论文包含足够的细节来重现类似的实验设置,但在目前的状态下,精确的复制是不可能的。手稿中没有提到code

总结:本文对不同的图卷积网络进行了分析,分析了三种不同参数对图卷积网络的影响。论文内容清晰,研究问题有趣,但进一步研究不同的参数调优可以改善外卖信息。

不给更高的推荐理由:

缺少论文的明确的最终信息,审稿人担心实际的技术贡献。在更明确的范围内对参数进行进一步的实验可能有助于提高论文的收获。

审稿人对研究问题、清晰度和部分实验表示赞赏,而进一步的分析将有助于形成最终的论文信息。

对作者的评论和反馈:

对这篇论文的总体感觉是积极的,但技术贡献仍然不完全清楚。我建议用审稿人的评论来补充分析。特别是进一步分析参数的作用和它们的值将是一个有趣的消融。这篇论文以一个相当普遍的信息结束:“一个稳定和可适应的体系结构可以在假设每个组件都被仔细考虑的情况下获得”;如果能说些具体的话,那就更有趣了。论文强调的主要发展方向是什么?未来的工作应该研究什么?

我也建议在之前的文献和方法上多做一些阐述,对不同的作品提供更详细的评论,并强调他们的局限性,这是本工作旨在解决的。.

Official Review

Review 1

本文提出了一种自适应深度卷积网络(ADGCN)架构,以缓解图卷积网络(GCNs)随着层数增加而导致的性能下降。ADGCNs可以自适应调整不同的图结构数据。在一些实际数据集上进行了实验。

优势:

消除模型退化和模型过度平滑之间的等价性的想法是有趣的和有前途的。(我也计划从这里入手)

缺点:

•虽然论文中提供了许多实验结果,但实验结果需要更加清晰,以突出效果。

建议修改:

•本文的动机和研究问题是强烈而重要的。我主要担心的是技术贡献可能不是很大。

•可以对本文提出的框架进行对比实验,并添加手动参数修改后的结构效果。

Review 2

贡献总结:本文试图解决随着层数增加而导致GCNs性能下降的问题。该方法引入三个自适应参数来实现深度GCN结构。

(优势):

- 这篇论文写得很好,很容易理解。

- 实验结果证明了该方法的可行性。

(缺点):

- 总的来说,这项工作简单地结合了GCNII和DGCN。作者应该对以前的方法的缺点提供更多的见解。

- 这三个自适应参数不是正交的,作者应该更多地解释它们之间的关系。哪一个解决了过度平滑的问题?哪一个解决了梯度消失的问题?

建议修改:

对每个自适应参数进行消融实验,分析其各自的影响。

笔记正文

摘要:

图卷积网络( Graph Convolutional Networks,GCNs )是处理图结构数据的基本架构。如何加深卷积神经网络( Convolutional Neural Networks,CNN )和Transformer等GCN以提高其性能一直是一个挑战。随着层数的增加,GCNs的性能下降,这通常归因于过度平滑,但一直存在争议。在本文中,我们消除了模型退化与过度平滑或梯度消失之间的等价性,并提出了一种系统的解决方案,即自适应深度GCN ( ADGCN )架构,这使得模型具有解决所有问题的潜力。我们将可学习的参数定位在最佳位置,以实现对各种类型的图结构数据的自适应调整。我们在真实世界的数据集上进行实验来验证

1 介绍

研究表明,更深层的结构可以增加深度神经网络在许多领域的表达能力,然而,模型退化是指堆叠许多GCN层后泛化性能的下降。许多研究探讨了其产生的原因(阐述明白)。我们发现,多样化的原因取决于不同的关注点。一些研究主要集中在由多个图卷积操作引起的过度平滑,另一些研究集中在梯度消失,还有一些研究基于Lipschitz约束扩展了视角来考虑泛化差距,以确定能够增强模型性能的关键因素。

我们认为,模型退化是一个复杂的问题,它不是由单一问题引起的,而是由多种因素共存引起的。以往研究之间结论的差异可以归因于不同设置所揭示的关键因素的变化。例如,一些研究集中在10层以下的模型,它表现出正常的梯度和较低的复杂度但却存在着过度平滑问题,随着层数的增加,梯度消失的问题变得更加明显,潜在地掩盖了其他问题。我们提出了一个系统的解决方案,即自适应深度GCN ( Adaptive Deep GCN,ADGCN )架构,这使得该模型具有解决所有问题的潜力。通过神经网络中端到端的学习,有利于一致地管理各个组件之间的相互作用。我们将可学习的参数放置在合适的位置,使模型有空间对不同的图结构数据进行自适应调整。其效果可与精确手动修改参数的架构相媲美。

那这里应该要说明应对不同深度存在不同问题如何解决

ADGCN架构由3个组件组成,分别调节模型的信息传播,控制模型复杂度,并引入注意力机制作为跨层选择性聚合信息的控制开关。通过实验,我们对"系统化"方法的必要性有了更深刻的认识。例如,在只考虑降低模型复杂度(也就是说,对于当前数据集,模型中的参数数量过多)的情况下,与基本GCN模型相比,在泛化能力和训练效果上都有所改善。然而,降解仍然持续存在。

2 自适应深度GNN

当GCNs结合残差连接或其他技术的性能仍降低( Li et al . , 2019)时,显然仅保证训练精度(大致等于1)是不够的。此外,随着层数的增加,GCN变体GCNII ( Chen et al . , 2020b)和Decoupled GCN ( DGCN ) (丛建国等, 2021)的性能得到了提升。为了创建更稳定、适应性更强的深度GCN架构,我们还提出了ADGCN。

模型公式:

α可以决定拓扑信息与各层初始节点信息之间的权衡,在保留节点信息的同时也扩大了感受野;β控制了模型复杂度,γ可以通过注意力机制聚合各个隐藏层。此外,GCNII具有手动调节的超参数α和β,具有可学习参数β和γ的DGCN,以及具有残差连接的ResGCN

3 实验结果

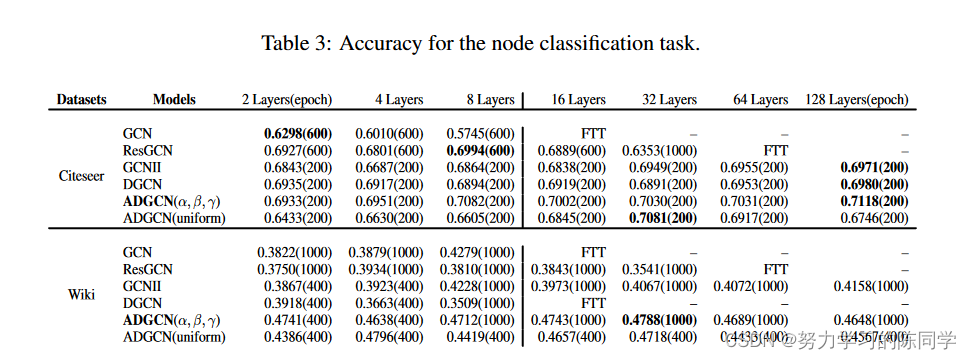

我们使用Cora,Citeseer,PubMed和Wiki变色龙数据集来评估每个模型在节点分类任务中的准确性。

从ResGCN的退化现象观察到,权重矩阵的加入会导致过度变换,增加模型复杂度,并导致过拟合问题。相比之下,具有调节模型复杂度能力的GCNII、DGCN和ADGCN模型则表现出了缓解模型退化的能力。ADGCN专门解决了神经网络中信息在层与层之间不平滑传播的问题以及图结构数据的独特性质,其中既包含拓扑结构信息又包含节点特征信息。通过适当的初始化设置,ADGCN达到最优的性能。GCNII需要手动调整特定层的超参数,并且缺乏跨层的信息聚合,使其不太适合处理大规模图结构数据。DGCN由于其对节点信息的忽略和参数初始化的不足,在性能方面与ADGCN相比表现较差。总体而言,ADGCN模型在处理大规模数据时表现出较高的适应性和可扩展性,同时有效地克服了模型退化问题。

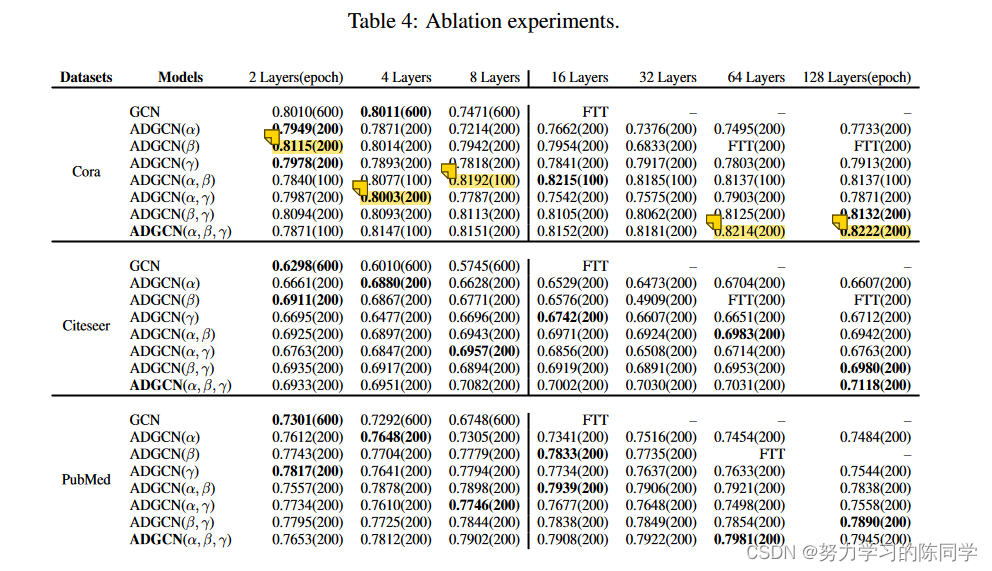

消融实验:

通过γ参数有选择地聚合层间特征信息以保证模型训练的流畅性,通过β参数进一步克服深层模型的退化问题,通过α参数从图结构数据中提取尽可能多的特征。通过这种方法,可以得到一个具有最大潜力的模型。

我们对ADGCN模型的自适应参数进行消融实验,分析其各自的效果。如表4所示,总体而言,与烧蚀实验中的各种设置相比,ADGCN模型显示出更稳定的性能,表明了ADGCN模型各组成部分的重要性。具体来说,仅保留α、β和γ参数的实验结果表现出模型退化问题。保留β和γ参数的ADGCN模型成功克服了退化问题。α参数的加入实现了模型性能的最大提升。这表明了自适应参数之间的递进关系。

764

764

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?