一、权重衰退

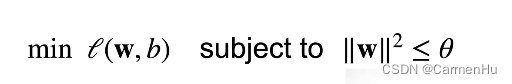

1、使用均方范数作为硬性限制

通过限制参数值的选择范围来控制模型容量

通常不限制偏移b(限不限制都差不多)

小的θ意味着更强的正则项

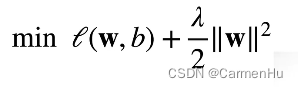

2、使用均方范数作为柔性限制

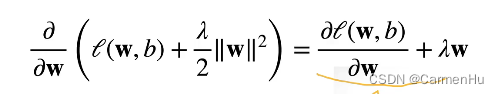

3、参数更新法则

计算梯度

时间t更新参数

![]()

4、权重衰退通过L2正则项使得模型参数不会过大,从而控制模型复杂度

正则项权重控制模型复杂度的超参数

二、丢弃法

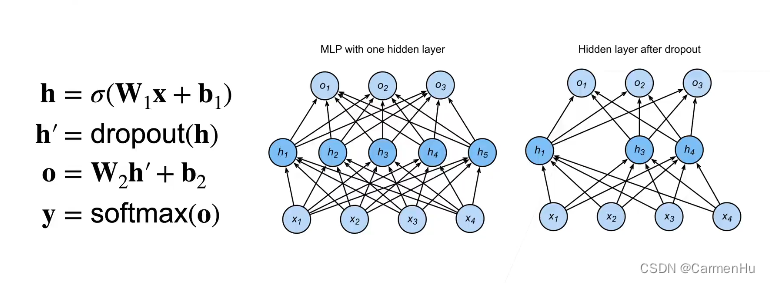

1、一个好的模型需要对输入数据的扰动鲁棒,使用有噪音的数据等价于Tikhonov正则,不同于在输入数据中加噪音,丢弃法是在层之间加入噪音

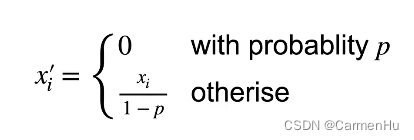

2、无偏差的加入噪音

对x加入噪音得到x',期望E[x']=x;

丢弃法对每个元素进行如下扰动

3、通常将丢弃法作用在隐藏全连接层的输出上

4、推理中的丢弃法

正则项只在训练中使用:他们影响模型参数的更新

在推理过程中,丢弃法直接返回输入h=dropout(h),这样也能保证确定性的输出

5、丢弃法将一些输出项随机置0来控制模型复杂度

常作用在多层感知机的隐藏层输出上

丢弃概率是控制模型复杂度的超参数

本文探讨了两种控制深度学习模型复杂度的技术:通过L2正则项(权重衰退)限制参数值,以及丢弃法,通过在隐藏层添加随机噪声以提高模型鲁棒性。这两种方法都涉及超参数调整以平衡模型性能和复杂度。

本文探讨了两种控制深度学习模型复杂度的技术:通过L2正则项(权重衰退)限制参数值,以及丢弃法,通过在隐藏层添加随机噪声以提高模型鲁棒性。这两种方法都涉及超参数调整以平衡模型性能和复杂度。

1599

1599

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?