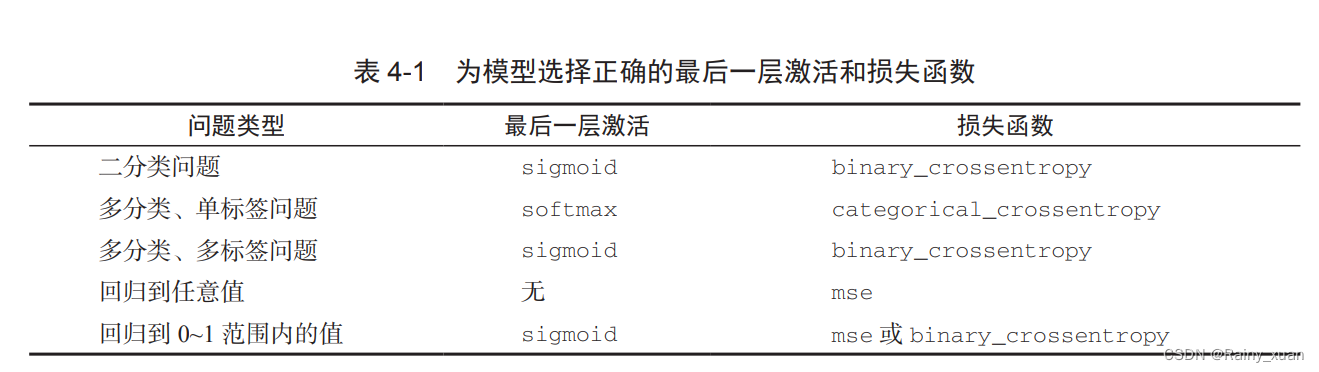

基于keras深度学习中,如何选择最后一层激活和损失函数?

1.激活函数和损失函数

2.几种激活函数

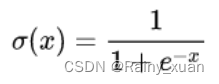

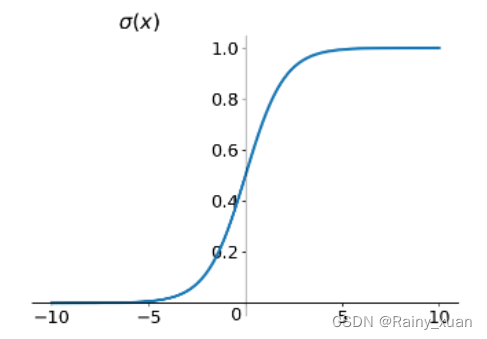

(1)sigmoid

在什么情况下适合使用 Sigmoid 激活函数?

-

Sigmoid 函数的输出范围是 0 到 1。由于输出值限定在 0 到 1,因此它对每个神经元的输出进行了归一化;

-

用于将预测概率作为输出的模型。由于概率的取值范围是 0 到 1,因此 Sigmoid 函数非常合适;

-

梯度平滑,避免「跳跃」的输出值;

-

函数是可微的。这意味着可以找到任意两个点的 sigmoid 曲线的斜率;

-

明确的预测,即非常接近 1 或 0。

缺点

- 容易出现gradient vanishing梯度消失

- 函数输出并不是zero-centered

- 幂运算相对来讲比较耗时

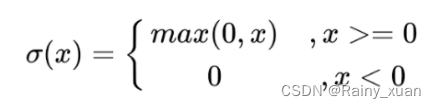

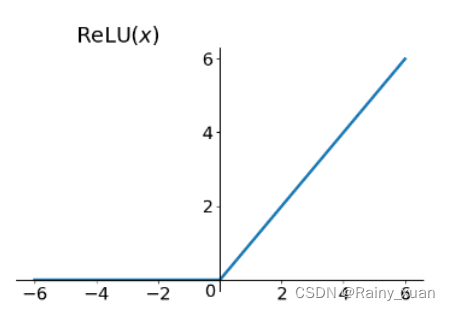

(2)ReLU

ReLU函数其实就是一个取最大值函数,注意这并不是全区间可导的,但是我们可以取sub-gradient,如上图所示。ReLU虽然简单,但却是近几年的重要成果,有以下几大优点:

- 解决了gradient vanishing问题 (在正区间)

- Sigmoid和Tanh激活函数均需要计算指数, 复杂度高, 而ReLU只需要一个阈值即可得到激活值。ReLU 函数中只存在线性关系,因此它的计算速度比 sigmoid 和 tanh 更快。计算速度非常快,只需要判断输入是否大于0。

- 收敛速度远快于sigmoid和tanh

- ReLU的非饱和性可以有效地解决梯度消失的问题, 提供相对宽的激活边界。

- ReLU的单侧抑制提供了网络的稀疏表达能力。

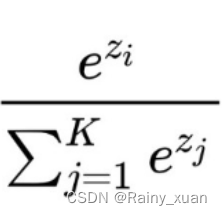

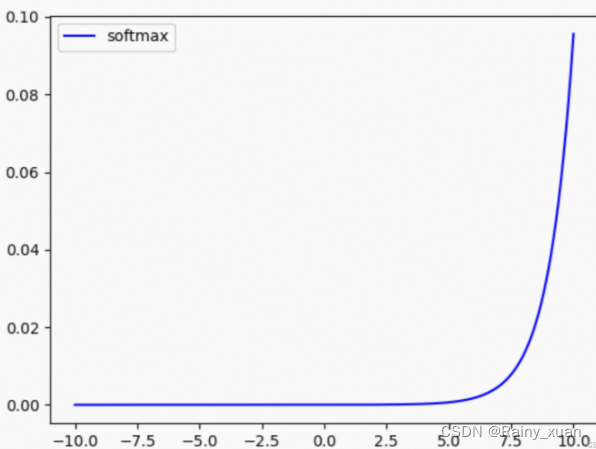

(3)Softmax

Softmax 是用于多类分类问题的激活函数,在多类分类问题中,超过两个类标签则需要类成员关系。对于长度为 K 的任意实向量,Softmax 可以将其压缩为长度为 K,值在(0,1)范 围内,并且向量中元素的总和为 1 的实向量。

Softmax 激活函数的主要缺点是:

- 在零点不可微;

- 负输入的梯度为零,这意味着对于该区域的激活,权重不会在反向传播期间更新,因此会产生永不激活的死亡神经元。

8487

8487

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?