一、迁移学习(Transfer Learning)

训练神经网络往往需要大量数据作为训练样本,但是当我们拥有的训练样本不足时应该怎么训练出有效的神经网络呢?为解决这个现实中经常遇到的问题,我们就来了解一下迁移学习的内容。

简单来说,迁移学习就是利用别人训练好的开源的神经网络程序来训练我们自己的神经网络。在下载程序的时候,不仅仅要下载代码,还要把别人训练好的网络中的权重(weights)下载下来,也就是网络中的参数。

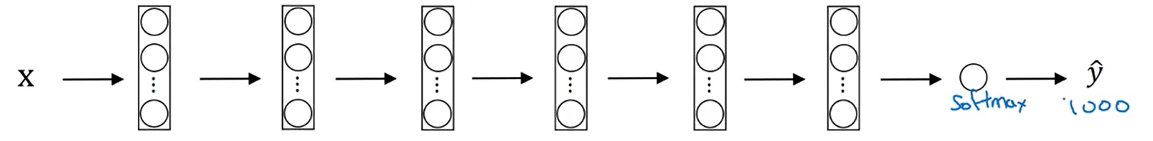

以下图为例,假设原训练好的网络可以做1000种类别的分类,也就是softmax层有1000个神经元。如果我们想要利用这个网络训练一个实现3种类别分类的神经网络,就可以将softmax之前的层都“冻结(freeze)”,把1000个神经元的softmax替换成3个神经元,然后只训练与softmax层有关的参数即可。

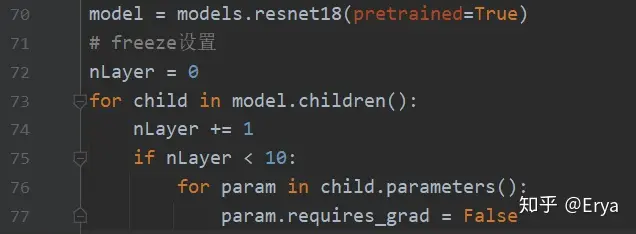

通过使用别人预训练的权重,我们可能只需要规模比较小的数据集就可以训练出性能非常好的神经网络。而对于冻结这样的操作,在代码中的实现取决于我们使用的深度学习框架,例如在pytorch框架下可以使用以下代码对网络的前9层进行冻结。

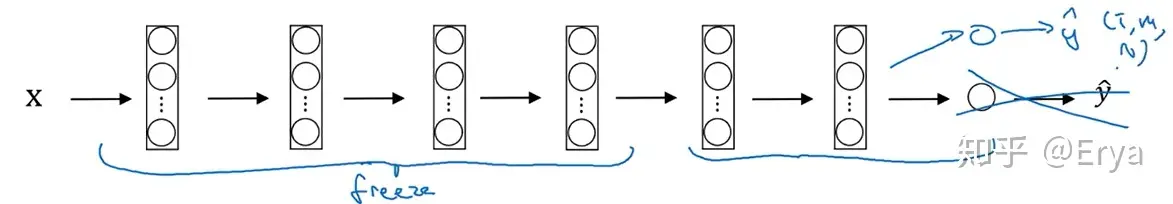

当然,当我们有相对较多的数据样本时,也可以选择冻结更少的层,一般来说按从深到浅的顺序“解冻”。当数据样本足够多时,就不需要冻结了,可以直接将整个预训练的权重当作初始化值来训练。

简单来说,规律就是你拥有的数据样本越多,你需要冻结的层数就越少,你能够训练的层数就越多。但是对于分类器来说,必须自己设置符合需求的softmax层,这个是不能直接拿来用的。

二、数据增强(Data Augmentation)

同样是为了解决计算机视觉深度学习中图像数据样本不足的问题,可以通过对图像做简单处理(如翻转、剪裁、调整亮度等)来达到扩充样本集的目的。

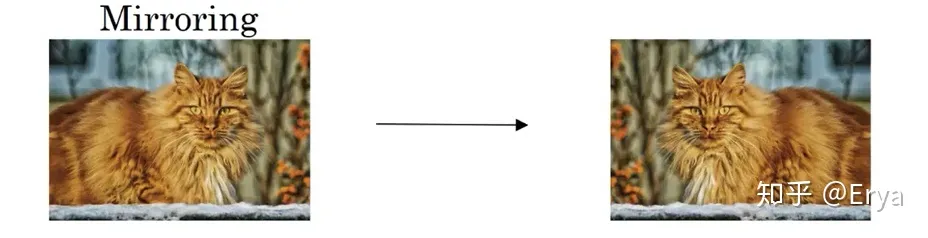

1.镜像翻转

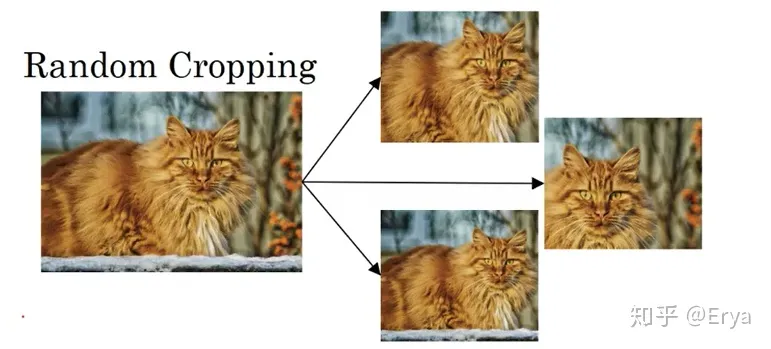

2.随机剪裁

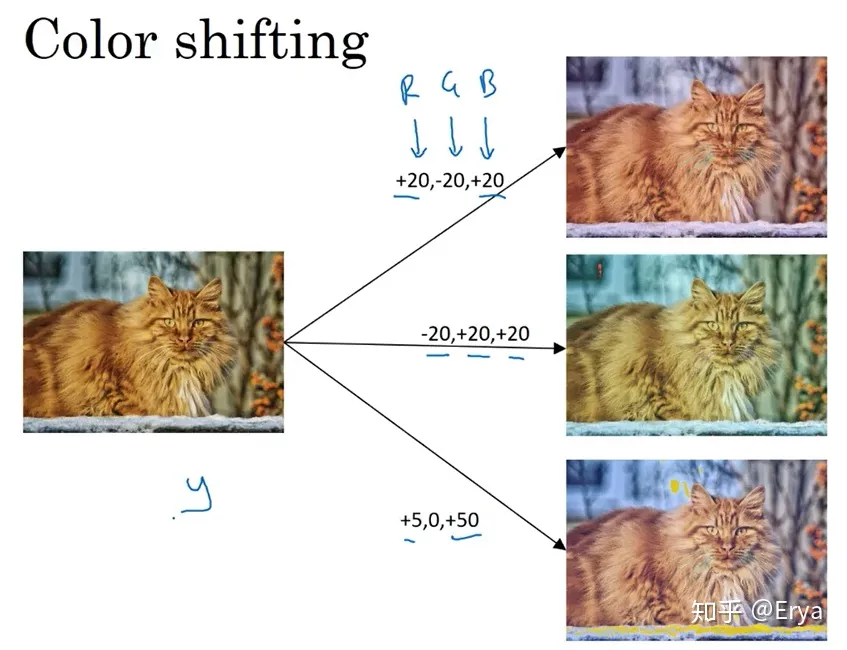

3.颜色变换

其中颜色变换除了可以扩充样本集之外,还可以提高计算机视觉神经网络对于环境光变化的鲁棒性。

第二周的学习至此也结束了,总结来说这周课程的内容开始更多地偏向于实际应用了,尤其是迁移学习和数据增强的方法可以很有效地解决计算机视觉领域样本数据不足的问题。

作者:Erya

链接:https://zhuanlan.zhihu.com/p/336430093

来源:知乎

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

547

547

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?