STGR: Spatio-temporal graph routing for skeleton-based action recognition(AAAI, 2019)

STGR:基于骨架的动作识别的时空图路由(AAAI,2019)

本文从时间和空间的角度设计了邻接矩阵计算方法,以计算节点之间的时间和空间关系。虽然设计了较为复杂的邻接矩阵策略,但效果并不如2S-AGCN

空间图路由子网络

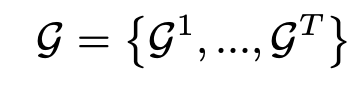

首先根据一种无参数图划分策略,将每一帧的原始图划分为K个子图。将每个子图都当成强连通图,这样就能得到空间图序列:

强连通图:图中每个定点之间都是相通的。

为1时,表示关节i与j在时刻t是相连的,为0时表示不相连,是否相连是根据子图划分情况来决定的,而任意两个子图的节点之间都不会相连(完全隔离)。

为1时,表示关节i与j在时刻t是相连的,为0时表示不相连,是否相连是根据子图划分情况来决定的,而任意两个子图的节点之间都不会相连(完全隔离)。

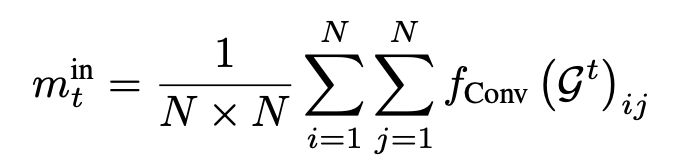

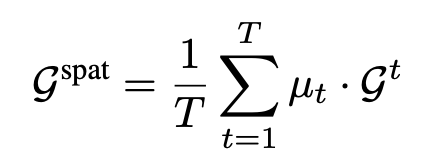

得到了空间连接图序列后,就要从所有图中选出最具信息的一个,首先用7*7的卷积来聚集局部特征,然后再全局取平均(GAP):

这样就将每一时刻的图都用一个标量值来表示:

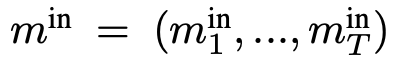

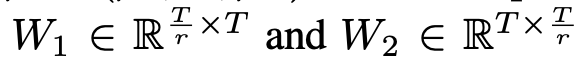

这样m就包含了图的所有信息,并且是一个序列。使用两层全连接层来对m进行进一步加权:

其中:

得到的μ也是一个长为T的权重向量,将T作为权值,回代到原图G中,并在时间范围做平均:

整个这一步,实际上就是对每个时刻的图做了一次加权平均。

时间路由子网络

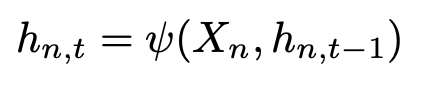

首先将输入序列用每个关节的时序轨迹来表示,这样就得到了N个独立的关节轨迹。接着用一个LSTM来学习每个关节轨迹的浅层表示:

将LSTM最后一个时间步的隐状态作为该关节轨迹的最终表示。(这里说LSTM在不同关节轨迹间参数不共享)得到关节特征经过编码后的特征序列:

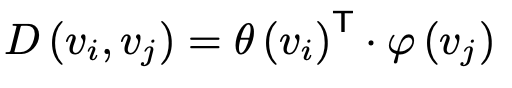

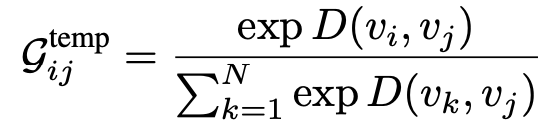

接着通过FC层转换和向量点乘(类似于embedded高斯函数)来计算两个关节之间的联系:

最终学习到关节之间的时域联系。

最终学习到关节之间的时域联系。

时空特征融合

通过concate的方法融合学习到的图,然后进行图卷积。

图(a)是关节的原始关节骨骼连接,图(b)是空间图路由学习到的关节连接,图(c)是时间图路由学习到的连接。

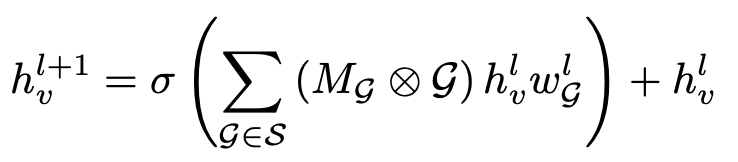

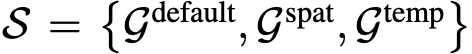

学习到了时间和空间图分别对应各自的邻接矩阵,在进行图卷积时通过加法进行特征融合:

其中

这个公式和ST-GCN很相似,只不过ST-GCN中只有三个不同的空间图,没有时间图。因此本文的工作实际上就是在ST-GCN的基础上,增加了两个额外的邻接矩阵策略,其他地方没有明显改动。优化时不仅使用分类损失函数,还使用图稀疏损失函数,以确保图的稀疏性:

1601

1601

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?