(1)XGBoost(eXtreme Gradient Boosting)是一种梯度提升树(Gradient Boosting Tree)的机器学习算法。常用与分类、回归、排名等。核心思想是通过迭代训练多个弱学习器,并将它们组合起来形成一个强学习器。每个迭代步骤都通过梯度下降法优化目标函数,以最小化损失函数。模型逐步地学习训练数据的残差,并将每个新学习器的预测结果与之前学习器的预测结果相加,形成最终的预测结果。

(2)注意点:

1、构造模型需要的xgb.DMatrix对象:data.matrix转化为矩阵,Matrix中sparse = T转化为稀疏矩阵,再转化为xgb.DMatrix。

2、xgboost建立模型

3、predict预测

(3)具体操作:

读取数据

#读取数据

data(agaricus.train, package='xgboost')

data(agaricus.test, package='xgboost')

class(agaricus.train)#性质为list数据处理

dtrain <- with(agaricus.train, xgb.DMatrix(data, label = label, nthread = 2))

dtest <- with(agaricus.test, xgb.DMatrix(data, label = label, nthread = 2))

watchlist <- list(train = dtrain, eval = dtest)#设置训练集和测试集简单的xgb.train例子:

param <- list(max_depth = 2, eta = 1, verbose = 0, nthread = 2,

objective = "binary:logistic", eval_metric = "auc")

bst <- xgb.train(param, dtrain, nrounds = 2, watchlist)

#使用自定义参数:

#此函数的作用是根据预测值和真实标签计算出逻辑回归模型的梯度和黑塞矩阵,

#并将它们封装在一个列表中返回,供 XGBoost 模型使用。

logregobj <- function(preds, dtrain) {

labels <- getinfo(dtrain, "label")

preds <- 1/(1 + exp(-preds))

grad <- preds - labels

hess <- preds * (1 - preds)

return(list(grad = grad, hess = hess))

}

#计算二分类问题中误差率(error rate)的值,并将其作为结果返回。

evalerror <- function(preds, dtrain) {

labels <- getinfo(dtrain, "label")

err <- as.numeric(sum(labels != (preds > 0)))/length(labels)

return(list(metric = "error", value = err))

}

#传递上述两个函数:

#作为参数列表中的'objective'和'eval_metric'参数:

param<-list(max_depth = 2, eta = 1, verbose = 0, nthread = 2,

objective = logregobj, eval_metric = evalerror)

bst<-xgb.train(param, dtrain, nrounds = 2, watchlist)

#参数不仅可放在param中,也可以直接放在xgb.train中

param<-list(max_depth = 2, eta = 1, verbose = 0, nthread = 2)

bst<-xgb.train(param, dtrain, nrounds = 2, watchlist,

objective = logregobj, eval_metric = evalerror)

#可以使用缩写 'obj' 和 'feval'

bst <- xgb.train(param, dtrain, nrounds = 2, watchlist,

obj = logregobj, feval = evalerror)

#在每次迭代中使用可变学习率的xgb.train示例:

param <- list(max_depth = 2, eta = 1, verbose = 0, nthread = 2,

objective = "binary:logistic", eval_metric = "auc")

my_etas <- list(eta = c(0.5, 0.1))

bst <- xgb.train(param, dtrain, nrounds = 2, watchlist,

callbacks = list(cb.reset.parameters(my_etas)))

#提前终止:指定如果模型在指定轮数内没有改善,就提前停止训练。early_stopping_rounds

bst<-xgb.train(param, dtrain, nrounds = 25, watchlist,

early_stopping_rounds = 3)

#预测

bst <- xgboost(data = agaricus.train$data, label = agaricus.train$label,

max_depth = 2, eta = 1, nthread = 2, nrounds = 2,

objective = "binary:logistic")

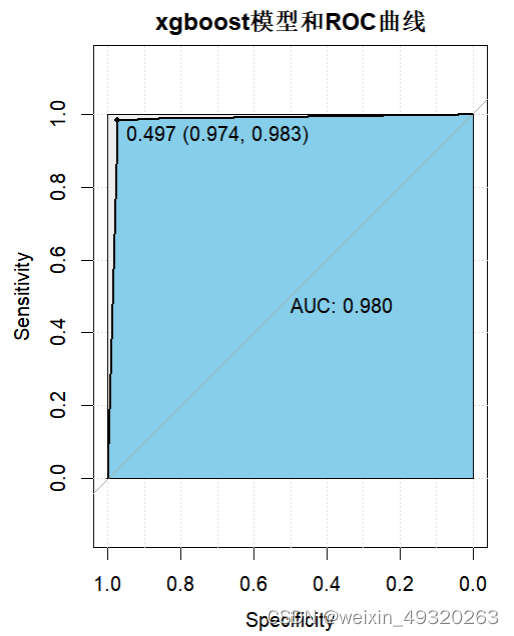

pred <- predict(bst, agaricus.test$data)绘制ROC曲线

#绘制ROC曲线

require(pROC)

xgboost_roc<-roc(agaricus.test$label,as.numeric(pred))

#绘制ROC曲线和AUC值

plot(xgboost_roc,print.auc=TRUE,auc.polygon=TRUE,

grid=c(0.1,0.2),gird.col=c("green","red"),

max.auc.polygon=TRUE,auc.polygon.col="skyblue",

print.thres=TRUE,main='xgboost模型和ROC曲线')

参考文献:

http://127.0.0.1:14873/library/xgboost/doc/xgboost.pdf

211

211

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?