目录

前言

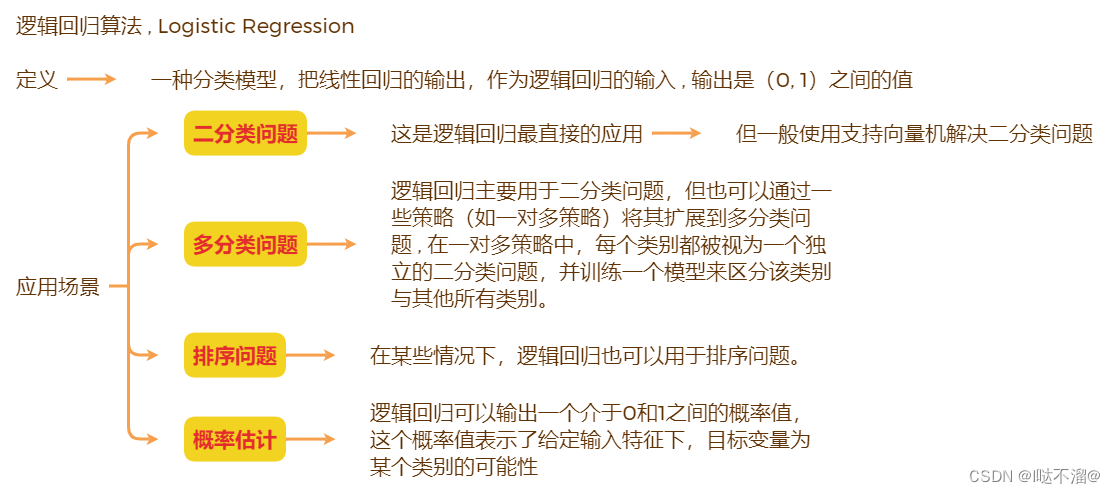

机器学习中的逻辑回归(Logistic Regression)算法是一种广泛应用于分类问题的统计学习方法。尽管它的名字中包含“回归”二字,但实际上它主要用于处理二分类或多分类问题,而不是数值预测。逻辑回归通过建立目标变量(通常是二元分类标签)与输入特征之间的概率模型,来预测目标变量发生的概率。

本文结合博主个人所学和对算法的理解,总结了在逻辑回归问题中的重要知识点和一些案例,非常适合新手进行入门学习。

一、概述

1. 优点

在数据驱动的决策制定和自动化分析中,分类算法发挥着至关重要的作用。逻辑回归作为一种简单而强大的分类算法,具有以下几个显著的优点:

- 解释性强:逻辑回归模型可以输出每个特征对最终分类结果的影响程度,这使得模型结果易于解释和理解。

- 计算效率高:逻辑回归的计算成本相对较低,适合处理大规模数据集。

- 无需假设线性关系:虽然逻辑回归模型的数学形式是基于线性假设的,但它实际上可以处理非线性关系,通过特征转换或非线性特征生成来实现。

- 易于实现和调试:逻辑回归算法实现简单,易于在多种编程语言和机器学习库中实现,同时也方便进行调试和优化。

2. 定义和应用场景

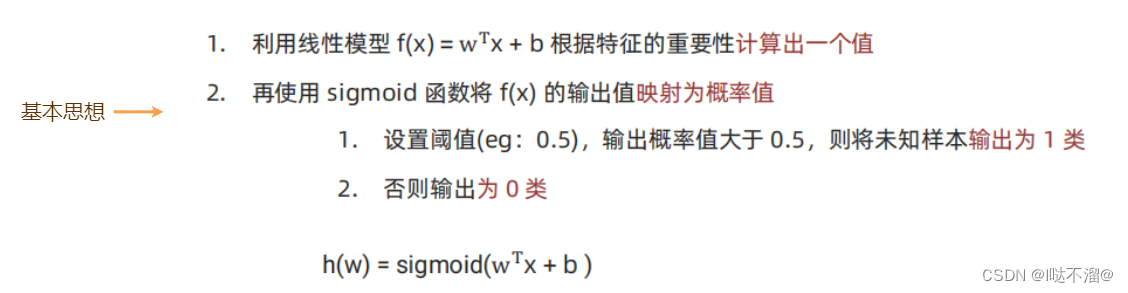

3. 基本思想

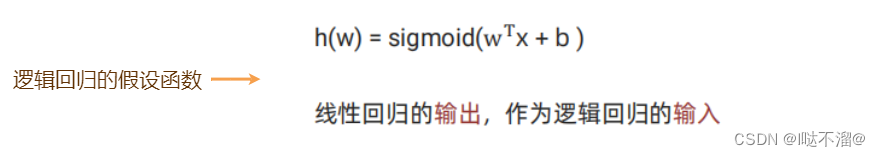

4.逻辑回归的假设函数

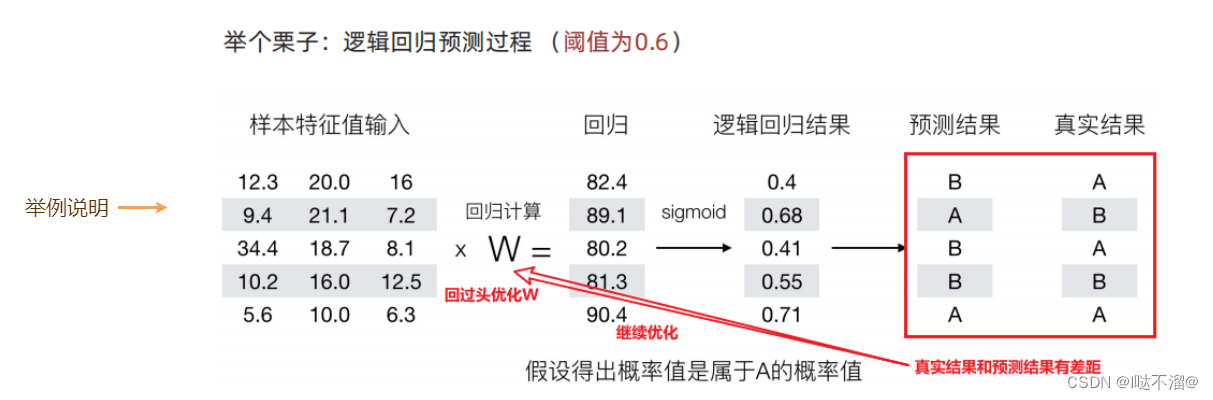

5. 举例说明

二、数学基础

在学习逻辑回归算法之前,必须掌握一些基本的数学原理的理解,博主在这里进行了一个系统的整理。

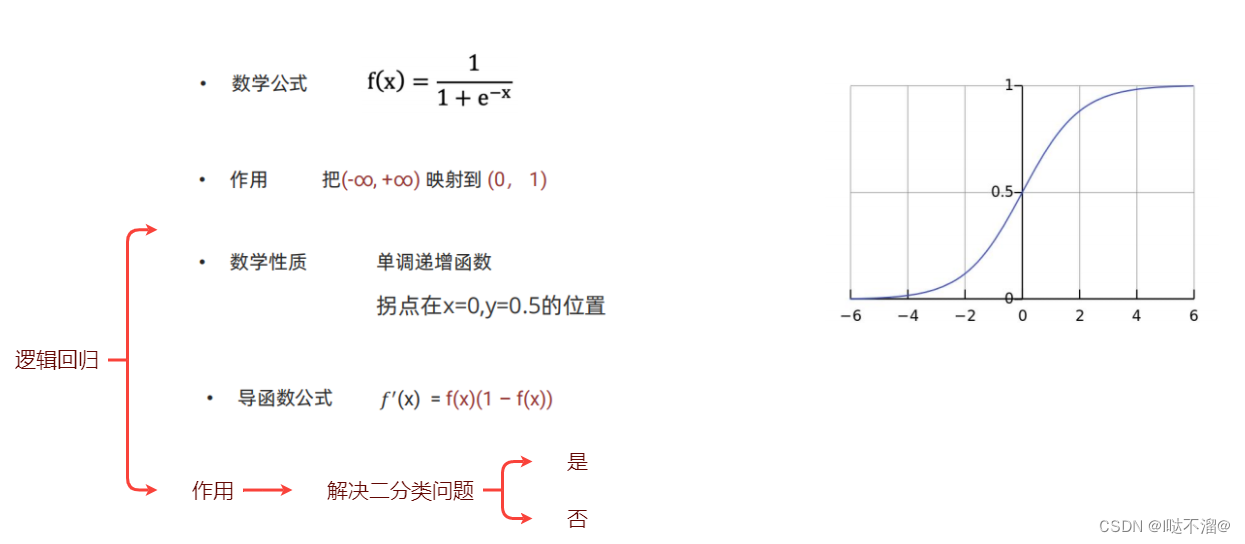

1. 逻辑回归

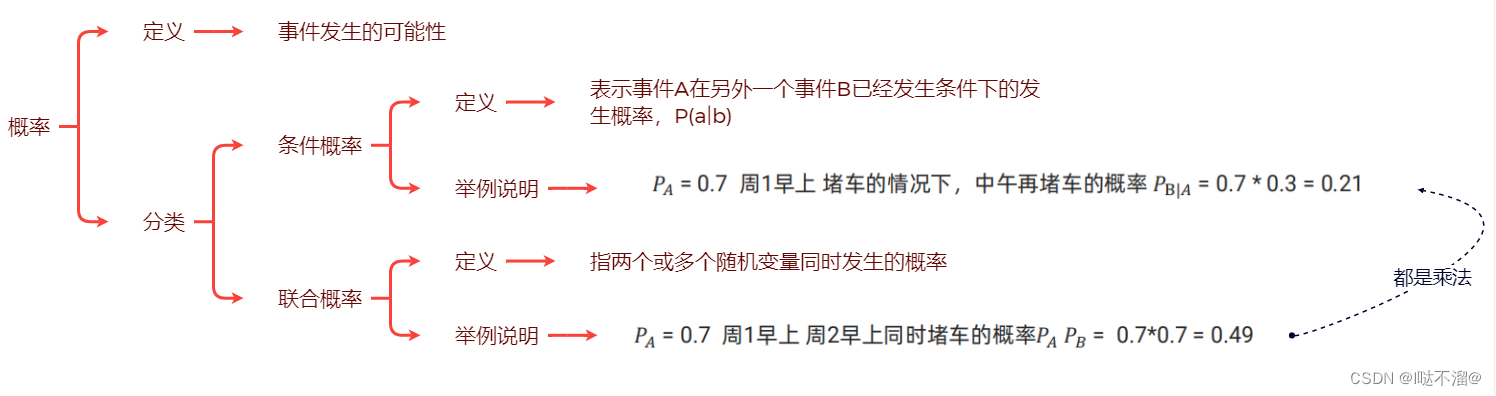

2. 概率

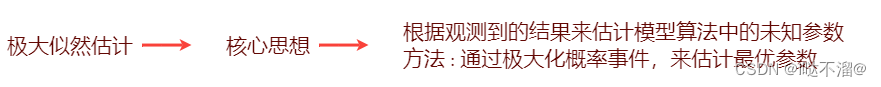

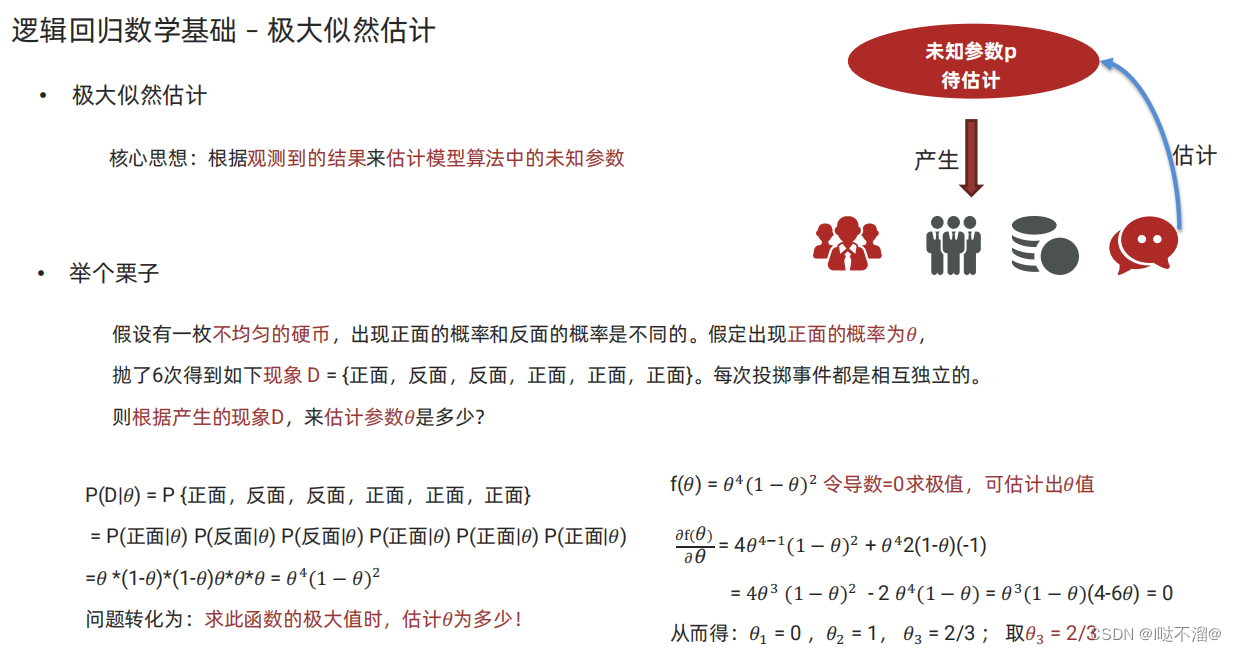

3. 极大似然估计

举例说明:

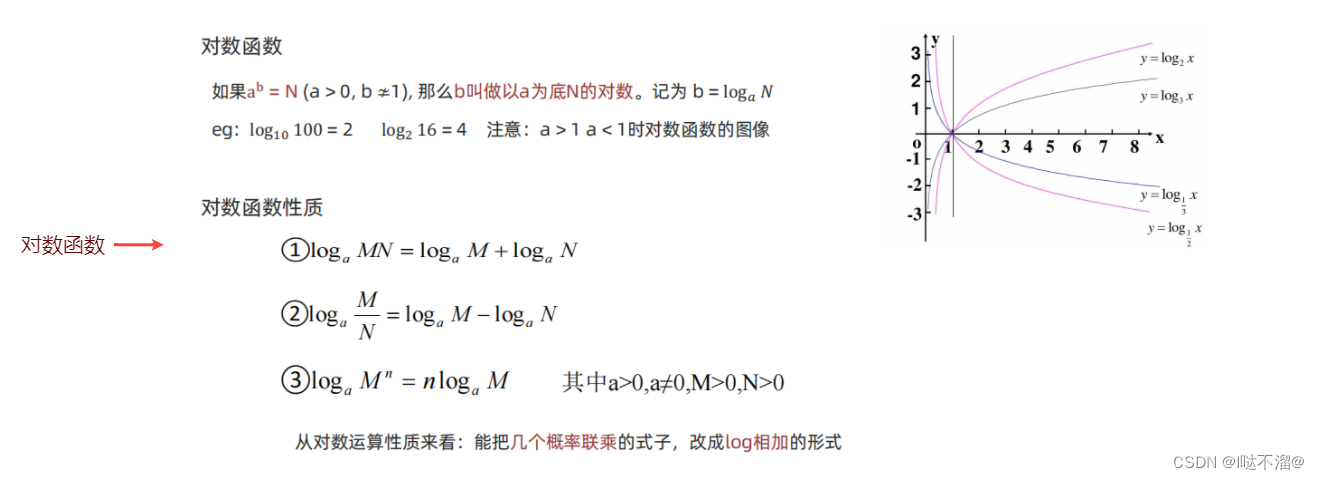

4. 对数函数

三、损失函数

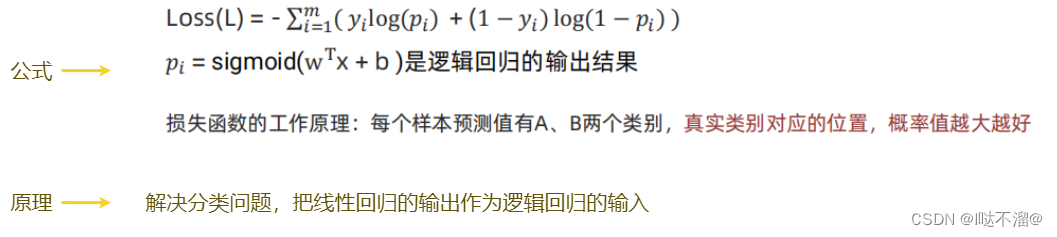

1. 原理和公式

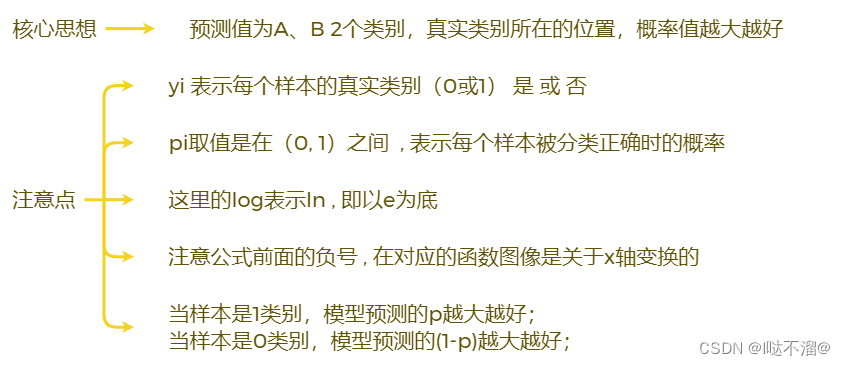

2. 核心思想和需要注意的点

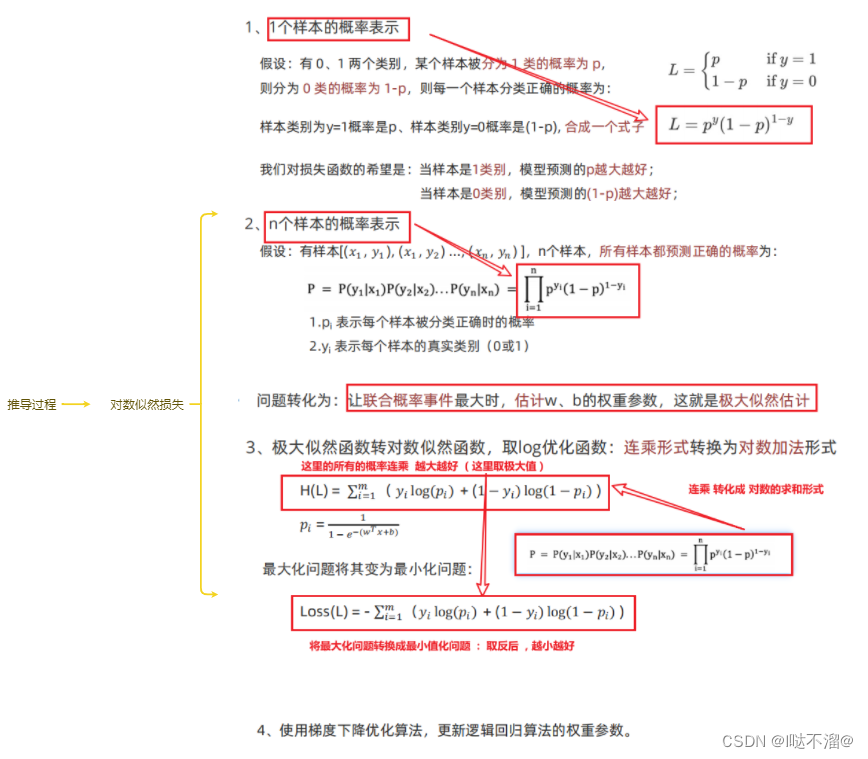

3. 推导过程

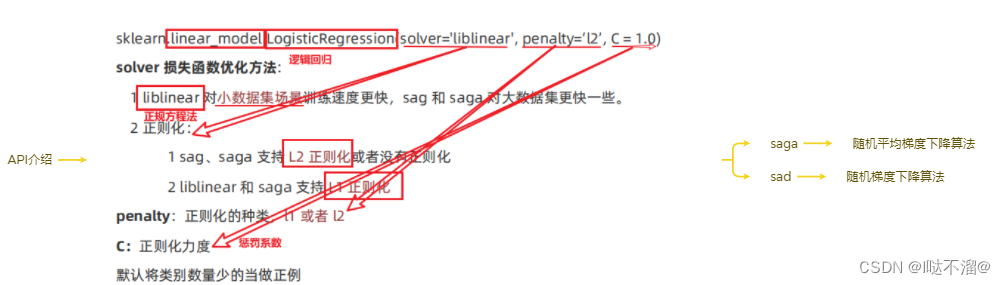

4. API介绍

四、分类评估方法

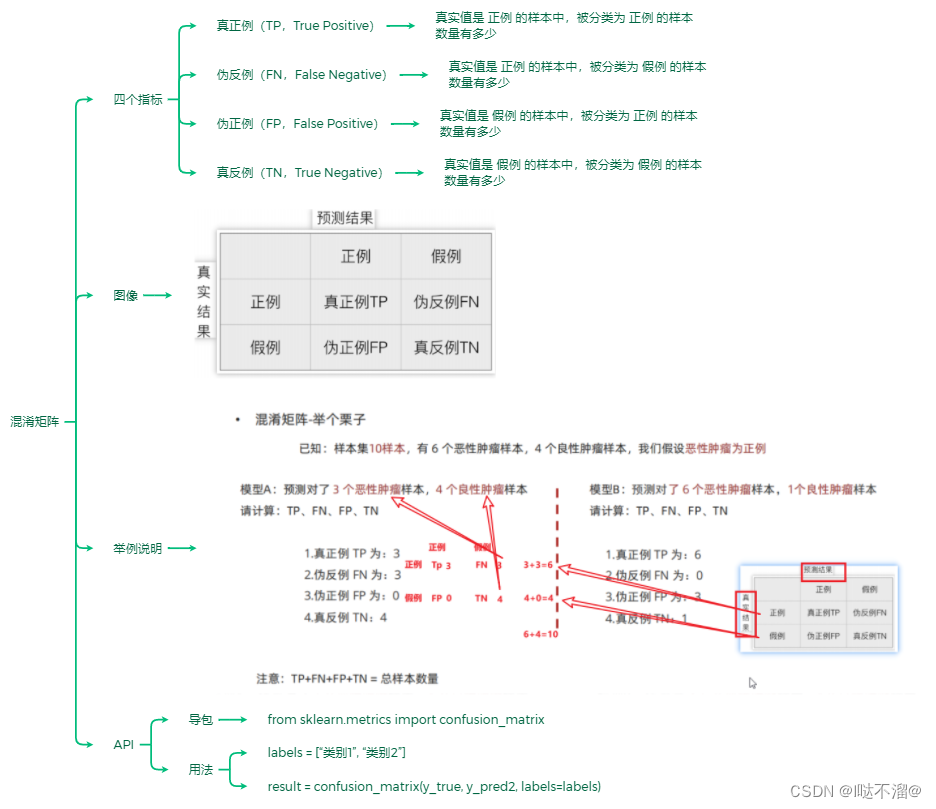

1. 混淆矩阵

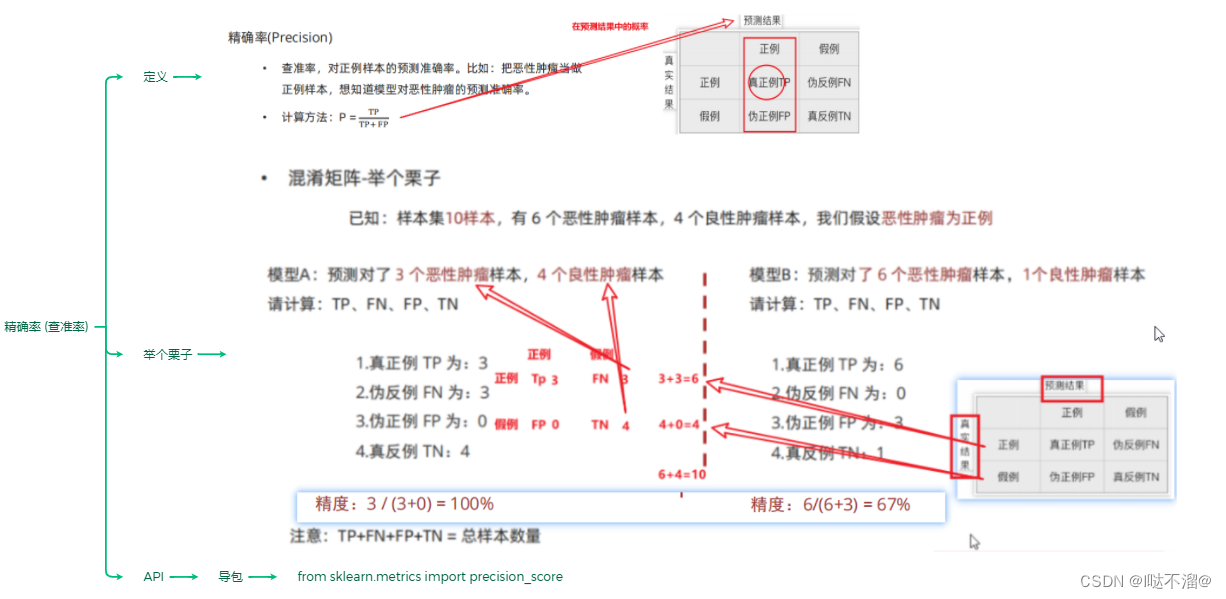

2. 精确率

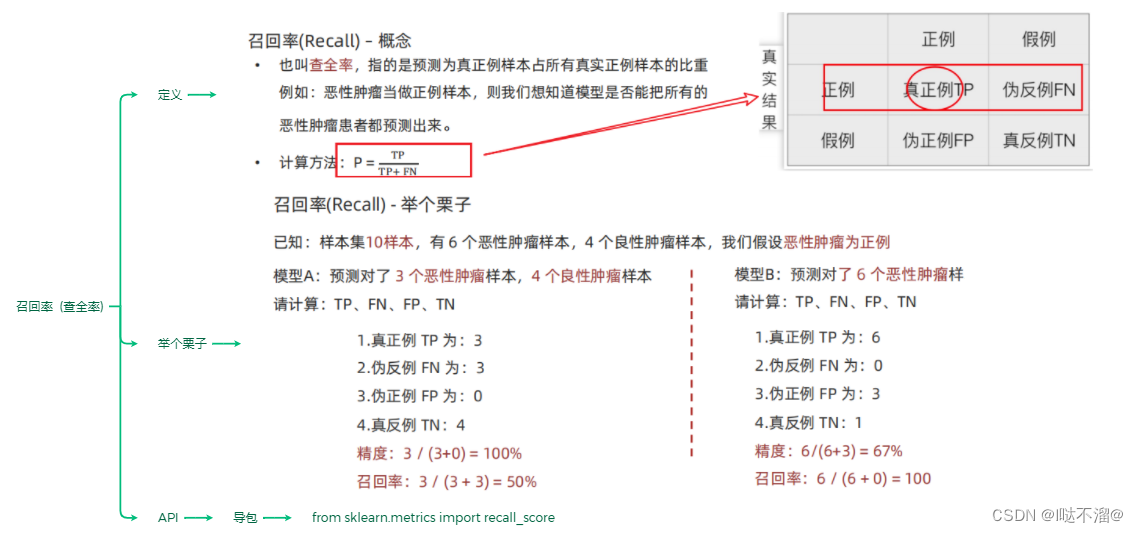

3. 召回率

4. F1-score

5. ROC曲线

5.1 定义和应用范围

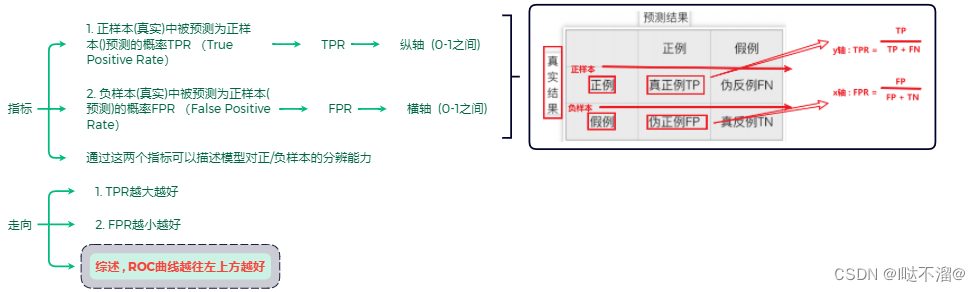

5.2 指标和走向

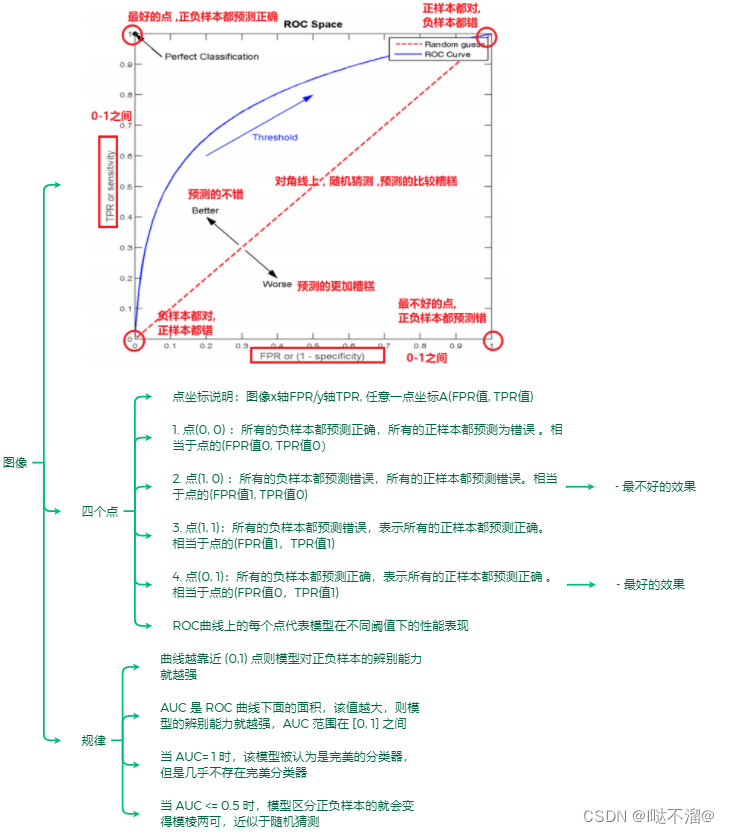

5.3 图像

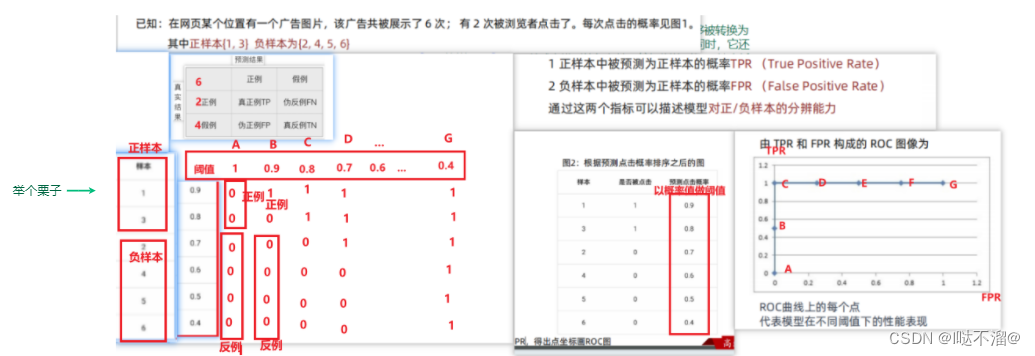

5.4 举个栗子

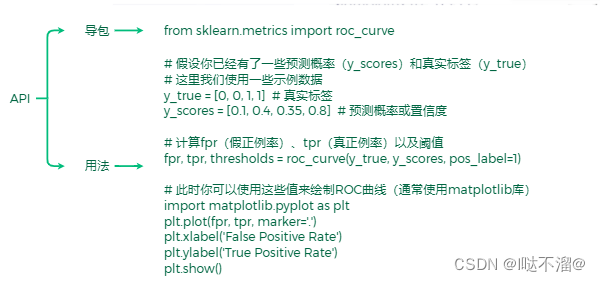

5.5 API

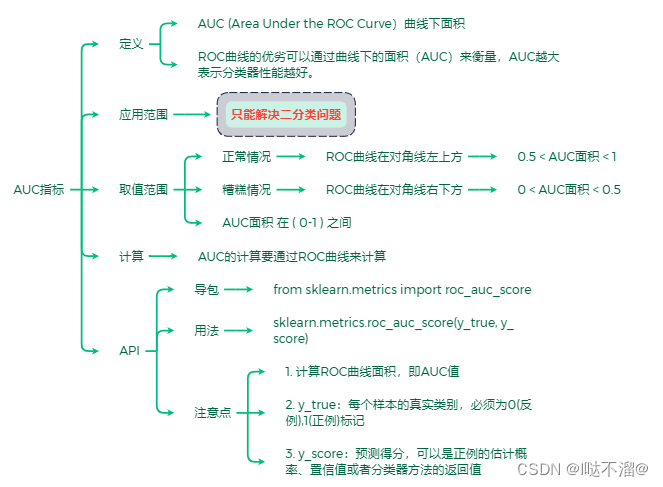

6. AUC指标

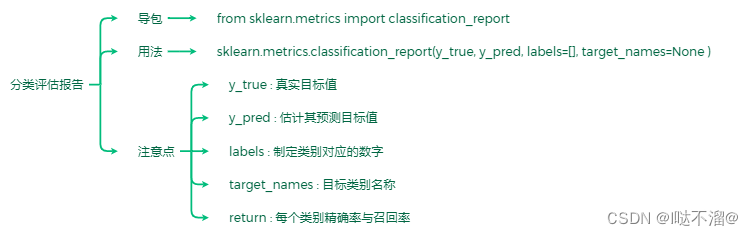

7. 分类评估报告

五、拓展

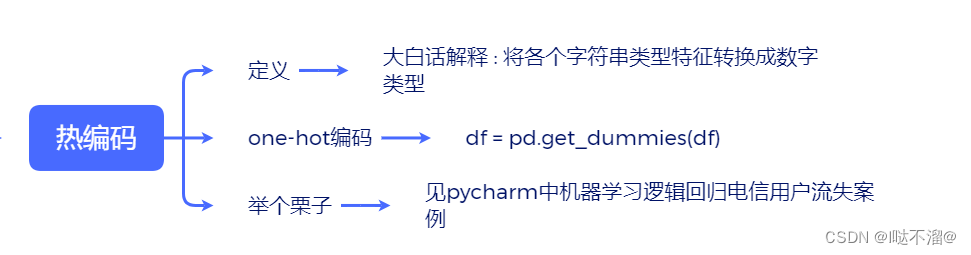

1. 热编码

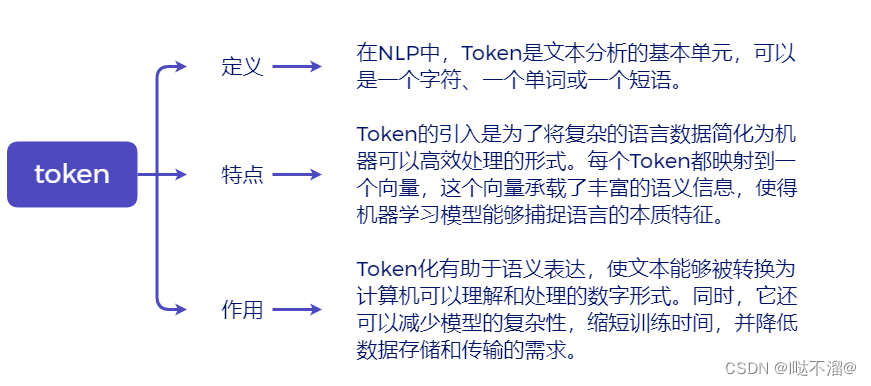

2. Token

六、模型建立过程

- 数据准备:首先需要准备训练数据集,该数据集包括输入特征和对应的输出值(通常是二进制的,表示样本的类别)。

- 特征选择:为了提高模型的泛化能力,可以通过特征选择来减少冗余特征和噪声特征的影响。

- 训练模型:使用训练数据集来训练逻辑回归模型,通过优化算法(如梯度下降法)来求解模型的参数(即输入特征的权重和偏置项)。

- 模型评估:使用测试数据集来评估模型的性能,常用的评估指标包括准确率、召回率、F1值等。

七、总结

总之,逻辑回归算法是一种简单而有效的分类算法,在处理二分类问题时具有广泛的应用。然而,在处理非线性可分、多分类问题或存在异常值的情况下,需要采取一些优化措施来提高模型的性能。关于逻辑回归算法的应用需要注意许多问题,文中只总结了常见的一些内容,如有不足请自行总结。

1010

1010

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?