前言

在当前的数据驱动时代,测未来的趋势、需求、资源分配等成为了许多行业关键决策的基石。长短期记忆网络(Long Short-Term Memory, LSTM)作为一种特殊的循环神经网络(RNN),因其在处理时间序列数据上的卓越性能而受到广泛关注。LSTM能够学习长期依赖信息,解决了传统RNN在长序列学习过程中的梯度消失问题。在本文中,我们将探索如何利用LSTM进行多输出回归预测,即同时预测多个连续值输出,辅以实例代码加以说明,详细代码请见:https://www.kdocs.cn/l/cmQ0BXiurpbg。

一、LSTM的基本原理

LSTM网络包括三个重要的门结构:遗忘门、输入门和输出门,它们共同决定了如何更新和保留网络的状态。具体来说,遗忘门控制保留多少旧信息,输入门决定加入多少新信息,而输出门决定下一状态的输出量。这种结构使LSTM特别适合处理和预测时间序列数据中的长期依赖关系。

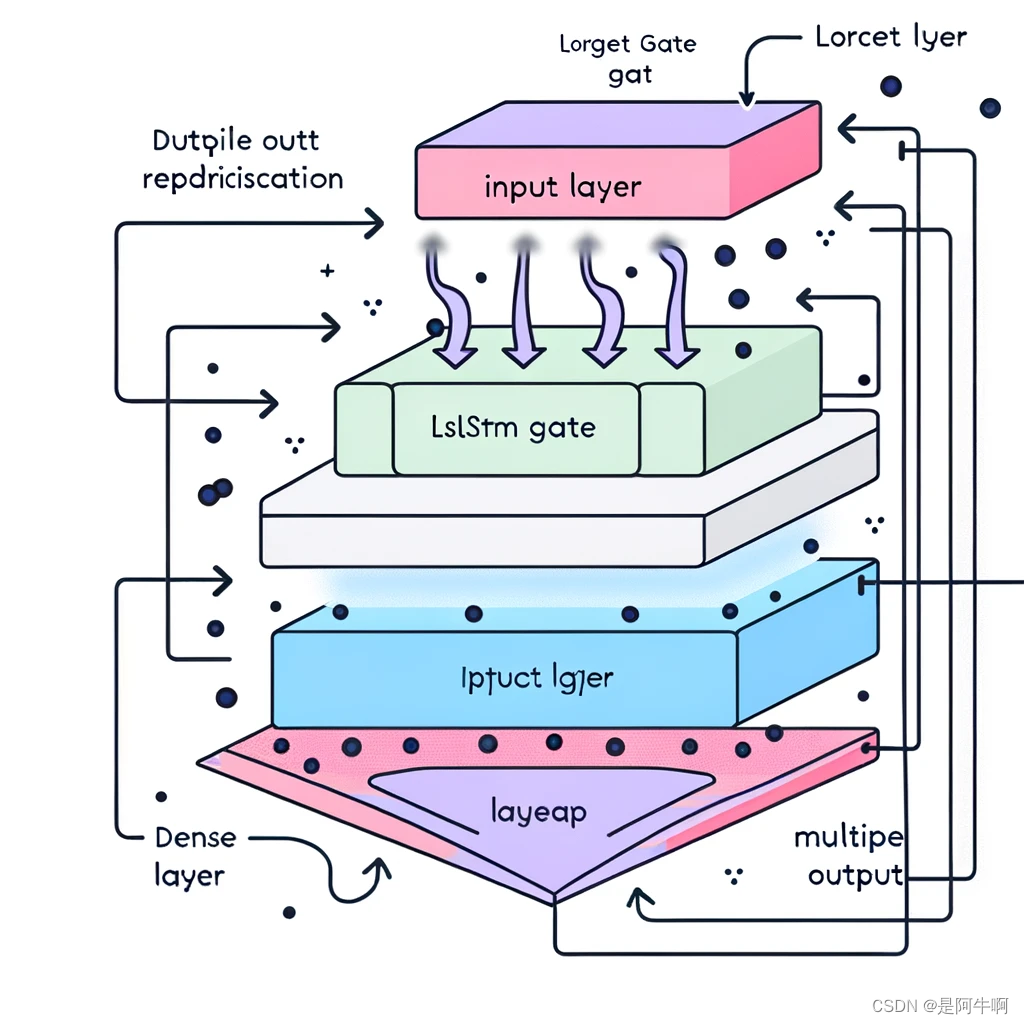

二、多输出回归预测模型架构

在多输出回归预测中,模型的目标是基于输入序列预测多个连续值。这种类型的模型在许多实际场景中非常有用,如天气预测、股价预测、资源需求预测等。一个典型的LSTM多输出回归模型包括:

输入层:接受原始时间序列数据。

LSTM层:一或多个LSTM层用于学习序列中的长期依赖关系。

输出层:一个全连接层(Dense),输出多个预测值。

三、示例代码

假设我们的任务是基于过去一段时间的销售数据(如每日销量),预测未来几天的销量。以下是一个简单的实例代码,演示了如何使用28个特征预测3个输出,构建一个LSTM多输出回归模型。代码已跑通,只需修改几个参数和数据集即可,代码有详细注释,小白也可轻易看懂。

代码已上传至:https://www.kdocs.cn/l/cmQ0BXiurpbg

1.读入数据并划分数据集

%% 清空环境变量

warning off % 关闭报警信息

close all % 关闭开启的图窗

clear % 清空变量

clc % 清空命令行

%% 导入数据

dataset = xlsread('Dataset.xlsx');

%% 数据维度

Input_size = 28;

Output_size = 3;

%% 划分训练集和测试集

%matrix = 1:1:700;

matrix = randperm(718);

%rng(0);

Label_train = dataset(matrix(1: 575), 1 : 28)';

Target_train = dataset(matrix(1: 575), 29: 31)';

M = size(Label_train, 2);

Label_test = dataset(matrix(576: end), 1 : 28)';

Target_test = dataset(matrix(576: end), 29: 31)';

N = size(Label_test, 2);

...

...

...

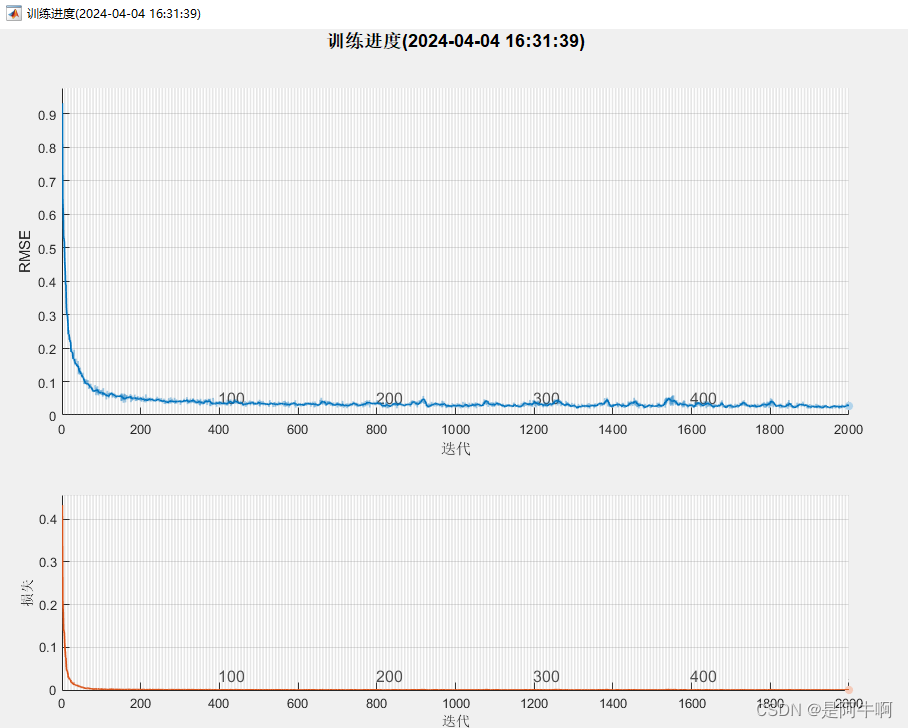

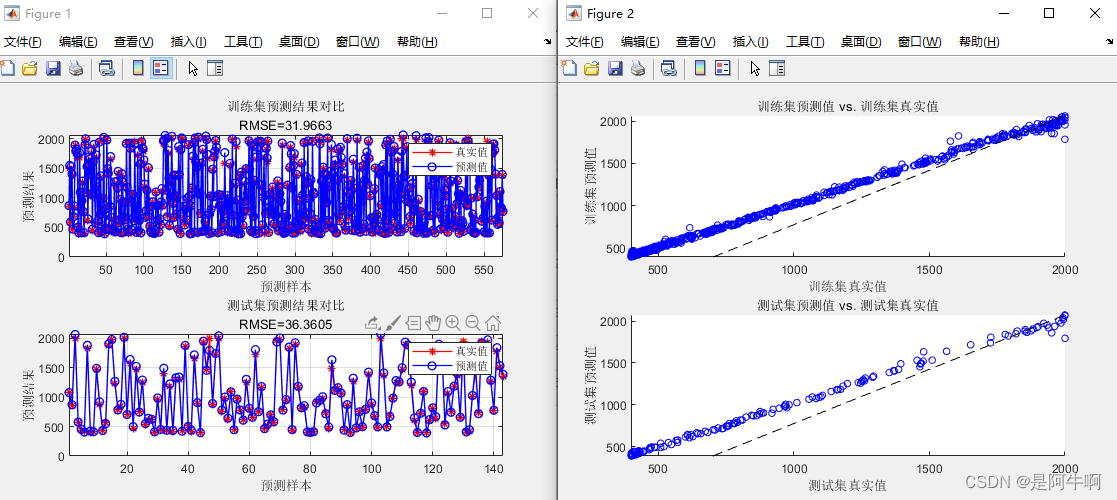

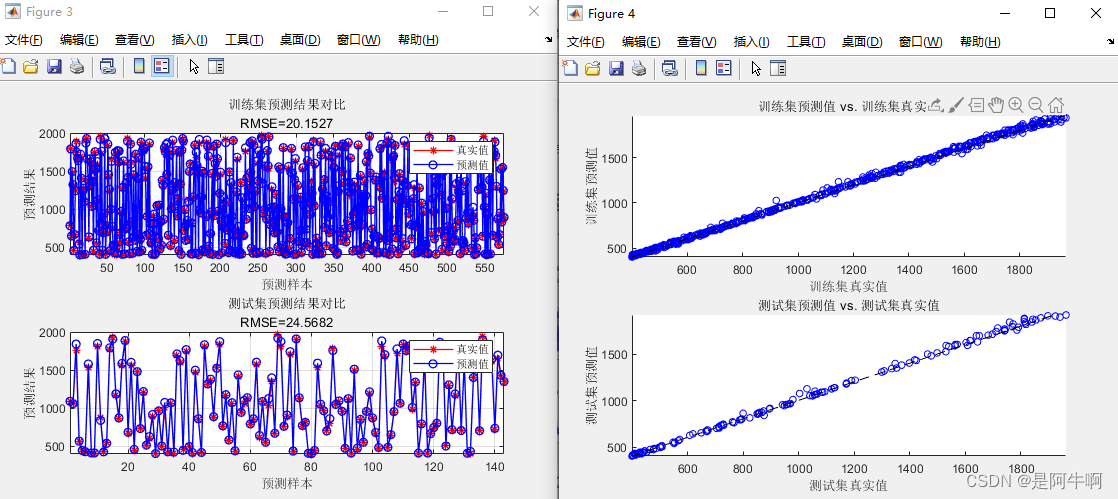

2.运行结果

训练过程:

输出1:

输出2:

输出3:

总结

基于LSTM的多输入多输出的回归预测。代码已跑通,只需修改几个参数和数据集即可,代码有详细注释,小白也可轻易看懂。

1015

1015

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?