一、这里是来自本人根据训练营第二期第二节课的内容以及操作文档做的一些笔记。

1 部署 InternLM2-Chat-1.8B 模型进行智能对话

1.1 配置基础环境

首先,打开 Intern Studio界面,创建开发机并配置开发机系统。

填写 开发机名称 后,点击 选择镜像 使用 Cuda11.7-conda 镜像,然后在资源配置中,使用 10% A100 * 1 的选项,然后立即创建开发机器。

点击 进入开发机 选项。

进入开发机后,在 terminal 中输入环境配置命令 (配置环境时间较长,需耐心等待)

conda create -n demo python==3.10 -y

conda activate demo

conda install pytorch==2.0.1 torchvision==0.15.2 torchaudio==2.0.2 pytorch-cuda=11.7 -c pytorch -c nvidia配置完成后,进入到新创建的 conda 环境之中:

conda activate demo输入以下命令,完成环境包的安装:

pip install huggingface-hub==0.17.3

pip install transformers==4.34

pip install psutil==5.9.8

pip install accelerate==0.24.1

pip install streamlit==1.32.2

pip install matplotlib==3.8.3

pip install modelscope==1.9.5

pip install sentencepiece==0.1.992.2 下载 InternLM2-Chat-1.8B 模型

这里的话我本人还是觉得,在自己的本地服务器通过modelscope进行模型的下载会更有通用性。

直接在自己的文件子目录建一个doenload.py文件,然后写入以下代码:

import os

from modelscope.hub.snapshot_download import snapshot_download

# 创建保存模型目录(你要是自己创建其实也行

os.system("mkdir /root/models")

# save_dir是你自己定义的模型保存到本地的目录

save_dir="/root/InternLM2-model/models"

snapshot_download("Shanghai_AI_Laboratory/internlm2-chat-1_8b", #定义模型自己所在的位置(模型库中的位置)

cache_dir=save_dir, #定义模型下载至本地的目录

revision='v1.1.0')#定义版本执行download.py文件,下载模型参数文件:

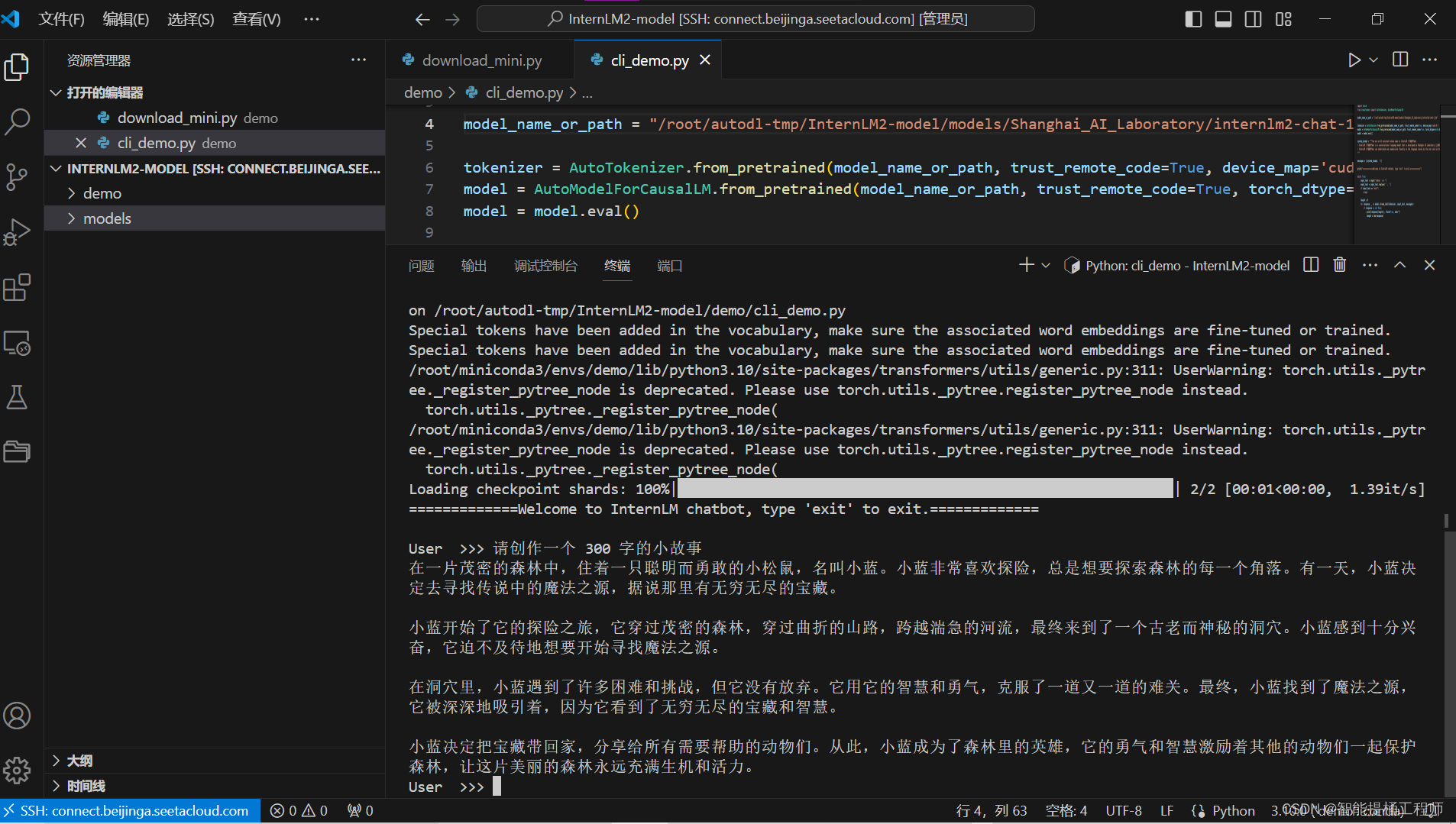

2.3 运行 cli_demo

在demo目录下建立cli_demo.py 文件,复制以下代码:(记得修改自己刚刚下载的模型路径喔!)

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

model_name_or_path = "/root/InternLM2-mdoel/models/Shanghai_AI_Laboratory/internlm2-chat-1_8b"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='cuda:0')

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='cuda:0')

model = model.eval()

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

messages = [(system_prompt, '')]

print("=============Welcome to InternLM chatbot, type 'exit' to exit.=============")

while True:

input_text = input("\nUser >>> ")

input_text = input_text.replace(' ', '')

if input_text == "exit":

break

length = 0

for response, _ in model.stream_chat(tokenizer, input_text, messages):

if response is not None:

print(response[length:], flush=True, end="")

length = len(response)输入命令,执行cli_demo.py程序即可:

等待模型加载完成,就可以进入chat了,键入内容示例:

请创作一个 300 字的小故事

他就会给你一个小故事,这是我的效果

3 实战:部署实战营优秀作品 八戒-Chat-1.8B 模型

3.1 简单介绍 八戒-Chat-1.8B、Chat-嬛嬛-1.8B、Mini-Horo-巧耳(实战营优秀作品)

八戒-Chat-1.8B、Chat-嬛嬛-1.8B、Mini-Horo-巧耳 均是在第一期实战营中运用 InternLM2-Chat-1.8B 模型进行微调训练的优秀成果。其中,八戒-Chat-1.8B 是利用《西游记》剧本中所有关于猪八戒的台词和语句以及 LLM API 生成的相关数据结果,进行全量微调得到的猪八戒聊天模型。作为 Roleplay-with-XiYou 子项目之一,八戒-Chat-1.8B 能够以较低的训练成本达到不错的角色模仿能力,同时低部署条件能够为后续工作降低算力门槛。

这里就是让我们大家自己部署一下这个模型,自己复现一下。

3.2 配置基础环境

运行环境命令:

conda activate demo使用 git 命令来获得仓库内的 Demo 文件:

cd /root/ #写clone的路径

git clone https://gitee.com/InternLM/Tutorial -b camp2

# git clone https://github.com/InternLM/Tutorial -b camp2

cd /root/Tutorial #打开文件3.3 下载运行 Chat-八戒 Demo

在 Web IDE 中执行 bajie_download.py:

python /root/Tutorial/helloworld/bajie_download.py待程序下载完成后,输入运行命令:

streamlit run /root/Tutorial/helloworld/bajie_chat.py --server.address 127.0.0.1 --server.port 6006

#run后面接的是bajie_chat.py的绝对路径喔然后就可以打开八戒chat了,哥们我忘记截图了,哈哈哈,下次再截图留念

4 实战:使用 Lagent 运行 InternLM2-Chat-7B 模型(这玩意要高算力,等我做完这个再说)

4.1 初步介绍 Lagent 相关知识

Lagent 是一个轻量级、开源的基于大语言模型的智能体(agent)框架,支持用户快速地将一个大语言模型转变为多种类型的智能体,并提供了一些典型工具为大语言模型赋能。它的整个框架图如下:

Lagent 的特性总结如下:

- 流式输出:提供 stream_chat 接口作流式输出,本地就能演示酷炫的流式 Demo。

- 接口统一,设计全面升级,提升拓展性,包括:

- Model : 不论是 OpenAI API, Transformers 还是推理加速框架 LMDeploy 一网打尽,模型切换可以游刃有余;

- Action: 简单的继承和装饰,即可打造自己个人的工具集,不论 InternLM 还是 GPT 均可适配;

- Agent:与 Model 的输入接口保持一致,模型到智能体的蜕变只需一步,便捷各种 agent 的探索实现;

- 文档全面升级,API 文档全覆盖。

4.2 配置基础环境

老样子,先配置虚拟环境,再clone代码

重新开启开发机,输入命令,开启 conda 环境:

conda activate demo

使用 git 命令下载 Lagent 相关的代码库:

git clone https://gitee.com/internlm/lagent.git

# git clone https://github.com/internlm/lagent.git

cd /root/demo/lagent

git checkout 581d9fb8987a5d9b72bb9ebd37a95efd47d479ac

pip install -e . # 源码安装4.3 使用 Lagent 运行 InternLM2-Chat-7B 模型为内核的智能体

这边建议还是自己用modelscope或者其它模型下载方式自己写代码下载基础模型。

打开 lagent 路径:

cd /root/demo/lagent在 terminal 中输入指令,构造软链接快捷访问方式:

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-7b /root/models/internlm2-chat-7b打开 lagent 路径下 examples/internlm2_agent_web_demo_hf.py 文件,并修改对应位置 (71行左右) 代码:

# 其他代码...

value='/root/models/internlm2-chat-7b'

# 其他代码...输入运行命令 - 点开 6006 链接后,大约需要 5 分钟完成模型加载:(记得修改路径!)

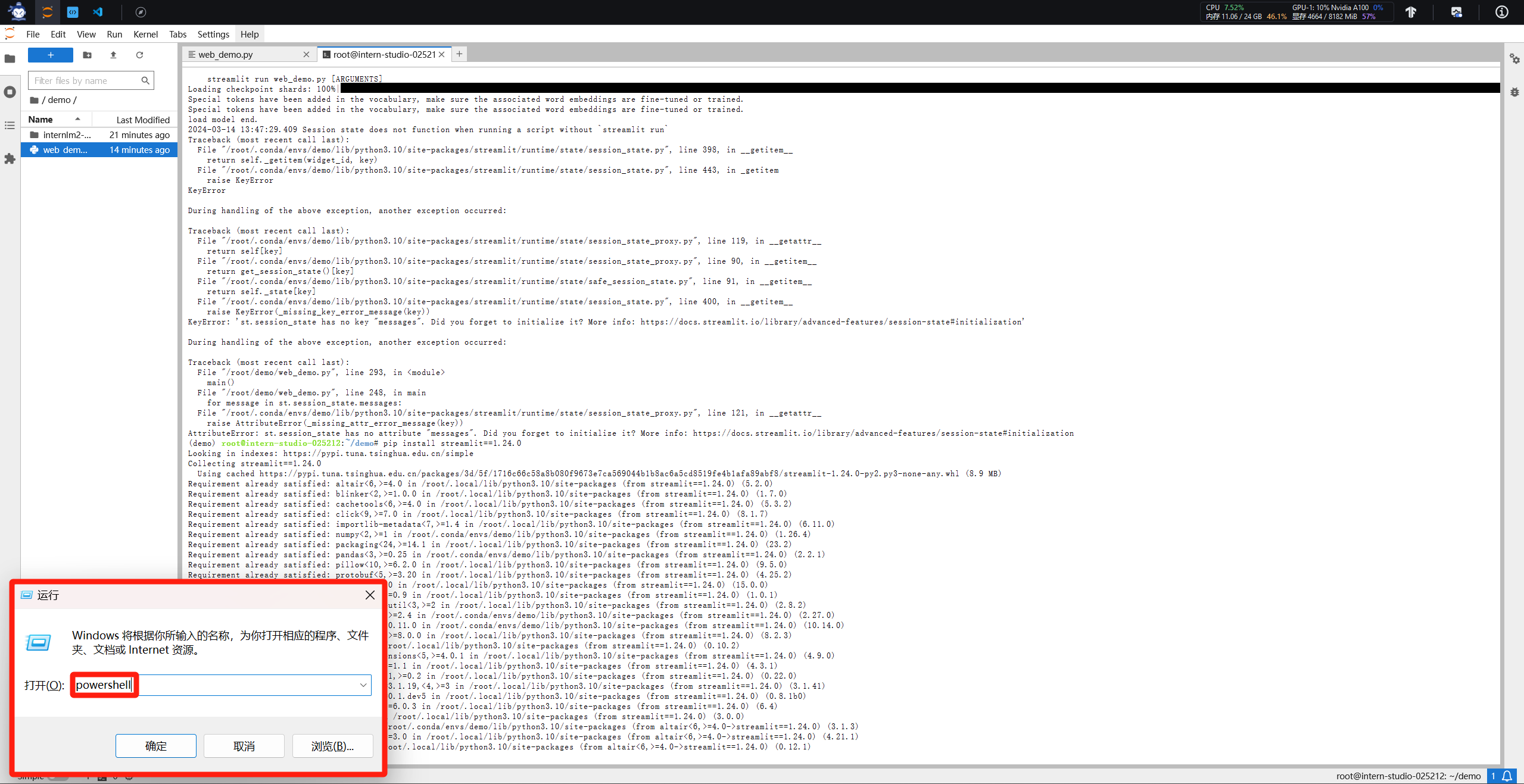

streamlit run /root/demo/lagent/examples/internlm2_agent_web_demo_hf.py --server.address 127.0.0.1 --server.port 6006待程序运行的同时,对本地端口环境配置本地 PowerShell 。使用快捷键组合 Windows + R(Windows 即开始菜单键)打开指令界面,并输入命令,按下回车键。

打开 PowerShell 后,先查询端口,再根据端口键入命令 (例如图中端口示例为 38374):

# 从本地使用 ssh 连接 studio 端口 # 将下方端口号 38374 替换成自己的端口号 ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p 38374

再复制下方的密码,输入到 password 中,直接回车:

最终保持在如下效果即可:

打开 http://127.0.0.1:6006 后,(会有较长的加载时间)勾上数据分析,其他的选项不要选择,进行计算方面的 Demo 对话,即完成本章节实战。键入内容示例:

请解方程 2*X=1360 之中 X 的结果

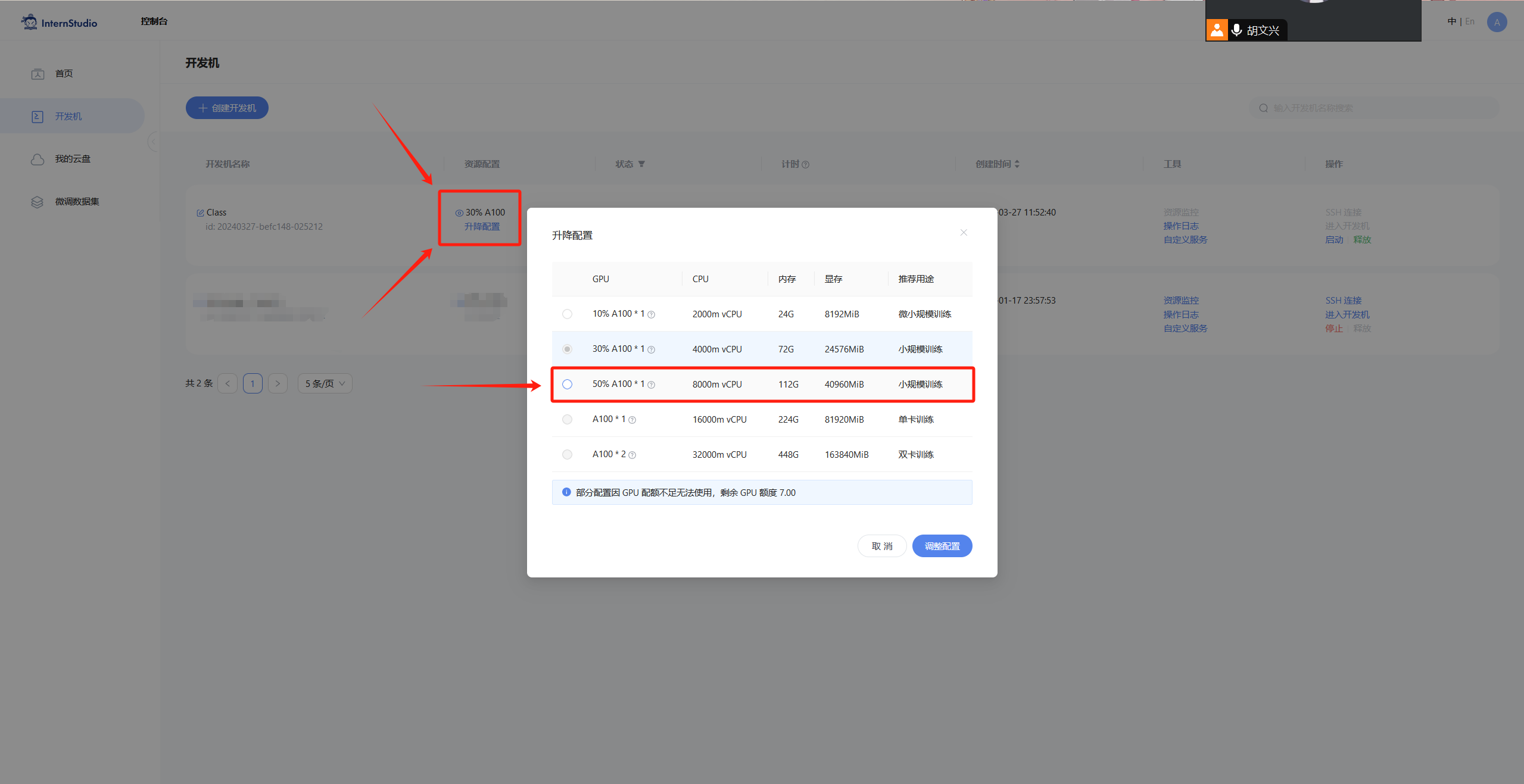

5 实战:实践部署 浦语·灵笔2 模型(开启 50% A100 权限后才可开启此章节)

5.1 初步介绍 XComposer2 相关知识

浦语·灵笔2 是基于 书生·浦语2 大语言模型研发的突破性的图文多模态大模型,具有非凡的图文写作和图像理解能力,在多种应用场景表现出色,总结起来其具有:

- 自由指令输入的图文写作能力:

浦语·灵笔2可以理解自由形式的图文指令输入,包括大纲、文章细节要求、参考图片等,为用户打造图文并貌的专属文章。生成的文章文采斐然,图文相得益彰,提供沉浸式的阅读体验。 - 准确的图文问题解答能力:

浦语·灵笔2具有海量图文知识,可以准确的回复各种图文问答难题,在识别、感知、细节描述、视觉推理等能力上表现惊人。 - 杰出的综合能力:

浦语·灵笔2-7B基于书生·浦语2-7B模型,在13项多模态评测中大幅领先同量级多模态模型,在其中6项评测中超过GPT-4V和Gemini Pro。

5.2 配置基础环境(开启 50% A100 权限后才可开启此章节)

选用 50% A100 进行开发:

进入开发机,经典先创建虚拟环境:

然后在创建的虚拟环境下安装需要的库:

conda activate demo

# 补充环境包

pip install timm==0.4.12 sentencepiece==0.1.99 markdown2==2.4.10 xlsxwriter==3.1.2 gradio==4.13.0 modelscope==1.9.5然后用git的clone在自己定义的文件目录下面下载 InternLM-XComposer 仓库 相关的代码资源:

cd /root/demo

git clone https://gitee.com/internlm/InternLM-XComposer.git

# git clone https://github.com/internlm/InternLM-XComposer.git

cd /root/demo/InternLM-XComposer

git checkout f31220eddca2cf6246ee2ddf8e375a40457ff626在 terminal 中输入指令,构造软链接快捷访问方式:

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-7b /root/models/internlm-xcomposer2-7b

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-vl-7b /root/models/internlm-xcomposer2-vl-7b5.3 图文写作实战(开启 50% A100 权限后才可开启此章节)

继续输入指令,用于启动 InternLM-XComposer:

cd /root/demo/InternLM-XComposer #打开文件路径

python /root/demo/InternLM-XComposer/examples/gradio_demo_composition.py \ #.py文件目录

--code_path /root/models/internlm-xcomposer2-7b \ #模型保存路径

--private \

--num_gpus 1 \ #GPU数量

--port 6006 #端口待程序运行的同时,参考章节 3.3 部分对端口环境配置本地 PowerShell 。使用快捷键组合 Windows + R(Windows 即开始菜单键)打开指令界面,(Mac 用户打开终端即可)并输入命令,按下回车键:

打开 PowerShell 后,先查询端口,再根据端口键入命令 (例如图中端口示例为 38374):

# 从本地使用 ssh 连接 studio 端口 # 将下方端口号 38374 替换成自己的端口号 ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p 38374

再复制下方的密码,输入到 password 中,直接回车:

最终保持在如下效果即可:

打开 http://127.0.0.1:6006 实践效果即可。

5.4 图片理解实战(开启 50% A100 权限后才可开启此章节)

根据附录 6.4 的方法,关闭并重新启动一个新的 terminal,继续输入指令,启动 InternLM-XComposer2-vl:

还是一样的操作

创建虚拟环境,然后打开文件路径,终端处写入启动代码:

conda activate democd /root/demo/InternLM-XComposer

python /root/demo/InternLM-XComposer/examples/gradio_demo_chat.py \

--code_path /root/models/internlm-xcomposer2-vl-7b \

--private \

--num_gpus 1 \

--port 6006打开 http://127.0.0.1:6006 (上传图片后) 键入内容示例如下:

请分析一下图中内容

下面就会出来图中内容的分析

322

322

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?