为何在对鸢尾花进行分类时,输出层的数据不需要经过激活?

首先,下图展示了我上一篇文章中,鸢尾花分类模型构建部分的原始代码:

可以看到在神经网络的最后一层的输出数据outputs没有进行sigmoid函数激活

在之前的前馈神经网络任务中,只要是经过神经网络的隐藏层和输出层,都遵循着先进行WX+b运算,再进行函数激活的步骤。然而鸢尾花分类的实验中并没有在输出层对数据进行激活,这是为何?我在文心一言中进行了查询:

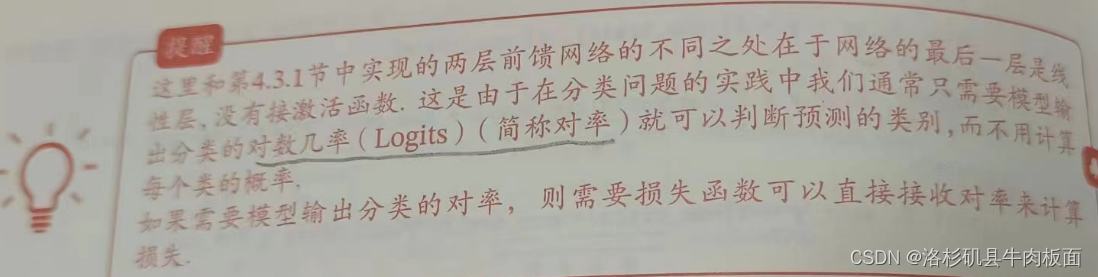

得到了这样的答复后,并没有消除我根本的疑惑,于是询问了老师,老师把书上的内容展示给我:

意思为:鸢尾花分类的神经网络中的输出层是线性层,没有接激活函数,这是因为在实践中我们只需要模型输出分类的对数几率(Logits)就足够用来进行预测类别的判断了,不需要再计算每个类的概率。 如果需要模型输出分类的对率,则需要损失函数可以直接接收对率来计算损失。

(看完之后还是云里雾里的,因为对Logits的认知不够深刻。接下来的文章我会总结sigmoid、logits、softmax和logistic的区别与联系,这几个概念放在一起给我造成了混淆。)

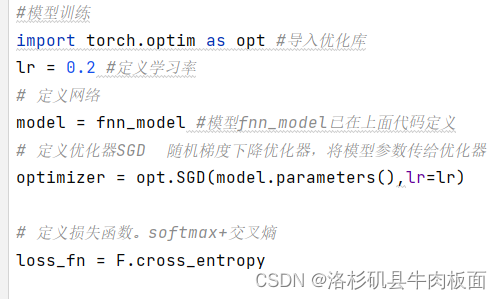

检查了我的代码后,发现在模型训练中使用了torch.nn.funtional包中的cross_entroy函数:

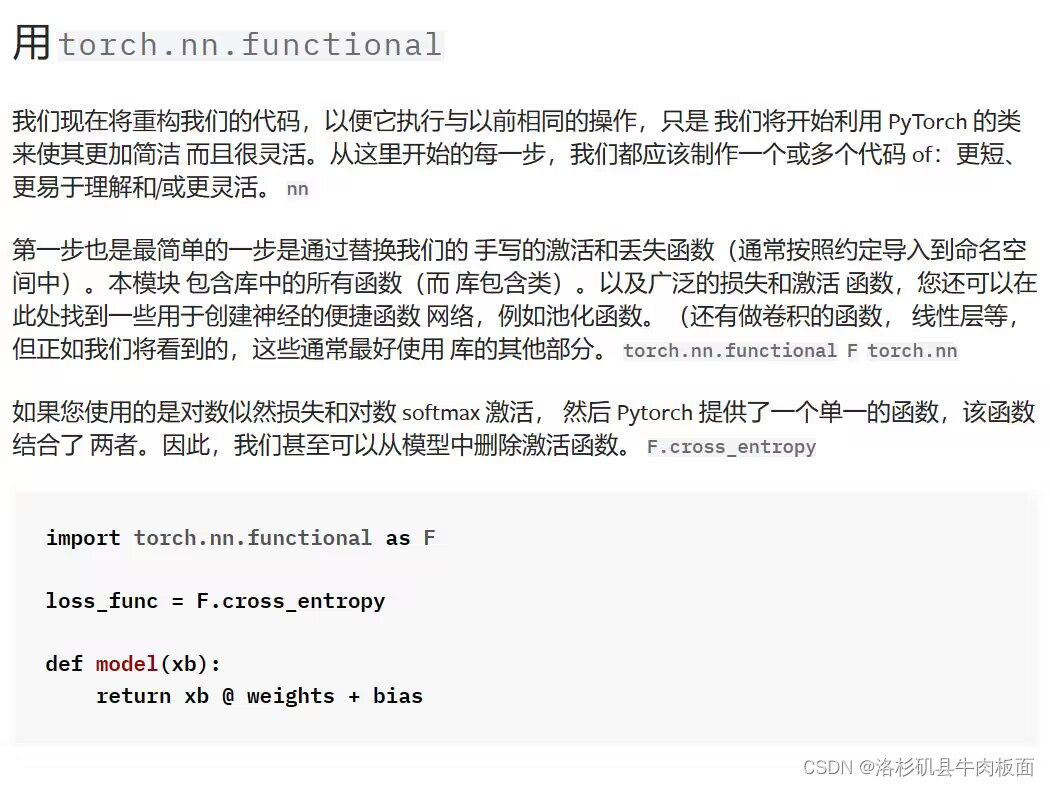

之后在pytorch官网上,找到了torch.nn.functional的用法介绍:

同时文心一言也给出了torch.nn.functional的介绍:

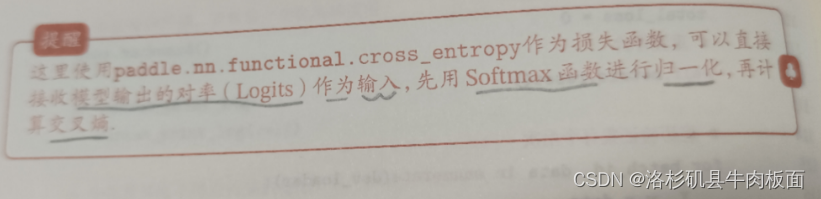

书中给出的介绍:(书中给的是paddle版本,可以对应理解torch版本)

总结来讲,就是torch.nn.functional.cross_entropy函数自带了激活这一步。模型的输出是概率分布值,torch.nn.funtional.cross_entropy会接收模型的输出(概率分布),之后自动对这个输出进行激活。 所以在模型构件中不需要对输出层再进行激活操作了。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?