第一部分:基本信息

-

会议/时间:NeurIPS 2024(明确发表于 2024 年底)

-

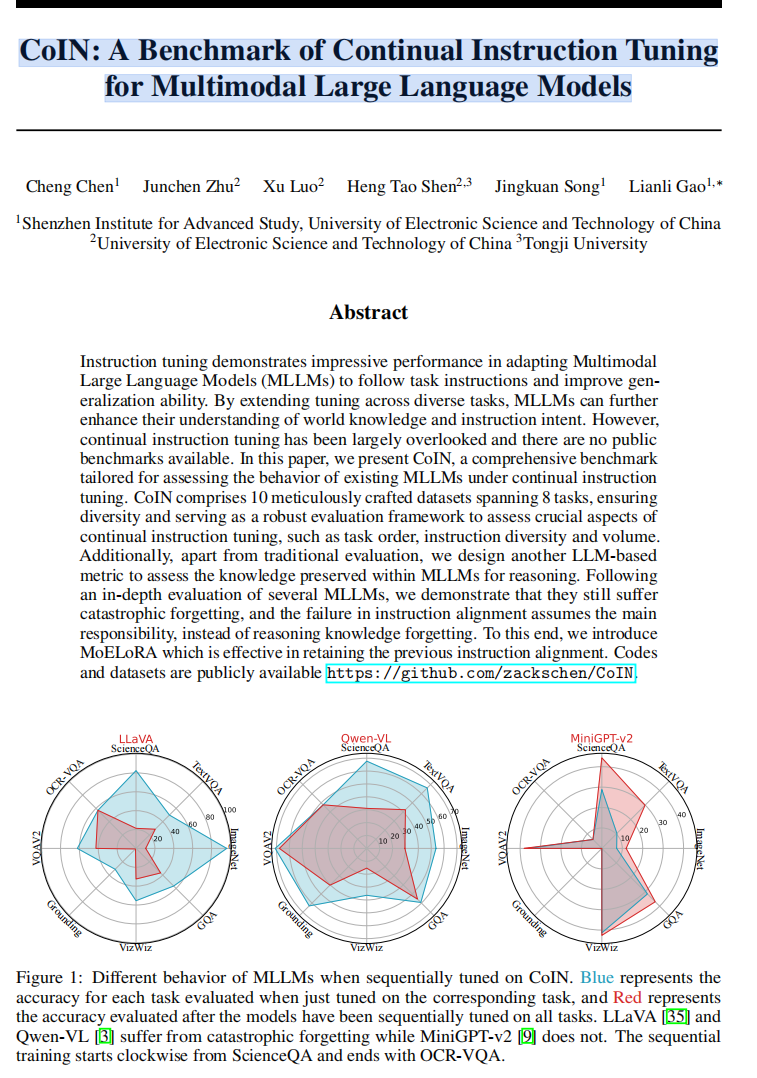

主题:提出多模态大模型(MLLMs)的持续指令微调基准,关注灾难性遗忘与任务顺序影响。

-

地位:这是四篇中最早的,奠定了 MLLM 训练过程分析的基础,尤其是 LoRA 的持续学习问题。

第二部分:解决的问题

(1)主要问题

-

没有适用于多模态大模型的“持续指令微调”基准

现有工作要么只研究纯文本 LLM,要么只在单一任务(比如分类)上分析 MLLM(多模态大预言模型) 的遗忘现象,缺乏一个覆盖多种视觉任务、可系统分析灾难性遗忘 的公共 基准(测试 / 数据集)。 -

在本文中,我们提出 CoIN—— 一个专为评估现有 MLLMs 在持续指令微调下</

订阅专栏 解锁全文

订阅专栏 解锁全文

8753

8753

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?