有多张GPU情况下选择指定部分GPU使用

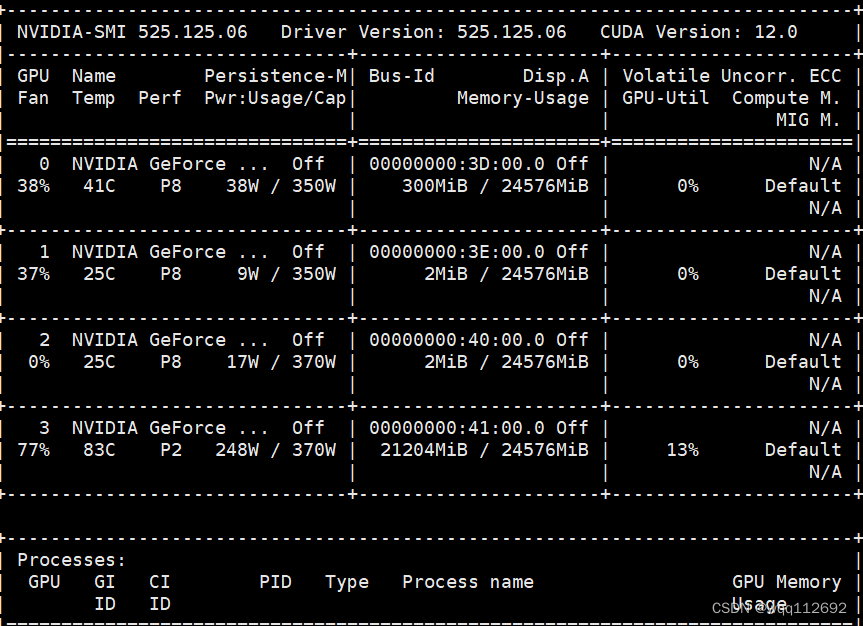

很多服务器在进行配备时会装配多块GPU,那么我们在使用服务器时,我们需要在指定的GPU上运行我们的程序。比如我们的服务器上有4张GPU,使用命令:

nvidia-smi

即可查看服务器上的GPU信息

比如,当我想在第4张显卡上运行程序时,可以使用一下代码:(显卡索引默认从0开始)

torch.cuda.set_device(3)

device = torch.cuda.current_device()

print(f"当前代码在第{device}张显卡上运行。")

此时,程序就是在第4张GPU上运行,并且在终端就会输出

![]()

本文介绍了如何在服务器上通过nvidia-smi监控GPU状态,并使用torch库设置设备,确保程序在指定GPU上执行。

本文介绍了如何在服务器上通过nvidia-smi监控GPU状态,并使用torch库设置设备,确保程序在指定GPU上执行。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?