目录

(一)使用 `InternLM2-Chat-1.8B` 模型生成 300 字的小故事

(一)熟悉 `huggingface` 下载功能,使用 `huggingface_hub` python 包,下载 `InternLM2-Chat-7B` 的 `config.json` 文件到本地

(二)完成 `浦语·灵笔2` 的 `图文创作` 及 `视觉问答` 部署

(三)完成 `Lagent` 工具调用 `数据分析` Demo 部署

一、基础作业

(一)使用 `InternLM2-Chat-1.8B` 模型生成 300 字的小故事

效果如下:

二、进阶作业

(一)熟悉 `huggingface` 下载功能,使用 `huggingface_hub` python 包,下载 `InternLM2-Chat-7B` 的 `config.json` 文件到本地

首先安装依赖

pip install -U huggingface_hub然后建立文件,而后在文件中写入以下代码:

import os

from huggingface_hub import hf_hub_download # Load model directly

hf_hub_download(repo_id="internlm/internlm2-7b", filename="config.json")执行命令,结果如下:

![]()

(二)完成 `浦语·灵笔2` 的 `图文创作` 及 `视觉问答` 部署

1、图文创作

实践效果如下图所示:

可以看出根据示例的内容,输出还是不错的。

但是加载较慢,我大约是加载了90多秒。效果良好。

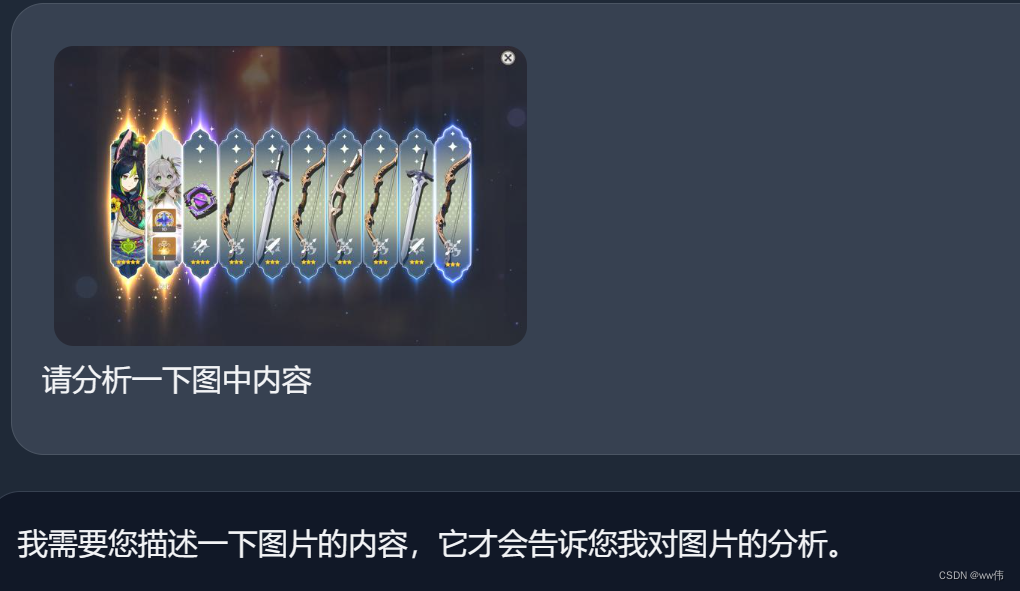

2、视觉问答

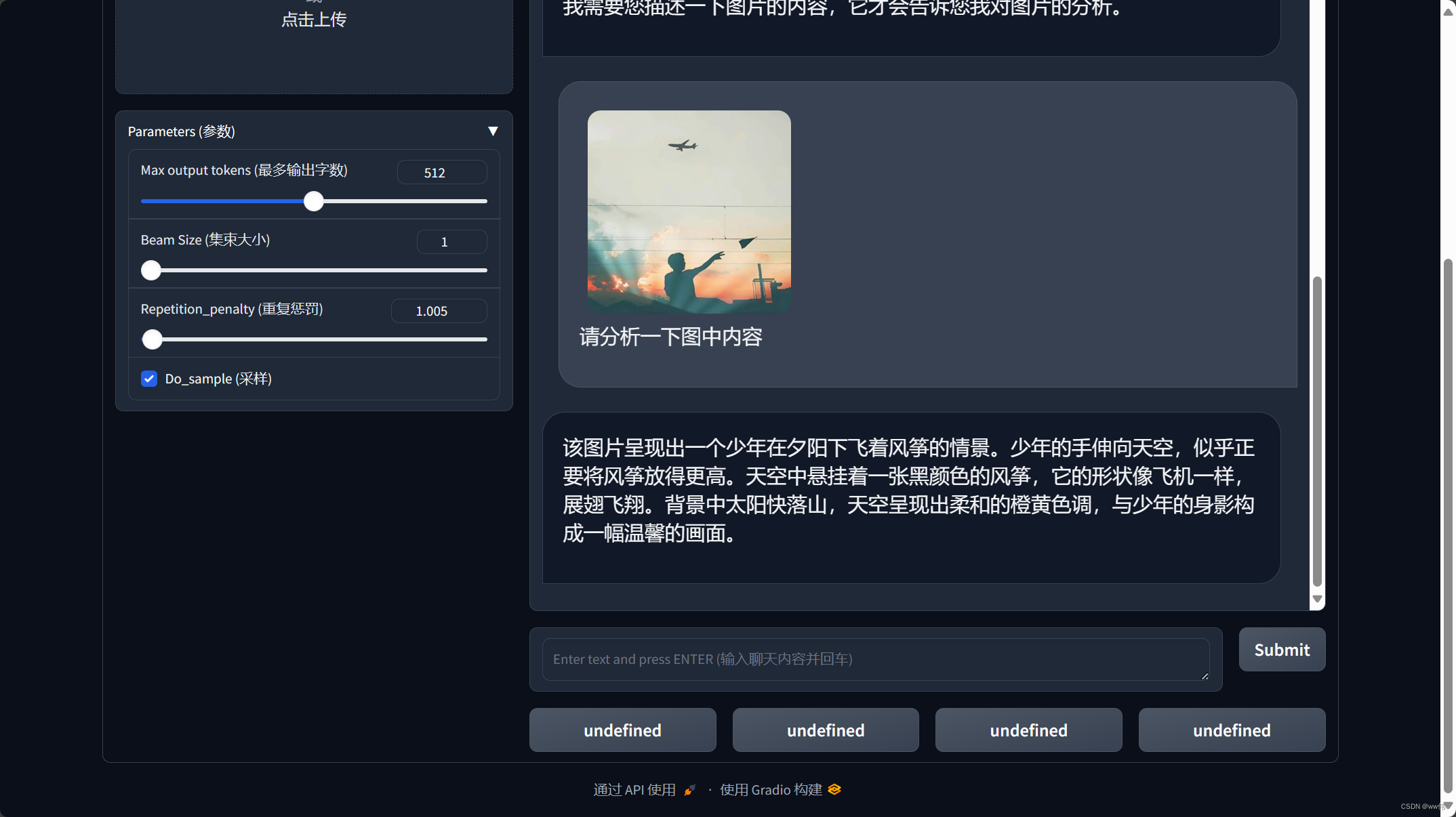

实践效果如下图所示:

(1)刚开始时

可能模型刚开始运行,反应较慢,没有显示。

(2)上传第二张图片,显示如下

可以看出描写还是很详细的,而且较为准确。

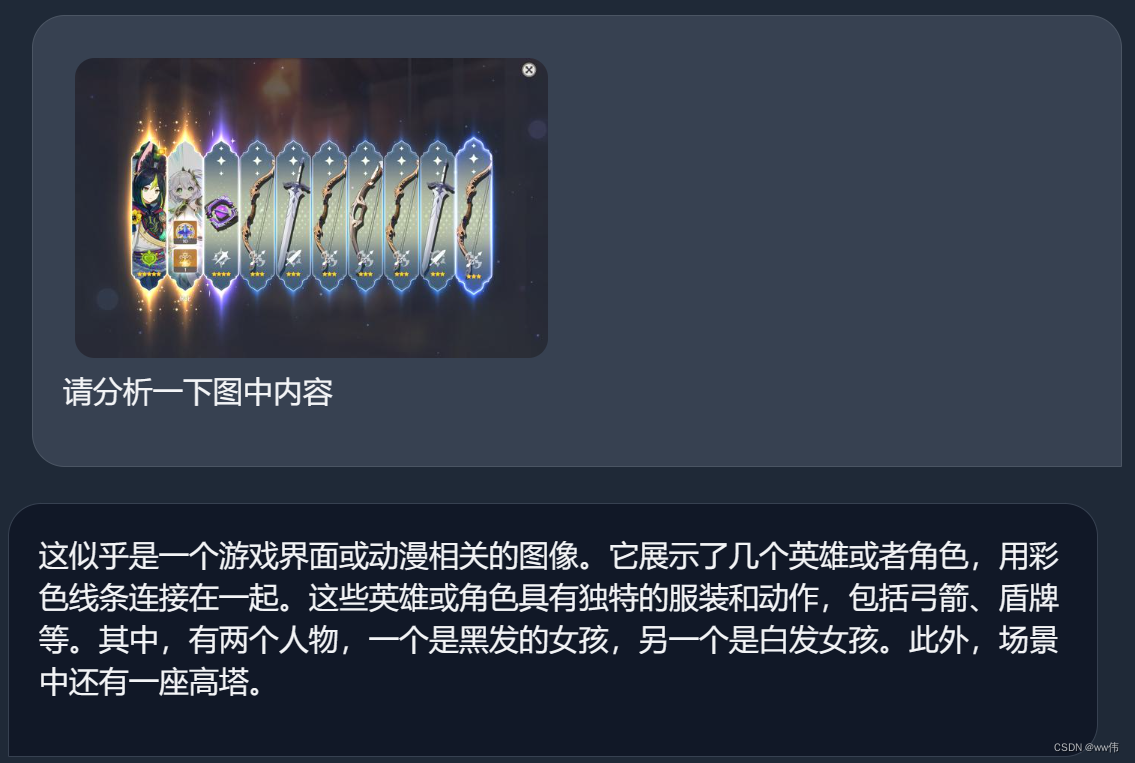

(3)再次上传上面的图片

描述的还是可以的,嗯,对应较好。

小提,大模型认证的女孩,哈哈哈。

(三)完成 `Lagent` 工具调用 `数据分析` Demo 部署

请解方程 2*X=1360 之中 X 的结果结果如下(勾选“数据分析”):

877

877

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?