引言

今天介绍论文BGE,是智源开源的语义向量模型,BAAI General Embedding。

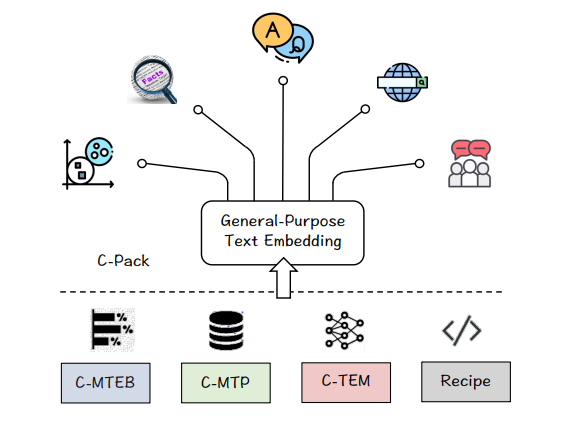

作者发布了C-Pack,一套显著推进中文嵌入领域的资源包。包括三个重要资源: 1) C-MTEB是一个全面的中文文本嵌入基准,涵盖了6个任务和35个数据集。 2) C-MTP是一个从标记和未标记的中文语料库中选择的大规模文本嵌入数据集。 3) C-TEM是一个覆盖多种规模的嵌入模型系列。

作者提出的BGE在C-MTEB上的表现超过了先前所有的中文文本嵌入模型,还整合和优化了C-TEM的整套训练方法。

总体介绍

文本嵌入是NLP中一个长期的主题。广泛的应用场景需要一个统一的嵌入模型,能在任何应用场景下处理各种任务。比如,问答、语言建模、对话等。然而,学习通用文本嵌入比任务专一的文本嵌入具有更多的挑战,在于:

- 数据 开发通用领域文本嵌入

本文介绍了BGE,一个由智源开源的中文语义向量模型,以及配套的C-Pack资源包,包括中文文本嵌入基准C-MTEB、大规模文本对C-MTP和C-TEM模型系列。C-MTEB包含35个数据集,用于全面评估文本嵌入性能。BGE模型在C-MTEB上的表现超越了现有中文文本嵌入模型,其训练方法结合了预训练、对比学习和任务微调,提升了模型的通用性。

本文介绍了BGE,一个由智源开源的中文语义向量模型,以及配套的C-Pack资源包,包括中文文本嵌入基准C-MTEB、大规模文本对C-MTP和C-TEM模型系列。C-MTEB包含35个数据集,用于全面评估文本嵌入性能。BGE模型在C-MTEB上的表现超越了现有中文文本嵌入模型,其训练方法结合了预训练、对比学习和任务微调,提升了模型的通用性。

订阅专栏 解锁全文

订阅专栏 解锁全文

1793

1793

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?