23年12月中科院自动化所、中科大和自动化所南京AI研究机构的论文“Large Language Models Play StarCraft II: Benchmarks and A Chain of Summarization Approach”。

以往Alphabstar和SCC,在《星际争霸II》长期战略规划和可解释性存在不足。首先开发文本StratCraft II环境,称为TextStarCraft II,LLM智体可以与之交互。其次,一种摘要链方法,包括用于处理原始观测的单帧摘要和用于分析游戏信息、提供命令建议和生成战略决策的多帧摘要。

实验包括两部分:1 人类专家评估LLM对《星际争霸II》知识的掌握程度和LLM智体在游戏中的表现;2 LLM智体的游戏内性能,包括胜率和摘要链等。实验结果表明:1 LLM具备应对《星际争霸II》场景所需的相关知识和复杂规划能力;2 LLM智体表现接近于《星际争霸II》八年经验的玩家;3 LLM智体在更高(5级)的难度击败内置的AI。

代码 https://github.com/histmeisah/Large-Language-Models-play-StarCraftII/tree/main

CoT增强语言模型的推理和逻辑能力,使语言智体能够在自然语言描述的环境中展示战略可解释性和长期规划优势,这有利于玩《星际争霸II》的语言智体。星际争霸II中决策涉及处理复杂的信息, 需要彻底的长期的规划和模仿对手策略。

最初CoT方法及其改进在应用于TextStarCraft II时遇到三个主要问题:1 无法理解《星际争霸II》中复杂多变信息,2 未能分析《星际争霸II》的趋势和游戏动态,3 无法根据当前游戏状态提供有用的建议和决策。为了应对这些挑战,引入摘要链(CoS)方法,旨在增强LLM 智体提取和分析信息做出综合决策的能力。

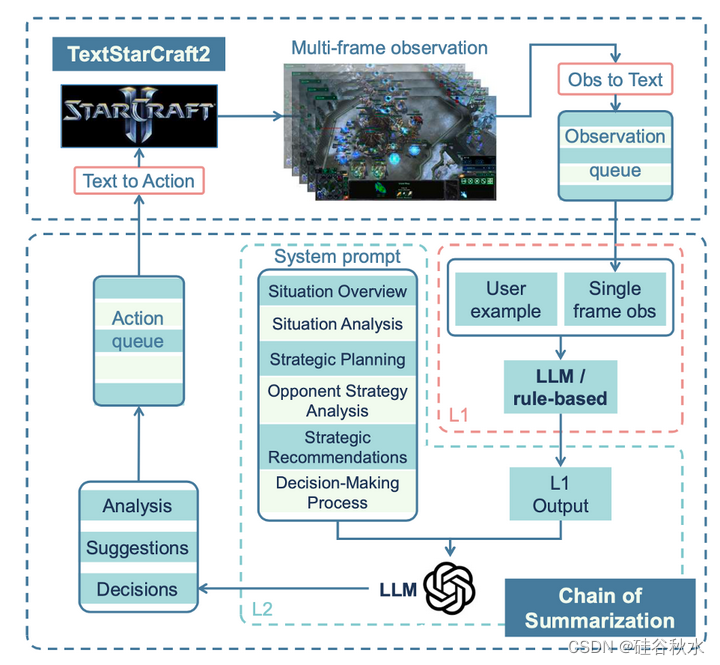

CoS方法由两个核心模块组成:1)单帧摘要,从原始数据中提取关键信息,帮助LLM智体快速掌握游戏的当前状态。2)多帧摘要,处理关键信息的几个步骤,使LLM智体快速分析正在进行的游戏情况,提供应对策略,并做出明智的决定。

如图所示是与LLM交互:TextStarCraft II中的增强摘要链方法(Enhanced Chain of Summarization Method)。该方法是一种LLM驱动的战略游戏简化,初始化之后,将游戏的初始数据转换为文本,然后排队进行处理。接下来是单帧和多帧摘要( Single-Frame and Multi-Frame Summarization),通过高级LLM推理将观察结果提炼并总结为可操作的见解。命令制定和动作规划(Directive Formulation and Action Scheduling)阶段将见解划分为具体动作,把行动队列迁移成后续动作。最后,动作检索和执行(Action Retrieval and Execution)在游戏中实现这些动作,将新数据转换为文本以进行连续交互来结束闭环。在TextStarCraft II复杂的战略环境中这种循环过程提高了LLM的性能。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?