tensorflow中softmax激活函数

引用API:tensorlfow.nn.softmax(x)

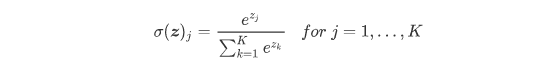

softmax激活函数

对全连接网络进行变换,使其符合概率分布,每个值都在[0,1]区间,且值得和为1.

softmax激活函数可以用在神经网络最后一层网络中,适用于多分类问题。而sigmod、tanh、Relu、Leaky Relu只能处理二分类问题。

引用API:tensorlfow.nn.softmax(x)

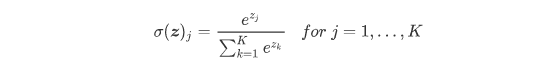

softmax激活函数

对全连接网络进行变换,使其符合概率分布,每个值都在[0,1]区间,且值得和为1.

softmax激活函数可以用在神经网络最后一层网络中,适用于多分类问题。而sigmod、tanh、Relu、Leaky Relu只能处理二分类问题。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?