Transformer学习(1)

记录一下我的预训练语言模型学习

之前虽然看论文里面用得很多transformer模型、预训练语言模型等,但是我一直没有系统的学习过。

今天学习的是transformer的一些基础操作,参考的博客如下:

https://zhuanlan.zhihu.com/p/448852278

我的疑惑有:

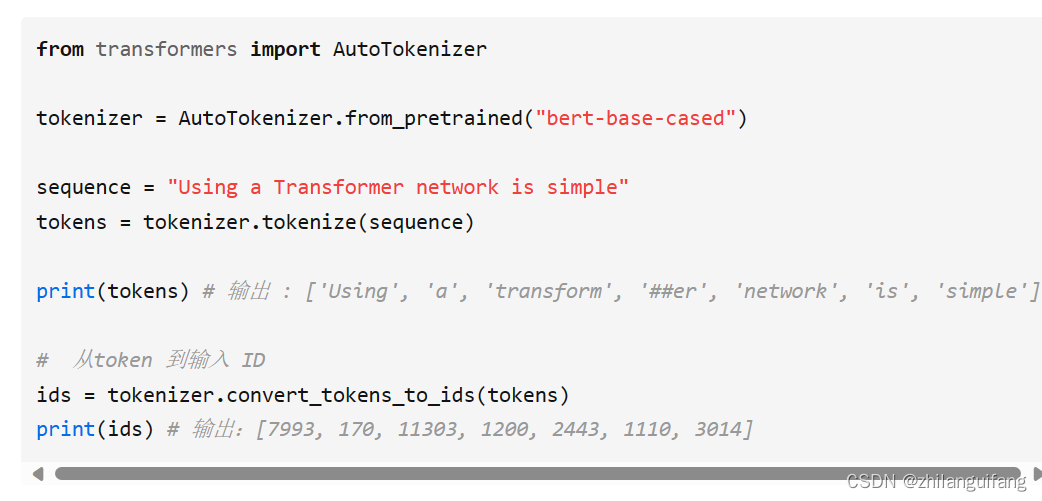

1. AutoTokenizer和那个BertTokernizer的区别是什么??

目前看到的AutoTokenizer是对话语进行分词,是真的分为一个个自然语言里面的词,若要进行后续操作,需要调用相应的函数。

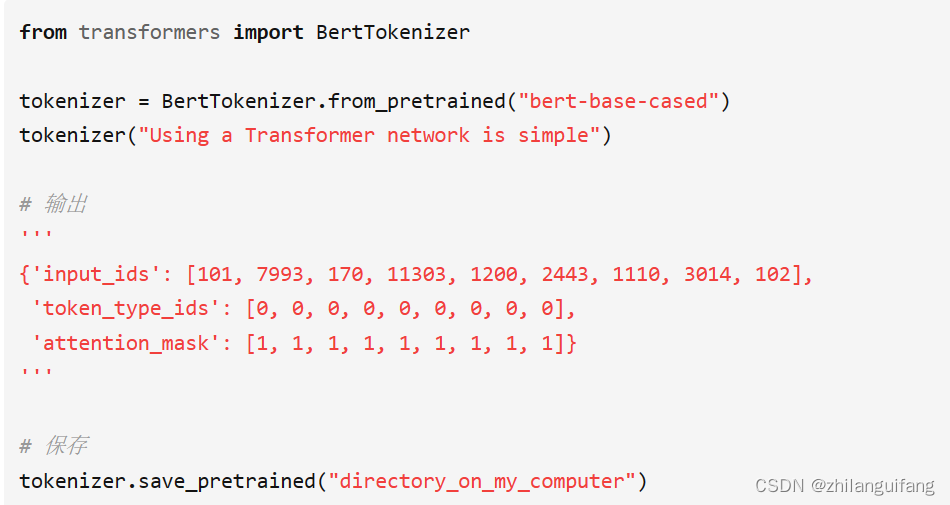

而BertTokernizer直接一步将话语转成id,还有对应的句子号码(token_type_ids)、是否是填充的token(attention_mask)

2.transformer是一个模型还是一类模型

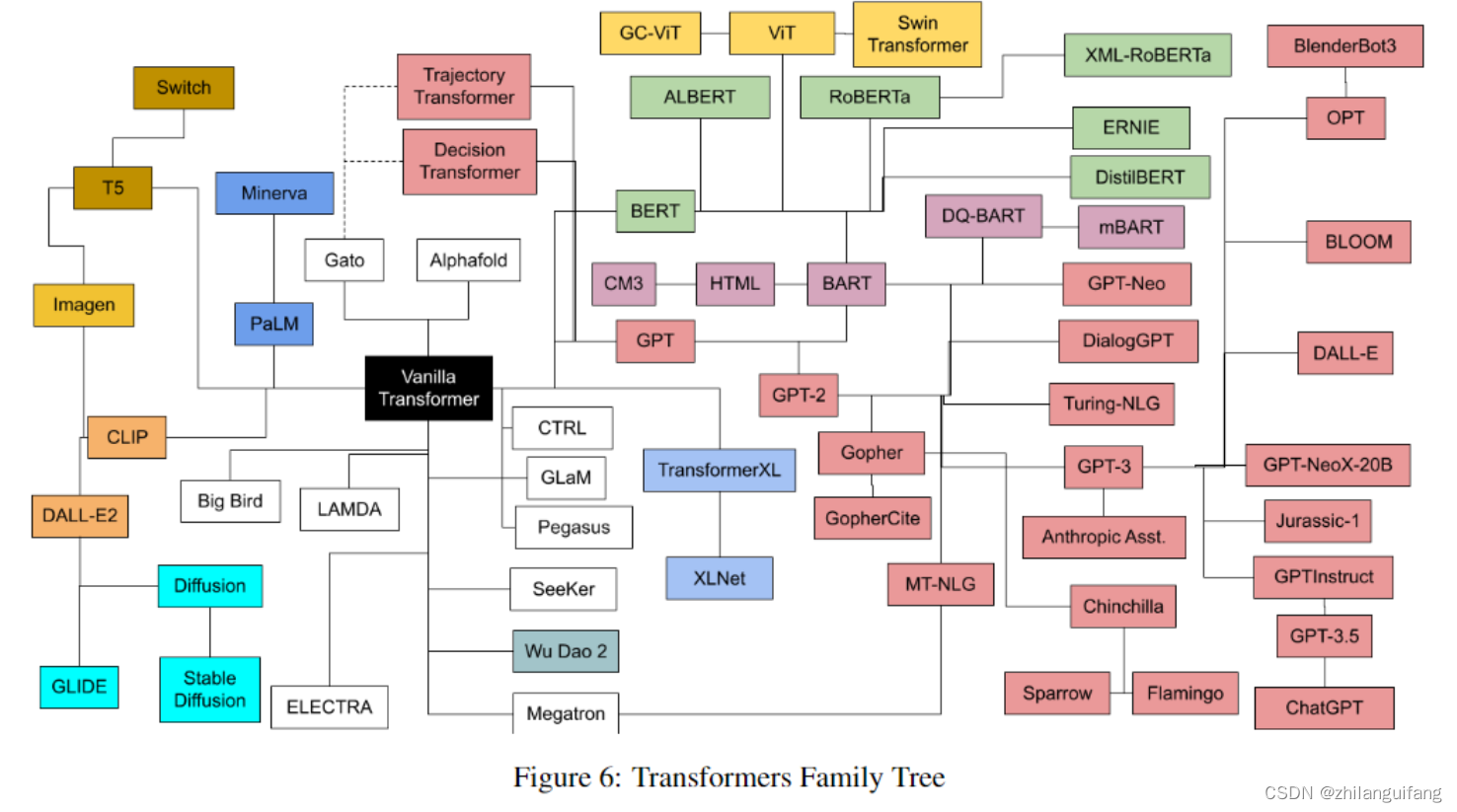

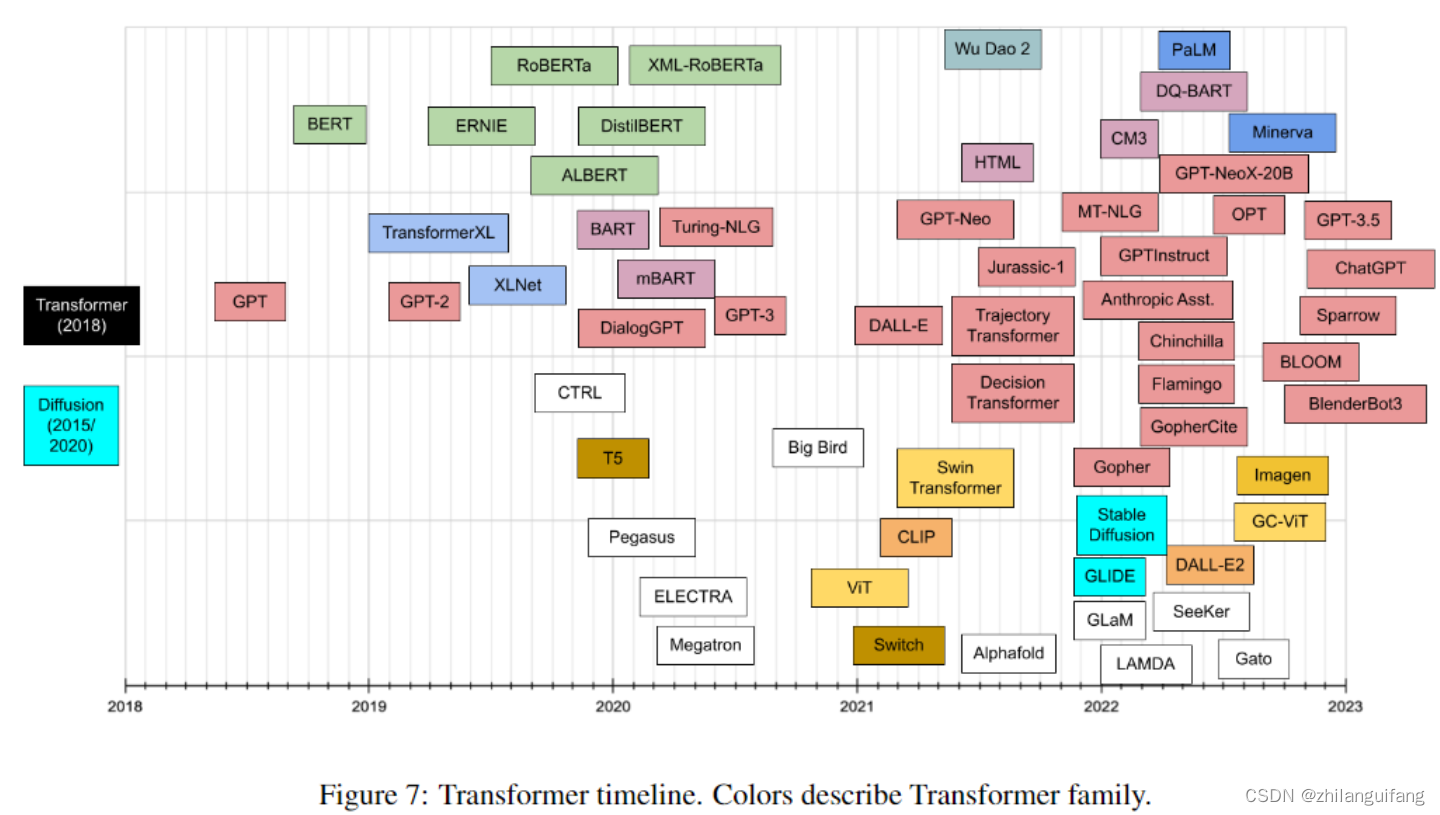

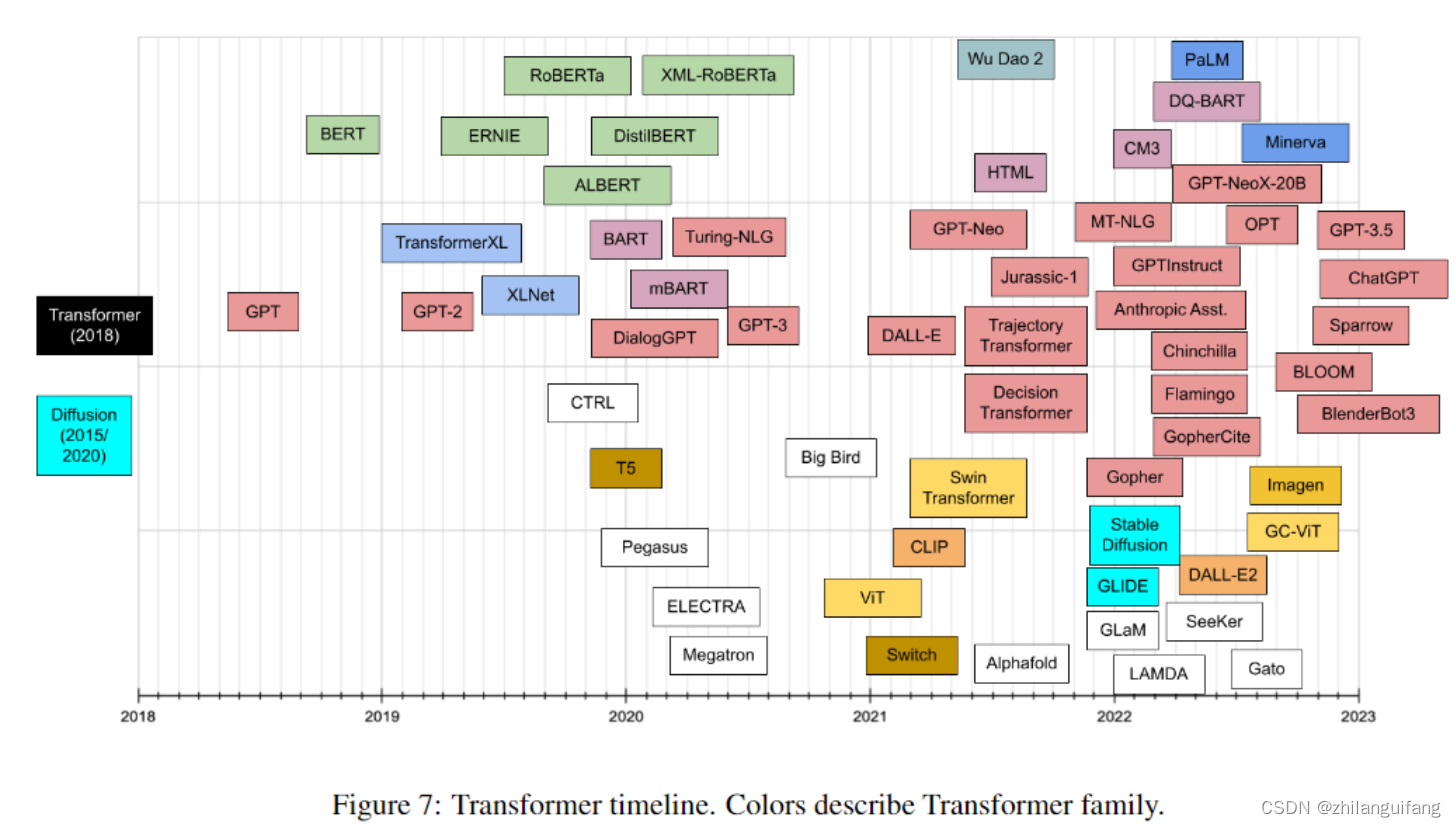

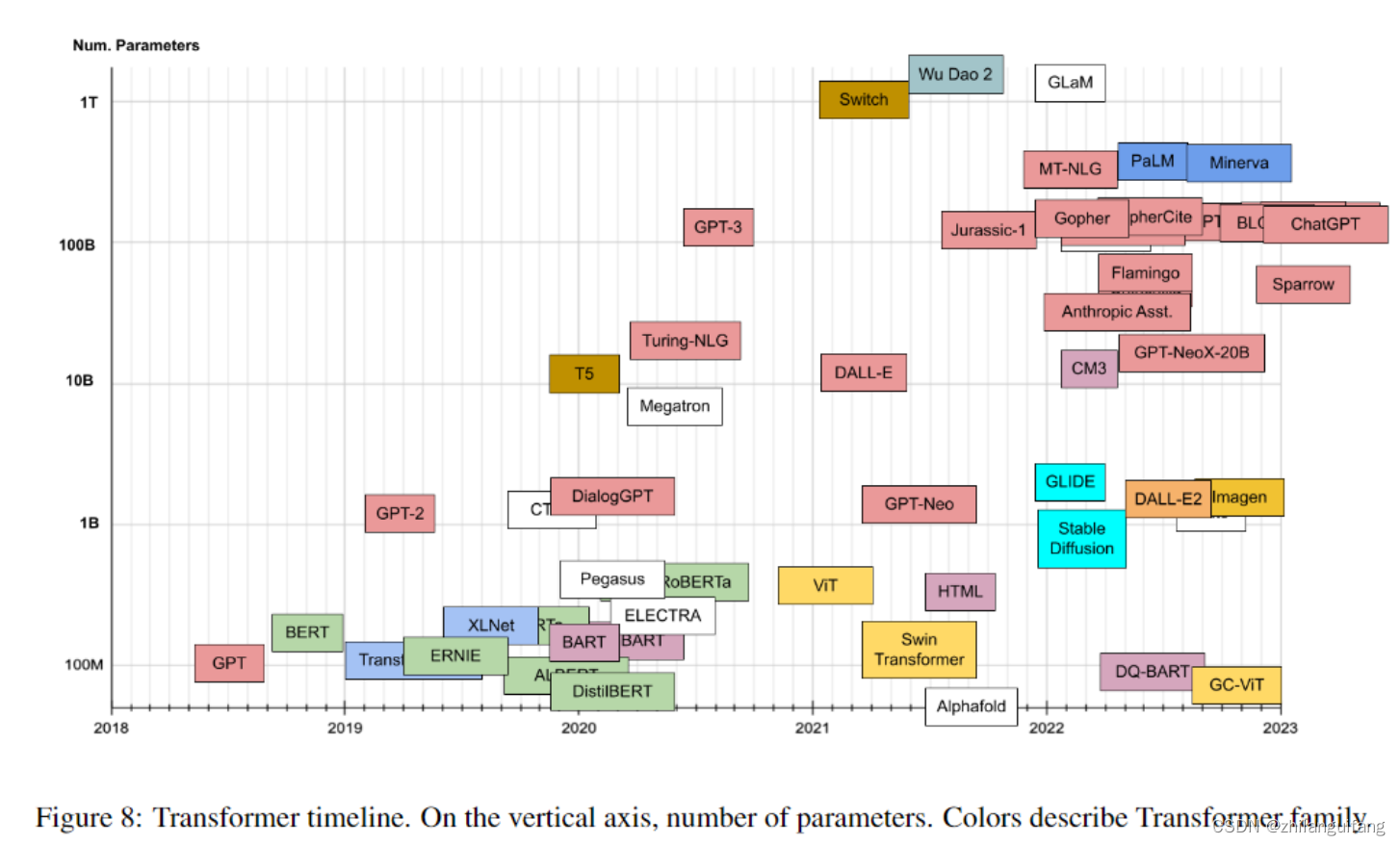

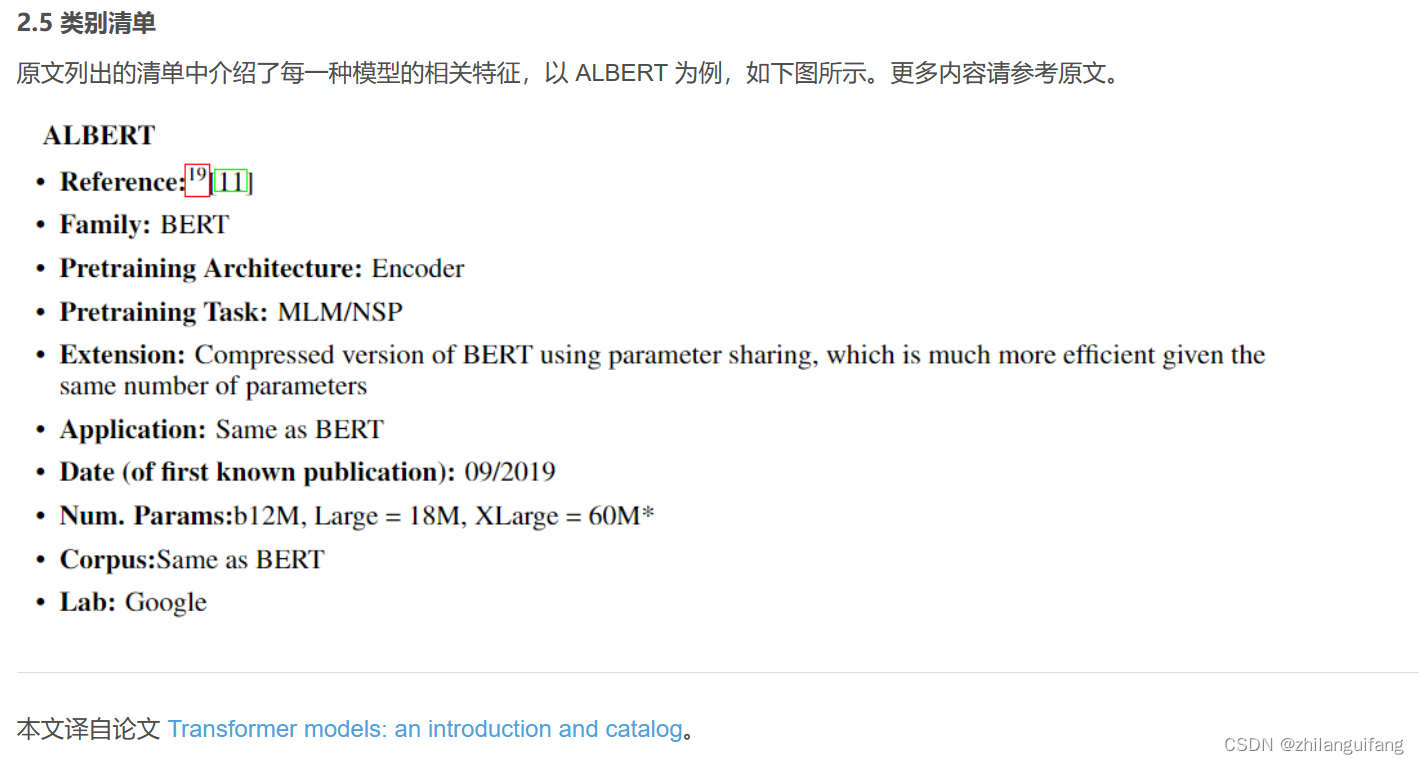

其实我之前一直以为transformer是指具体的一个模型,但是今天在网上查看资料的时候才发现,transformer既可以指具体的一个模型(2017年谷歌的那个模型),也可以指一类具有某些特征架构的深度学习模型。参考博客(下面的图也是从该博客截的)

https://blog.csdn.net/be_racle/article/details/129103851

原论文链接:https://arxiv.org/abs/2302.07730

174

174

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?