论文题目(Title):A Multi-task Learning Model for Chinese-oriented Aspect Polarity Classification and Aspect Term Extraction

(面向中文的方面极性分类和方面项提取的多任务学习模型)

研究问题(Question):面向中文的方面级情绪分析的多任务学习模型(LCF-ATEPC),该模型能够同时进行aspect term extraction(ATE)和aspect polarity classification(APC)两个子任务,能够同时对中英文评论进行分析,该模型集成了自适应领域的BERT模型

研究动机(Motivation):现有的工作大多集中在方面项极性推断子任务上,而忽略了方面项提取的意义。此外,现有的研究也没有关注面向中文的ABSA任务的研究。

主要贡献(Contribution):

1.首次研究了面向多语种评论的结合APC子任务和ATE子任务的多任务模型,为中文方面项提取的研究提供了一种新的思路。

2.第一次将self-attention和局部语境聚焦技术应用到APC中,充分挖掘他们在APC中的潜力。

3.分别设计并应用了双标签输入序列(方面术语标签和情感极性标签),分别适用于ABSA联合任务的SemEval-2014和中文评论数据集。 双重标记提高了模型的学习效率。

4.LCF-ATEPC集成了预训练的bert模型。

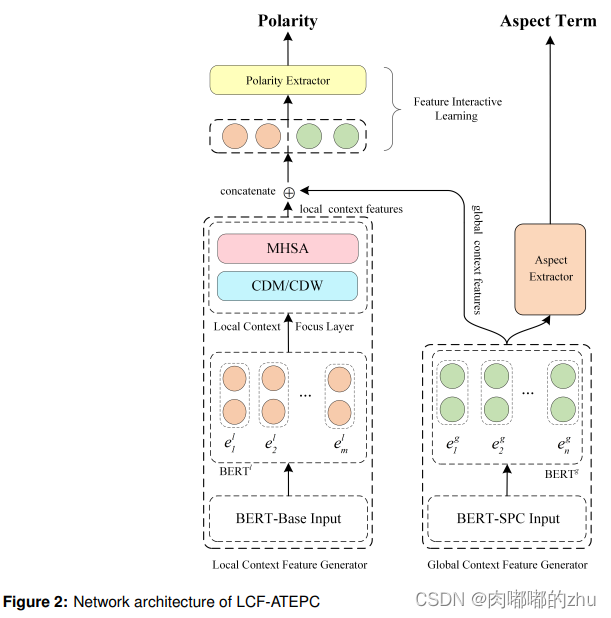

研究思路(Idea):该模型基于多头自我注意模型(MHSA),集成了预先训练好的BERT Devlin、Chang、Lee和Toutanova模型(2019)和地方背景聚焦机制,即LCF-ATEPC。通过对少量的方面及其极性标注数据进行训练,该模型可以适应大规模数据集,自动提取方面和预测情感极性。通过这种方式,模型可以发现未知的方面,避免了手动注释所有方面和极性的繁琐和巨大成本。

研究方法(Method):

研究过程(Process):

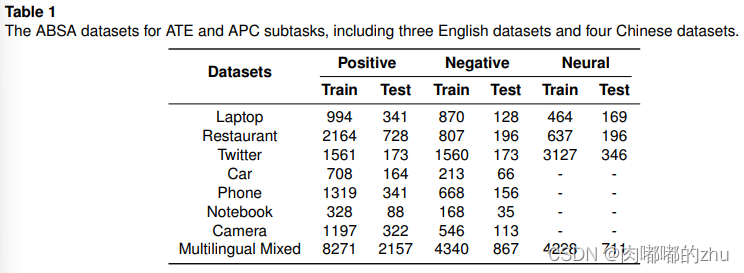

1.数据集(Dataset)

2.评估指标(Evaluation)

F1,Accuracy

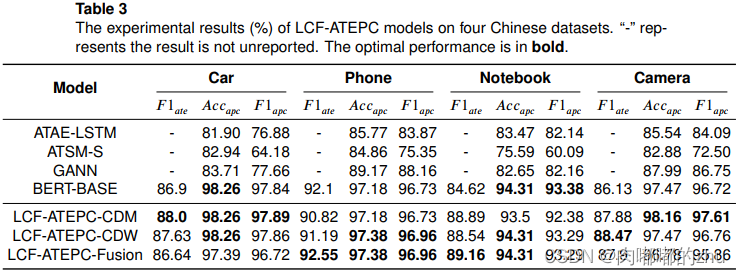

3.实验结果(Result)

总结(Conclusion):在以往的研究中,ATE子任务和APC子任务被视为独立的任务。此外,ATE和APC子任务的多任务学习模型还没有引起足够的重视。此外,面向汉语的ABSA任务的研究还不够充分,亟待提出和开展。针对上述问题,文章提出了基于MHSA和LCF机制的基于方面情感分析的多任务学习模型LCF- atepc,并首次将预先训练好的BERT应用于ATE子任务。文章提出的模型不仅适用于汉语,而且具有多语言性和适用性。该模型可以自动从评论中提取方面,并推断方面的极性。在ABSA任务的3个常用英文数据集和4个中文回顾数据集上的实证结果表明,与所有基于基本BERT的模型相比,LCF-ATEPC模型在ATE和APC任务上取得了最先进的性能。

516

516

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?