|文章信息

本论文于2023年发表于期刊《Information Sciences》。该论文旨在研究一定区域范围内多模式交通系统短时客流预测问题,文章提出一种基于多任务学习的预测模型实现区域级多模式交通短时客流预测,分别预测不同交通模式的未来进站客流。所提出的模型在北京真实数据集上进行测试,通过选择西直门和望京两个区域的数据集进行验证。进行了多项实验分析协同预测不同交通方式的优势以及不同交通方式客流数据之间的时空交互关系。

关键词:多模式交通系统、短时客流预测、多任务学习、Transformer、深度学习

|摘要

由于乘客出行需求日益多样化,多交通模式的协同管理正变得日益重要。多交通模式的短时客流预测可为多模式交通系统的高效管理提供有力支撑。然而,该任务面临诸多挑战,因为多交通模式具有高度复杂的时空特征,并且不同交通模式的客流呈现出显著的差异性与波动性。为应对上述问题,本文提出了一种基于多任务学习的短时进站客流预测模型——Res-Transformer。该模型包括两个主要部分:(1)改进的Transformer层,融合了卷积Transformer层与多头注意力机制,以提取多交通模式的时空特征;(2)引入残差网络结构,用于捕捉多交通模式间的相关性,并有效缓解梯度消失与梯度爆炸问题。本文在中国北京的两个大规模真实数据集上对所提出模型进行验证,其中一个数据集来自交通枢纽,另一个来自居民区。实验结果不仅证明了Res-Transformer在预测任务中的有效性与鲁棒性,还验证了多交通模式联合建模的显著优势。本文的研究为多交通模式短时进站客流预测提供了关键性的理论与实践参考。

|问题定义

本文旨在利用选定区域内多交通模式系统的历史客流数据,预测下一时间段该系统的进站客流。具体而言,定义1描述了各交通模式的客流情况,并展示了如何提取特定交通模式客流的示例。在定义1的基础上,定义2进一步描述了多交通模式系统中历史进站客流数据的结构,随后给出了问题定义。基于这些定义,本文明确了多交通模式系统短时客流预测的研究内容。

定义1(交通模式的客流):对于交通模式i,在选定区域内包含若干车站或区域单元,作为乘客出发或到达的基本单位。该交通模式的客流可从相应的记录数据中提取,如地铁AFC数据、公交IC卡数据、出租车轨迹数据等。根据选定的时间粒度,可以从记录数据中提取每个时间段的客流。对于交通模式i,本文将每个时间段内各单元的客流进行求和,得到该交通模式的历史客流时间序列,记作,其中,表示第t个时间段内交通模式𝑖的总客流,T表示总时间段的长度。若选定区域中仅包含一个单元,则即为该区域在第𝑡时间段的客流。

在实际应用中,本文考虑了地铁、公交和出租车三种交通模式,并选取两个区域进行研究。本文收集每种交通模式的数据,并构建其历史进站客流数据。本研究采用的时间粒度为30分钟,选取的时间范围为地铁的运营时段,即每天早上5:00至晚上23:00,因此每天共划分为36个时间段。

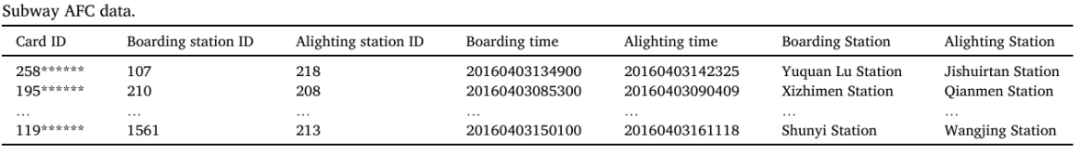

对于地铁而言,本文处理AFC数据,提取选定车站的地铁客流。原始的地铁AFC数据如下表所示,AFC数据记录了每位乘客的出行情况。

进一步,本文基于AFC数据提取与目标车站相关的记录,并将其处理为客流数据,具体流程如下图所示。

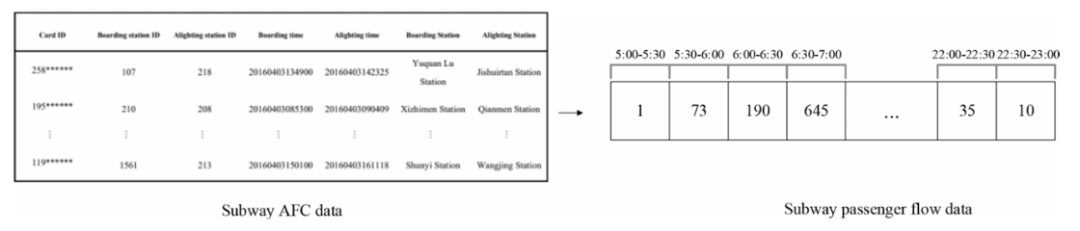

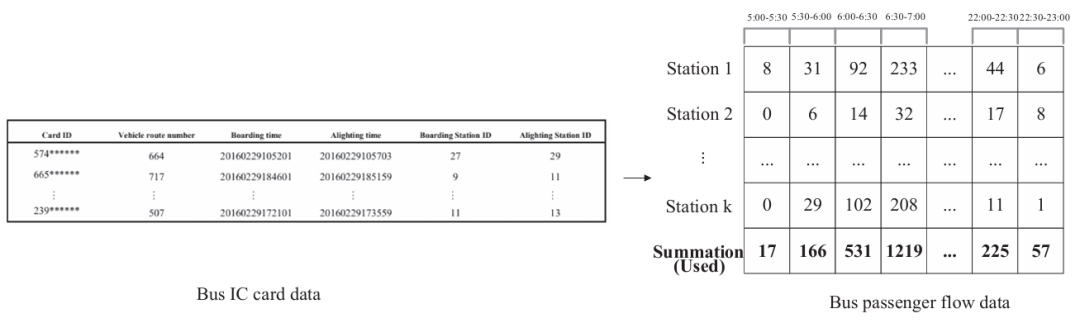

对于公交而言,本文收集并处理了公交IC卡数据,数据详情如下表所示。本文选择距离所选地铁站约1000米范围内的公交车站。基于公交IC卡数据提取该区域内相应车站的客流信息。然而,由于选定区域内通常包含多个公交站点,因此公交的客流数据结构与地铁存在差异。如下图所示,假设某一区域内有𝑘个公交站点,本文按列汇总每个公交站点的客流量,并将其总和作为该区域的公交客流数据,即图中的最后一列所示。

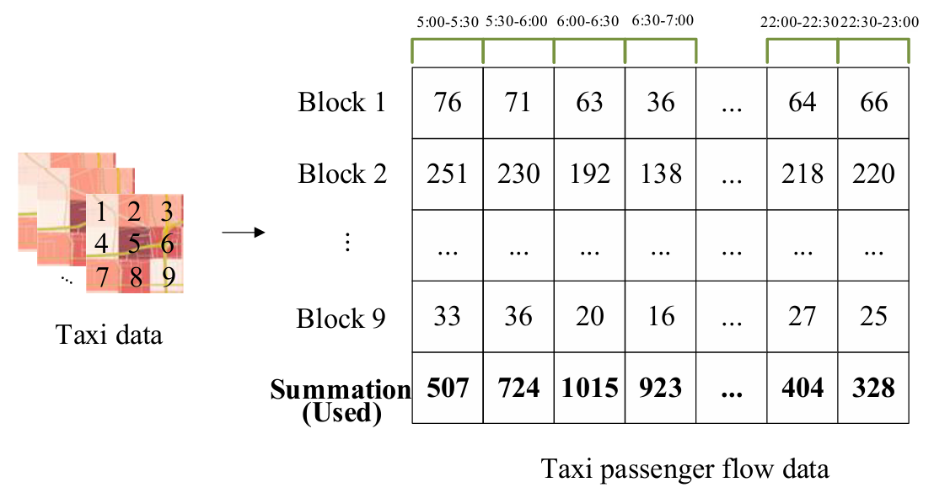

对于出租车而言,如下图所示,基于数据集,本文以所选地铁站为中心,选取一个3×3的街区区域,其进站客流数据作为该区域的出租车客流表示。进一步,本文按列汇总每个街区的客流量,并将其总和(即最后一列)作为该区域的出租车客流数据。

定义2(多模式交通系统的客流):对于包含𝑀种交通模式的多模式交通系统,根据定义1,可以获得每种交通模式的历史客流时间序列,因此,在由𝑀种交通模式组成的多模式交通系统中,所有交通模式的客流数据表示为。

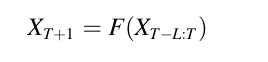

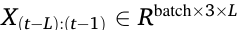

问题定义:对于由𝑀种交通模式构成的多模式交通系统,多模式交通系统短时进站客流预测的目标是,利用该系统的历史客流数据,联合预测下一时刻各交通模式的客流量。具体而言,给定多模式交通系统中所有交通模式的客流数据,给定历史时间窗口长度𝐿,系统的历史客流数据表示为,该问题的目标是学习一个预测函数𝐹(⋅),利用历史客流数据 ,联合预测下一时刻各交通模式的客流量。其数学表达式如下:

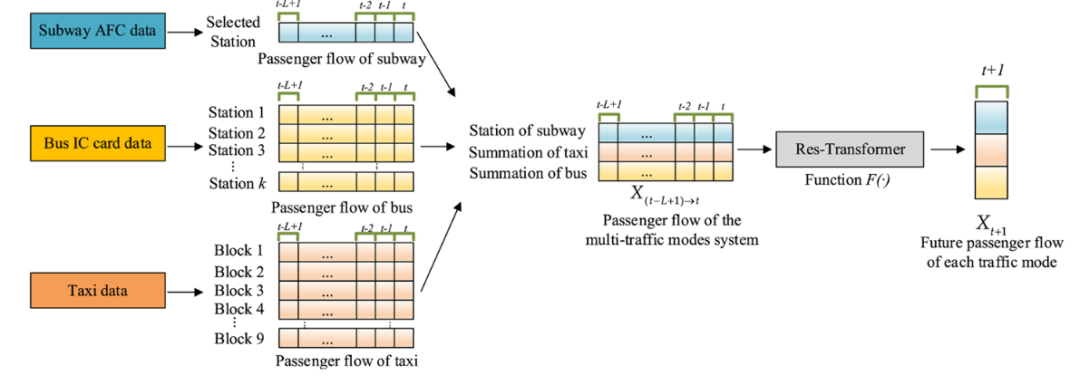

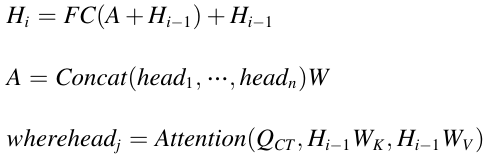

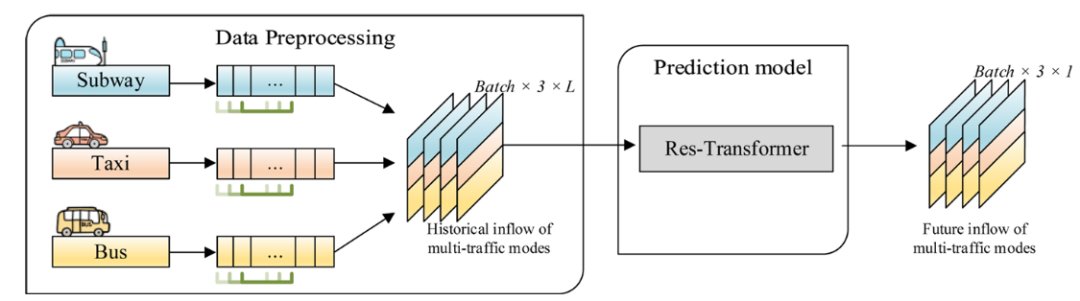

为了更好地说明研究问题,下图展示了多模式交通系统短时客流预测的流程图。具体而言,本研究考虑的多模式交通系统由地铁、出租车和公交三种交通模式组成,因此𝑀设置为3,每种交通模式的历史客流数据可基于定进行提取。本文提出Res-Transformer,用以处理多模式交通系统的历史客流数据,并学习预测函数𝐹(⋅),从而预测各交通模式未来的客流量𝑋。

|模型方法

本节首先介绍Transformer的基本架构,并探讨多头注意力机制的具体细节。随后,介绍残差网络的相关内容。最后,详细阐述所提出模型的具体设计,并给出整体框架概述。

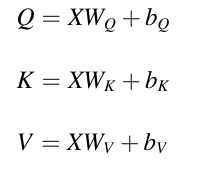

Transformer:该模型的一大亮点是多头注意力机制,该机制由多个自注意力机制组成。自注意力机制,又称为缩放点积注意力,可以被视为一种用于捕捉多种交通方式之间相关性的函数。自注意力机制使用三个参数,即与进站客流相关的查询向量Q、键向量K和值向量V,以计算多交通方式客流间的时间依赖关系。具体而言,在给定L个历史时间步的情况下,多交通方式的输入记作,通过三个全连接层(fully connected layers)分别获得Q、K和V向量,其计算公式如下:

为便于理解,下图展示了针对三种交通方式计算Q、K和V的过程。

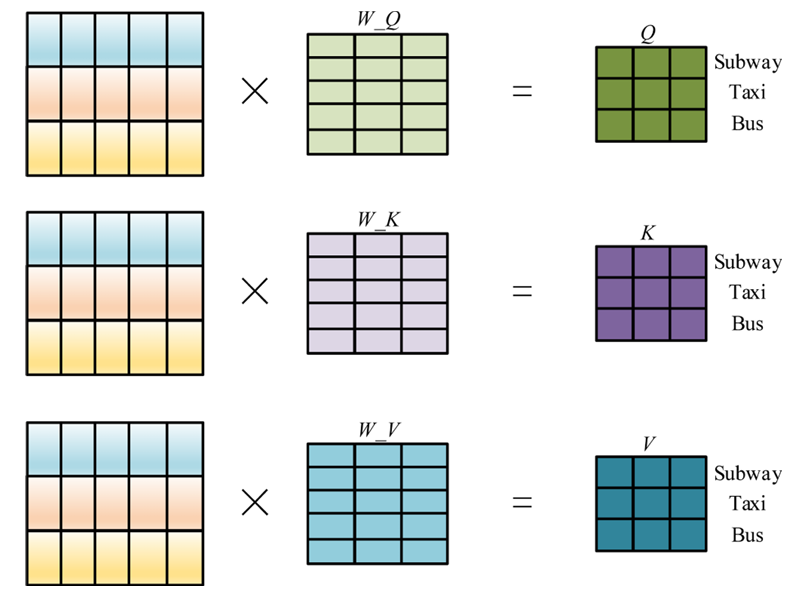

自注意力机制定义如下,其中Softmax(∙)是一种激活函数,将输入映射到区间 [0,1]。然而,仅使用单个自注意力机制无法充分捕捉不同交通方式之间的关系。因此,有必要集成多个自注意力机制,形成多头注意力(multi-head attention)。如下图所示,在多头注意力中,每一个自注意力机制对应一个注意点(head),不同的注意点关注不同的特征。

具体而言,假设输入的形状为𝑀×𝐿。多头注意力的基本思想是并行地执行𝑚次自注意力操作,其中𝑚为超参数,表示自注意力层的数量。随后,将不同自注意力层的输出结果进行拼接,并输入到一个线性层=,以获得历史进站客流数据的时间依赖矩阵。具体计算公式如下:

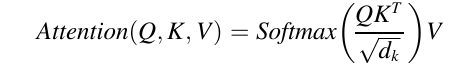

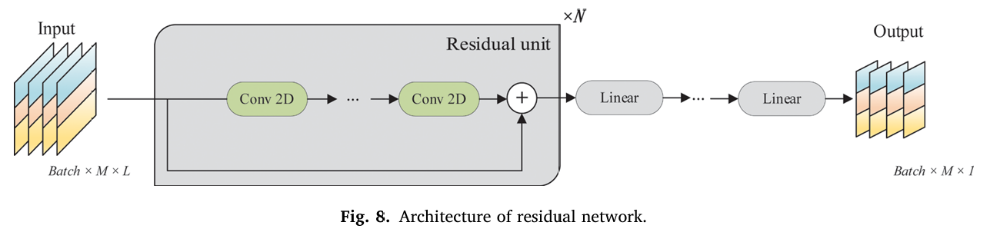

残差网络:残差网络的创新之处在于其残差连接(residual connections),设计目的是防止梯度消失、梯度爆炸以及过拟合问题。残差网络的结构如下图所示。如图所示,残差连接的数值与二维卷积层的输出数值进行相加,这有助于模型更好地捕捉有价值的信息。

对于多模式交通系统短时客流预测,二维卷积层可以提取不同交通方式在不同时间段之间的相关性。然而,由于某些相关性可能过于微弱,导致难以被捕捉,从而可能出现有价值信息缺失并增加模型训练的难度。通过将原始输入与二维卷积层的输出进行相加(即残差连接),模型可以更充分地捕捉多交通方式之间的相关性,并能更容易地完成训练。因此,残差连接在多交通方式的短时客流预测中至关重要。

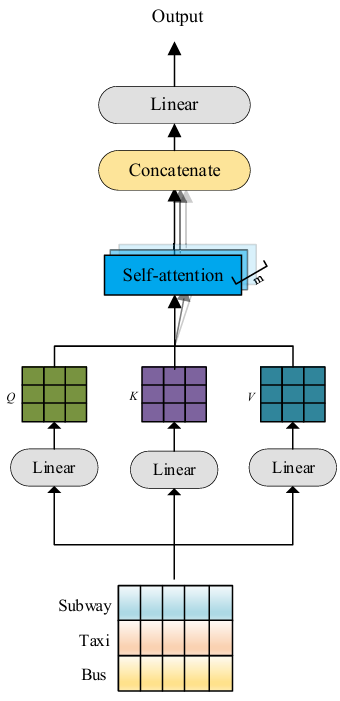

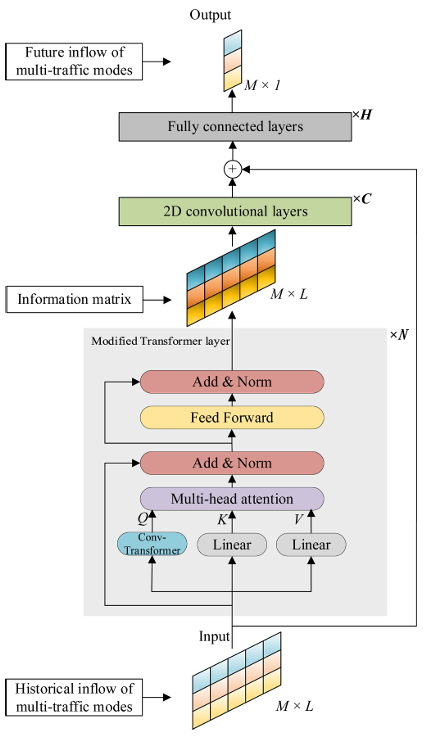

Res-Transformer:本文提出了用于多交通方式系统短期流量预测的Res-Transformer。Res-Transformer主要由两部分组成:改进的Transformer层和带有残差连接的卷积层。Res-Transformer的架构如下图所示。

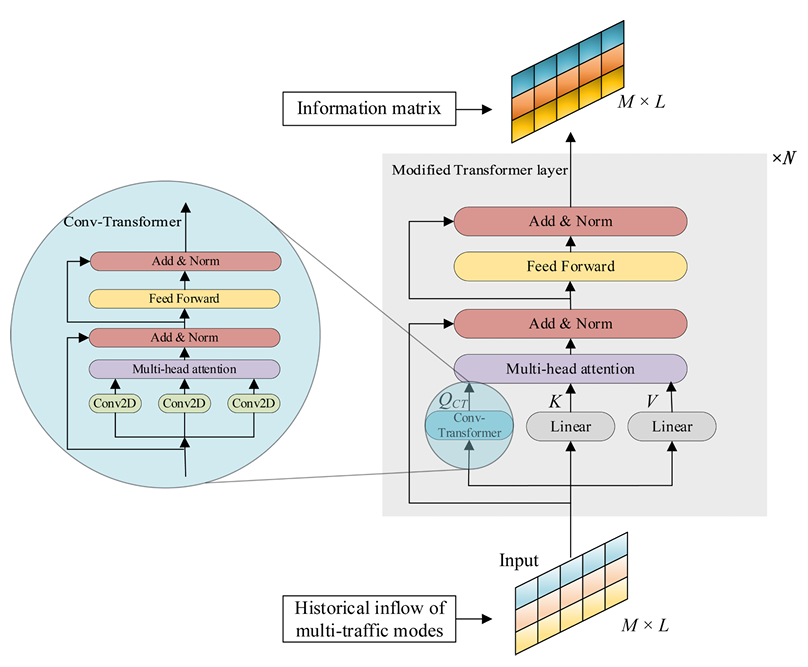

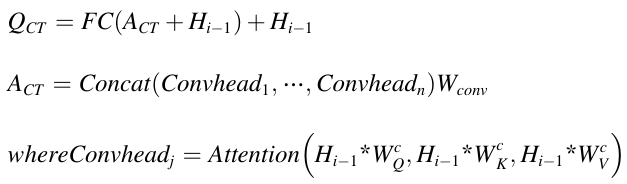

(1)改进的Transformer层:Transformer在Res-Transformer模型中发挥着至关重要的作用,因为它能够提取流量数据的时序依赖性。本文提出了改进的Transformer层,如下图所示。多模式交通系统的历史客流输入到N个串行的改进的Transformer层,以捕捉不同交通模式之间的时序相关性并获得信息矩阵。在改进的Transformer层中,Q的计算过程与原始Transformer不同,而K和V的计算则遵循原始Transformer。

具体而言,本文提出了一个Conv-Transformer层用于计算Q。Conv-Transformer层采用了原始Transformer的结构,并将线性层替换为卷积层。与线性层相比,卷积层能够充分捕捉不同交通方式之间的交叉相关性。对于第i个改进的Transformer层,给定第(i-1)个改进的Transformer层的输出,Conv-Transformer层的公式表示如下:

基于Conv-Transformer层,第i个改进的Transformer层的输出如下所示:

其中,信息矩阵A实现多交通方式交互机制的关键。具体而言,信息矩阵包含了不同交通方式之间的相关性,每个信息矩阵的块表示某一交通方式的流量对目标交通方式未来流量的影响。然而,信息矩阵需要进一步处理才能生成多交通方式的未来流量。

(2)卷积层与残差连接:信息矩阵中每个块的位置对于多交通方式的流量预测至关重要,因为每个块在信息矩阵中的意义不同。因此,利用卷积层来捕获和聚合各块之间的特征是合适的。具体而言,信息矩阵被输入到C个连续的卷积层中。此外,为防止梯度消失和爆炸,本文设计了一个残差连接。具体来说,最后一个卷积层的输出与多交通方式的历史流量相加。最终,处理后的信息矩阵被输入到线性层中,以整合信息并生成多交通方式的未来流量。

总体而言,本文选择地铁、出租车和公交车作为多模式交通系统的代表。本研究的框架概述如下图所示,主要分为两部分。在第一部分,本文对多交通方式系统的流量数据进行了预处理。具体而言,本文提取了工作日的流量数据,并选择了目标区域。此外,本文使用滑动窗口生成历史流量数据 。进一步,在第二部分,历史流量数据𝑋被输入到Res-Transformer中。具体而言,历史流量数据首先输入到N个连续的改进Transformer层,以获得信息矩阵。进一步,信息矩阵通过C个连续的卷积层进一步处理,处理结果与历史流量数据𝑋相加,生成处理后的信息矩阵。最后,处理后的信息矩阵经过全连接层处理,生成多交通方式的未来流量。

。进一步,在第二部分,历史流量数据𝑋被输入到Res-Transformer中。具体而言,历史流量数据首先输入到N个连续的改进Transformer层,以获得信息矩阵。进一步,信息矩阵通过C个连续的卷积层进一步处理,处理结果与历史流量数据𝑋相加,生成处理后的信息矩阵。最后,处理后的信息矩阵经过全连接层处理,生成多交通方式的未来流量。

|数值实验

本节首先描述了本研究使用的数据集。其次,介绍了模型配置和评估指标。进一步,Res-Transformer与几种基准模型进行了比较,包括LSTM、CNN-1D、CNN-2D、ConvLSTM、ResNet和Transformer。为验证所提模型每个部分的有效性,本文从多个角度进行实验分析。此外,本文还比较了考虑多交通方式的模型与仅考虑单一交通方式的模型的表现。最后,基于所提出模型探索了多交通方式的交互机制。

(1)数据集:

本研究的实验在中国北京市的两个地区进行,分别为西直门(XZM)和望京(WJ),这两个地区分别代表了交通枢纽和居民区。在每个地区,数据集包含三种交通方式:地铁、出租车和公交。本文只考虑了2016年2月29日至4月1日之间的数据(大约一个月)。此外,数据集只考虑了工作日的客流数据。由于三种交通方式的服务时间不同,本文选择了从早上5:00到晚上11:00的客流数据,符合地铁的服务时间。时间粒度为30分钟,每天共有36个时间段。数据集被分为训练集、验证集和测试集,比例分别为70%、10%和20%。值得注意的是,所选区域的地铁、出租车和公交的原始客流数据中有一些缺失记录。为处理这些缺失记录,本文通过平均不同周同一时间段的客流数据来填补缺失的数据。

(i)地铁客流数据集:文章收集了北京市的AFC数据,包含276个地铁站的记录。通过处理AFC数据,本文得到来自西直门和望京站的地铁数据集,其中包含了工作日的客流序列,时间粒度为30分钟。(ii)公交客流数据集:文章收集了北京市2635个公交站的IC卡数据。IC卡数据包含乘客的出行记录,每条记录包含进站时间、进站站名、出站时间和出站站名。首先,本文选择了距离两个选定地铁站大约1000米的公交站。进一步,本文选择了进出站时间在地铁服务时间内的数据,并计算了所选公交站的客流序列。由于选定区域有多个公交站,本文将所选公交站的客流序列求和,作为选定区域的总公交客流序列。(iii)出租车客流数据集:文章使用了TaxiBJ数据集并提取了两个选定区域:西直门和望京的客流数据。提取的数据时间范围为2016年2月29日至4月1日。具体而言,本文选择了一个以地铁站为中心的3×3块区域的客流数据来代表该区域。

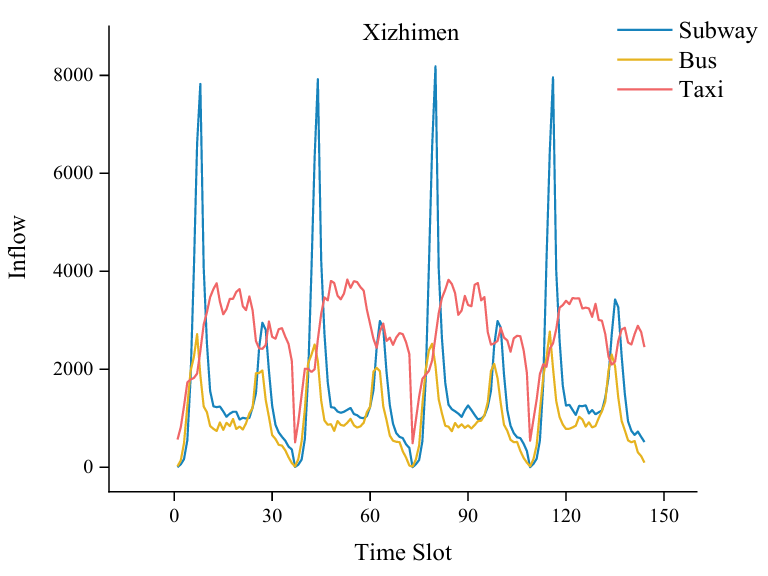

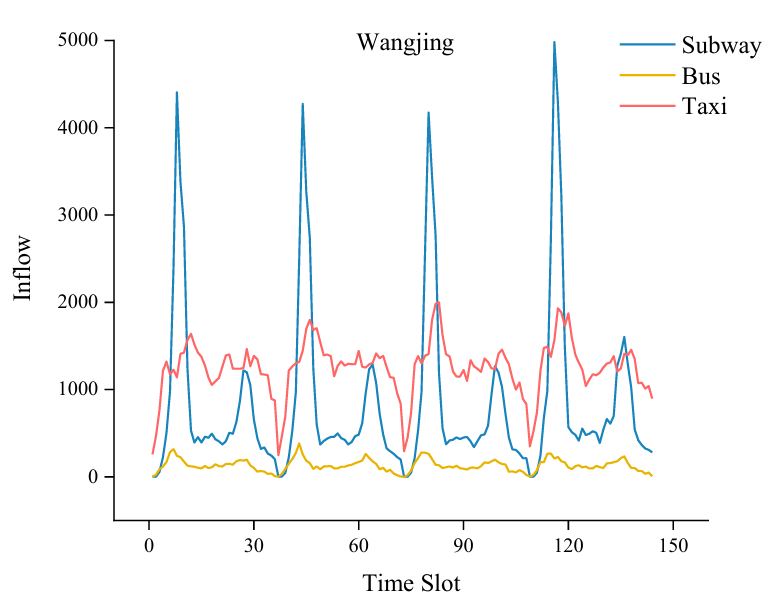

基于选定区域,本文简要分析地铁、出租车和公交的工作日客流数据,如下图所示。在每个地区,公交和地铁的客流量差异较大,但它们的客流趋势相似。根据这两种交通方式的客流数据,明显的高峰时段几乎出现在相同的时间段。与公交和地铁的高峰时段相比,出租车的高峰时段稍有延迟,且持续时间较长。总体而言,三种交通方式的客流模式相似,即都具有双峰特点。就两个地区的比较而言,尽管两个地区的客流模式相似,但显然西直门地区的所有交通方式的客流量要大于望京地区的客流量。为了更好地捕捉客流数据的特征并获得最佳结果,本文使用了最大最小归一化方法对两个地区的数据进行了处理,并将数据映射到区间[-1, 1]。

(2)实验结果:

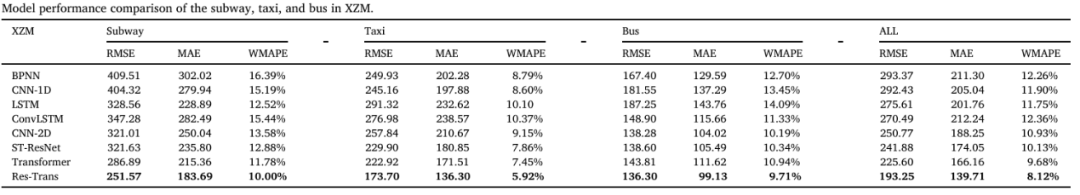

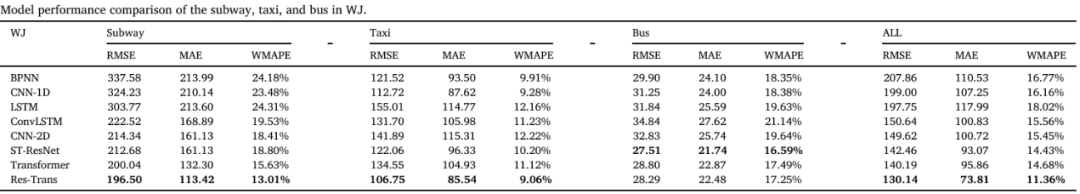

(i)多模式交通系统短时客流预测结果分析:本文使用了西直门(XZM)和望京(WJ)数据集,结果如下表所示。对于所有交通模式,BPNN在两个数据集上的表现都是最差的。由于不同交通模式具有不同的特征,BPNN不能有效识别它们,可能将它们视为相同的交通模式。因此,BPNN只能捕捉到客流数据的有限非线性特征,缺少不同交通模式之间的相关性和时序特征。这证明仅使用全连接层并不适合。相比之下,CNN-1D的表现优于BPNN。尽管CNN-1D能够识别不同的交通模式并获得它们之间的相关性,但该模型捕捉到的时序特征有限。尽管LSTM能够捕捉时序特征,但它的表现仅略好于CNN-1D,结果并不理想,这意味着单纯捕捉时序特征或相关性不足以得到良好的预测结果。

通过结合LSTM和CNN-2D,ConvLSTM能够比之前的模型更精确地预测不同模式的客流。这可能是因为ConvLSTM最初用于降水预测,而CNN-2D模型在该任务中的表现通常优于ConvLSTM。此外,基于CNN-2D和残差连接的ST-ResNet,取得了比CNN-2D更好的结果。这些模型的表现证明了CNN-2D是提升其性能的主要因素。可以将这三种交通模式视为矩阵,通过2D卷积操作,同时考虑不同交通模式的特征。因此,该模型能够捕捉时序特征和多模式交通间的相关性。然而,由于CNN-2D的模型结构,其捕捉到的时序特征仍然有限。

如表所示,Transformer的表现优于CNN-2D,因为该模型采用了多头自注意力机制。多头自注意力机制能够充分捕捉时序特征和多模式交通间的相关性,因此其性能优于CNN-2D。根据基准模型的性能,可以看出,准确捕捉时序特征和相关性是进行多模式交通客流预测的关键。所有模型中,基于CNN-2D的模型和Transformer表现较好。因此,为了获得最佳的多模式交通客流预测性能,本文结合CNN-2D和Transformer,并借鉴残差网络的思想,提出了Res-Transformer。结果证明,Res-Transformer在与基准模型的比较中表现最佳。Res-Transformer能够精确捕捉多模式交通间客流模式的共性,并正确识别它们之间的差异。此外,Res-Transformer在现有模型中具有强大的鲁棒性,并在两个数据集上都表现出良好的预测能力。具体来说,在XZM数据集上,Res-Transformer的表现最佳,所有交通模式的RMSE为193.25,MAE为139.71,WMAPE为8.12%;在WJ数据集上,所提模型也取得了最佳表现,所有交通模式的RMSE为130.14,MAE为73.81,WMAPE为11.36%。

(ii)单一交通模式结果分析:在单一交通模式方面,BPNN、CNN-1D和LSTM的表现如下:BPNN和CNN-1D在两个数据集中预测公交和出租车客流时表现较好,而LSTM则在预测地铁客流方面更为准确。由于出租车和公交的客流波动较大,LSTM无法充分捕捉其时序特征,从而难以准确预测未来的客流。对于基于CNN-2D的模型——如ConvLSTM、CNN-2D和ST-ResNet——与上述三个模型相比,所有交通模式在两个数据集中的表现均有显著提升。此外,在WJ数据集中,ST-ResNet在预测公交客流时表现最佳,因为它能够在客流波动时捕捉空间和时间特征。事实上,在两个数据集中,地铁的客流量远高于其他交通模式,证明地铁是所选区域的主要交通模式。特别是在WJ数据集中,公交的客流量远低于地铁和出租车,因此,准确预测地铁和出租车的客流量尤为重要,这些结果将为政府制定相应的交通管理措施提供重要参考。

与ST-ResNet相比,Transformer在地铁和出租车的预测精度上有显著提高。然而,在公交预测中,Transformer无法充分捕捉到空间和时间特征,导致预测精度较低。Res-Transformer在地铁和出租车的客流预测中表现最佳,且在两个数据集中的误差最小。在XZM数据集中,无论交通模式如何,Res-Transformer的表现都最好。在WJ数据集中,公交客流的预测中,Res-Transformer的表现略逊于ST-ResNet,可能是因为公交客流模式的不稳定和低客流量所致。然而,为了更好地组织交通资源并为政府提供重要参考,准确预测地铁和出租车的客流尤为重要,特别是在WJ区域。Res-Transformer的表现优于Transformer和ST-ResNet。

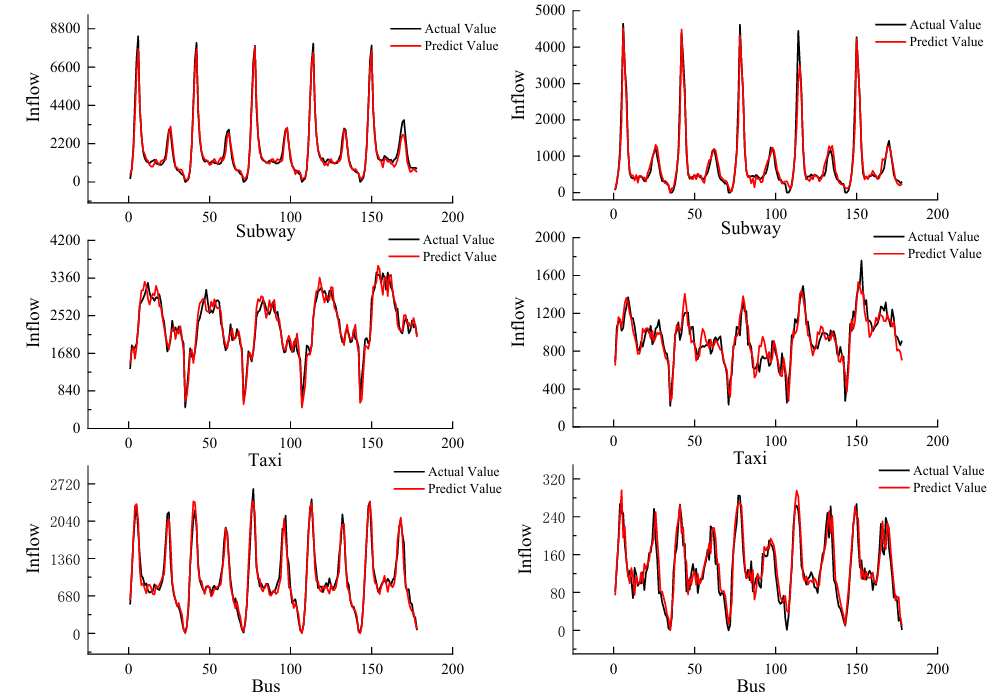

Res-Transformer的预测结果如下图所示。尽管XZM的三种交通模式客流较WJ更加稳定,但Res-Transformer表现良好,预测值与实际值高度吻合。就地铁和公交而言,Res-Transformer能够准确预测两个数据集中的高峰和非高峰时段。对于出租车而言,尽管高峰时段不明显,Res-Transformer仍能捕捉到客流模式并准确预测未来的客流。

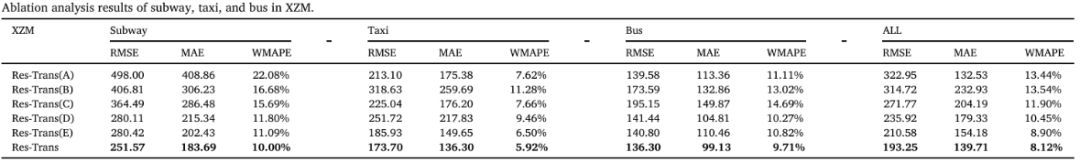

(iii)消融实验:为进一步验证Res-Transformer的有效性,使用XZM数据集进行了消融实验。本文通过控制变量法改变了Res-Transformer的架构,构建了五种不同的模型。各模型的详细信息如下:

Res-Transformer (A):本文使用全连接层来获取Q,而不是在卷积Transformer层中使用2D卷积层。

Res-Transformer (B):本文去除了残差连接和2D卷积层,仅使用修改后的Transformer层和全连接层。

Res-Transformer (C):本文去除了2D卷积层。

Res-Transformer (D):本文去除了残差连接。

Res-Transformer (E):本文使用了原始Transformer的编码器(八层),代替了修改后的Transformer层,其他部分与Res-Transformer相同。

实验结果如下表所示,Res-Transformer (A)和Res-Transformer (C)的评估指标明显高于Res-Transformer,这证明了2D卷积层的有效性。此外,根据Res-Transformer (A)的表现,修改后的Transformer层中的2D卷积层(用于生成Q)是所有组件中最重要的。关于Res-Transformer (B)的结果,证明了仅依靠修改后的Transformer层无法发挥作用。修改后的Transformer层输出的信息矩阵(包含三种交通模式的特征)不能直接送入全连接层。该信息矩阵必须经过2D卷积层进一步处理。对于Res-Transformer (D),如果去除残差连接,模型的表现略逊于本文提出的模型。因此,为了准确预测未来的客流,信息矩阵需要经过卷积层进一步处理,并与原始输入相加,就像本文在提议的模型中所做的那样。

Res-Transformer (E)用原始Transformer模型的编码器替代了修改后的Transformer层,在上述模型中表现最好。此外,与表5中Transformer的表现相比,使用Res-Transformer架构并采用原始Transformer层的结构,在所有交通模式下的预测准确度都优于Transformer,证明了所提架构的有效性。然而,Res-Transformer仍然优于Res-Transformer (E),这证明了原始Transformer层不能充分捕捉多交通模式之间的时序特征和相关性,也无法提取出有价值的信息矩阵。

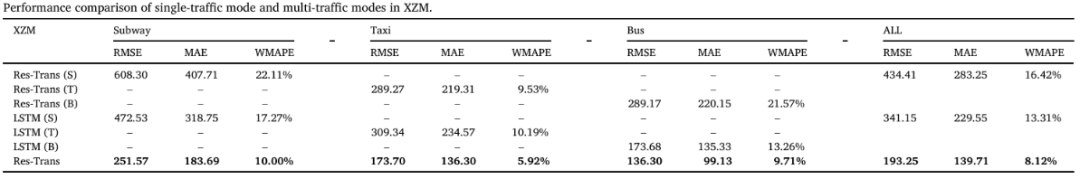

(iv)多交通模式与单一交通模式的比较:为了量化多交通模式之间相关性的贡献,本文比较了多交通模式模型与单一交通模式模型的性能。具体而言,本文简化了Res-Transformer,分别构建了地铁、出租车和公交的单一交通模式版本模型;同时,本文也对LSTM模型进行了改造,使其分别适用于三种交通模式的单一预测。单一交通模式版本的模型仅考虑某一种交通方式的进站客流,不考虑不同交通方式之间的相关性。本文使用XZM数据集对各模型进行训练与测试,并采用RMSE、MAE和WMAPE作为评价指标。结果汇总于下表,其中后缀“(S)”、“(T)”和“(B)”分别代表用于地铁、出租车和公交的预测模型。

(1)单一交通模式版本模型的比较。在出租车预测中,Res-Transformer的各项评价指标均优于LSTM,说明其对波动性较大的进站客流具有更强的预测能力,这与表5中的结果一致。总体来看,单一交通模式版本模型的评价指标普遍偏高,说明预测性能较差。

(2)多交通模式与单一交通模式模型的比较。通过汇总单一交通模式模型在三种交通方式上的预测结果,计算其总体评价指标后发现,所有指标均显著高于多交通模式版本模型。该结果表明,同时考虑多交通方式之间的相关性能够显著提升模型性能和预测准确性。

综上所述,多交通模式模型在性能上的优越表现证明了联合建模多种交通方式(而非分别建模)的有效性。与表现最好的单一交通模式模型相比,多交通模式模型在各项评价指标上均有明显下降,进一步说明了多模态协同建模的重要性。

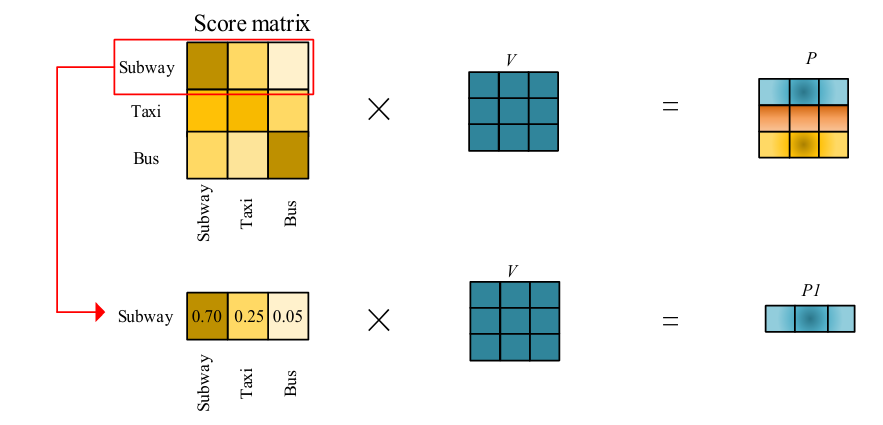

(v)多模式交通系统的交互机理分析:为进一步探索多交通方式之间的相互影响,本文设计了两组实验:首先,针对自注意力机制,通过计算得分矩阵,量化各交通方式历史进站客流对未来进站客流的影响关系。得分矩阵中,每一元素反映了不同交通方式之间的关联强度,颜色越浅,影响越小。如下图所示,假设输出为P,第一行P₁代表地铁未来进站流量的输出结果。结果表明,地铁自身对其未来客流的主导作用最强,影响因子为0.70。同时,相较于公交车,出租车对地铁进站流量的影响也更为显著。这一实验直观地验证了自注意力机制能够有效捕捉不同交通方式间的相互关联性。

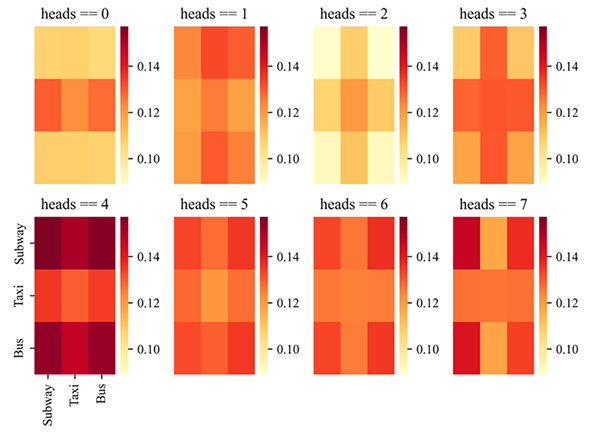

其次,为分析多头注意力机制的优势与作用机理,本文使用XZM数据集训练所提出的模型,提取了8个不同头(head)对应的得分矩阵。需要注意的是,每一组输入数据对应一组得分矩阵,本文仅选取其中一组用于说明。如下图所示,8个矩阵分别呈现不同的注意力分布模式,每个矩阵由9个小块组成,每块表示某一交通方式的历史进站流量对未来客流的影响程度。从不同矩阵中色块深浅变化可以观察到,各个头关注的重点存在显著差异。例如,在Head 2和Head 3中,得分矩阵呈现明显的“十字交叉”形态,深色区域集中在出租车相关位置,说明出租车客流对其他交通方式有较大影响,同时自身也受到各交通方式的显著影响。而在Head 6中,虽然同样呈现交叉形态,但色块较浅,且重心偏向地铁和公交车,与前两者模式迥异。这一现象表明,单一注意力头只能捕捉部分特征,难以完整表征复杂的客流交互特性,因此引入多头注意力机制是必要且有效的,可以综合提取不同层次、不同视角下的交通方式关联特征。

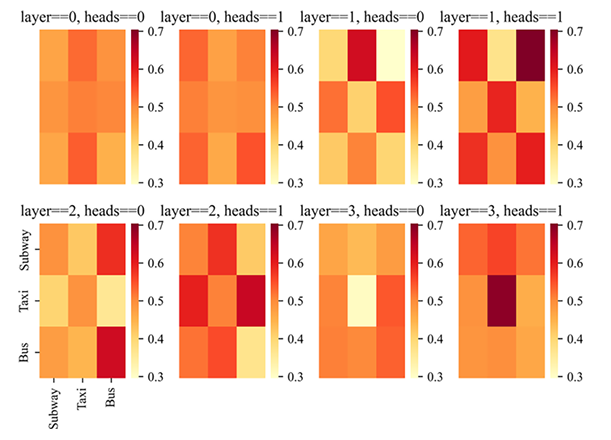

进一步地,在上述基础上,本文设置了四层多头注意力机制,每层包含两个注意力头,得分矩阵结果如下图所示。不同层次的多头注意力提取到的交通方式交互特征也呈现出明显差异,体现出模型在纵深方向上逐步细化、丰富了交通方式之间的时空关联建模能力。

综上,通过自注意力与多头注意力机制的实验分析可以得出:地铁、出租车、公交车之间存在非对称、动态的影响关系;不同注意力头能够专注于不同交通方式的交互特征,形成互补;通过堆叠多层多头注意力机制,可以逐步深化对复杂交通系统内在机制的理解和建模,从而提升整体客流预测的准确性。

|总结

本研究提出了一种新颖的多任务学习架构——Res-Transformer,能够准确预测多交通方式的未来进站客流。Res-Transformer 结合了改进的 Transformer 层与残差网络,其主要研究结论总结如下:

Res-Transformer 在捕捉交通方式间关联性及客流时序特征方面具有显著优势。所提出的 Conv-Transformer 层能够有效提取并融合多交通方式特征,提升预测准确性。

基线模型对比分析显示,LSTM 在处理多交通方式问题时表现出一定的劣势,而基于 Transformer 和 CNN-2D 的模型在本研究场景下更适合进行多交通方式的客流预测。

在两个大规模真实数据集上的测试结果表明,Res-Transformer 具有良好的鲁棒性,并相较现有最佳模型取得了显著性能提升:在 XZM 数据集上,Res-Transformer 在所有交通方式上分别达到了 RMSE 为 193.25、MAE 为 139.71、WMAPE 为 8.12% 的最佳预测性能;在 WJ 数据集上,Res-Transformer 同样实现了 RMSE 为 130.14、MAE 为 73.81、WMAPE 为 11.36% 的最佳综合预测效果。

尽管本研究取得了良好效果,本研究仍存在一些局限性:首先,本文仅选取了地铁、出租车和公交车三种交通方式,未能涵盖如骑行、步行等更多元的出行方式;其次,本研究仅在两个典型区域内进行了实验,尚未扩展至完整的交通网络(如整个城市尺度);此外,尽管天气因素已知会对乘客出行决策产生重要影响,但本研究未将天气数据纳入考虑;最后,本研究仅选取了工作日的数据进行建模与预测,未涵盖周末数据。由于周末出行具有更高的随机性和不确定性,且缺乏明显的客流规律性,因此对模型学习过程和预测精度可能产生显著影响。

|总结

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?